2403.04132_Chatbot Arena: An Open Platform for Evaluating LLMs by Human Preference¶

引用: 843(2025-08-25)

组织:

1UC Berkeley

2Stanford

3UCSD(University of California, San Diego)

总结¶

主要贡献

构建了首个大规模实时、用户驱动的LLM评估平台,截至2024年3月已有超过100万次访问;

对平台数据进行了全面分析,包括问题多样性、投票质量、人类反馈等;

公开发布了包含10万次以上成对投票的数据集;

设计了高效的采样算法,显著提升了样本效率,提高了排名评估的准确性。

背景

LLM评估基准的两个维度

问题来源:静态数据集 vs. 实时新问题

评估指标:基于标准答案 vs. 人类偏好

静态基准测试的局限性(Risks of Static Benchmarks)

污染(contamination):模型可能在训练中已见过测试数据;

饱和(saturation):模型性能提升空间有限;

过拟合(overfitting):模型可能适应特定测试集;

缺乏与人类偏好的对齐(lack of human alignment)。

Chatbot Arena

采用成对比较,简化用户评分流程。

提供“平局”和“两个都不好”的选项,增强用户参与。

评分函数:Bradley-Terry 模型

说明:替代原来的 Elo 评分

BT 系数在统计估计上更优

From Pairwise Comparisons to Rankings

核心问题: 数据是“两两比较”(pairwise comparisons),但如何利用这些比较来恢复所有 M 个模型的完整排名

核心目标:胜率矩阵

估计胜率矩阵本质上是一个均值估计问题(mean-estimation problem)

详细的过程参见 第4、5章

Abstract¶

Abstract(摘要)¶

背景与问题

大语言模型(LLMs)已经展现出新的能力和应用潜力,但如何评估其与人类偏好的对齐程度仍然是一个重大挑战。

方法与平台

为了解决这一问题,作者引入了 Chatbot Arena,这是一个基于人类偏好的开放平台,用于评估大语言模型。平台采用成对比较的方法,并通过众包(crowdsourcing) 的方式收集大量用户的输入。

数据与成果

平台运行数月后,已收集了超过 240,000 次用户投票。本文详细描述了平台的运作机制,分析了所收集的数据,并介绍了用于模型评估和排序的成熟统计方法,以确保评估的高效性和准确性。

分析结果

研究表明,通过众包收集的问题具有足够的多样性和区分度,而用户投票与专家评分之间高度一致。这些分析结果为 Chatbot Arena 的可信度奠定了坚实的基础。

影响力与应用

由于其独特价值和开放性,Chatbot Arena 已成为最被引用的 LLM 排行榜之一,被众多领先的 LLM 开发者和公司广泛引用。平台的演示版本已公开,访问地址为 https://chat.lmsys.org。

重点总结¶

Chatbot Arena 是基于众包和用户偏好的 LLM 评估平台。

采用成对比较方法,收集了超过 240,000 次用户投票。

使用统计方法进行模型排序,确保评估的准确性和效率。

问题多样性高,用户投票与专家评分一致,说明评估结果可信。

平台开放性高,已成为 LLM 领域的重要评估工具。

1 Introduction¶

1 Introduction 总结¶

背景与动机¶

近年来,大语言模型(LLMs)的能力已经大幅扩展,超越了传统的自然语言处理任务,可以应对各种通用任务(引用了OpenAI、Gemini等团队的研究)。尽管LLMs展现出巨大潜力,但也引发了对性能评估方法的担忧。当前的评估基准往往无法全面、准确地反映模型在开放性任务中与人类偏好的一致性,特别是在真实世界中的表现评估上存在不足。

当前评估方法的分类与局限¶

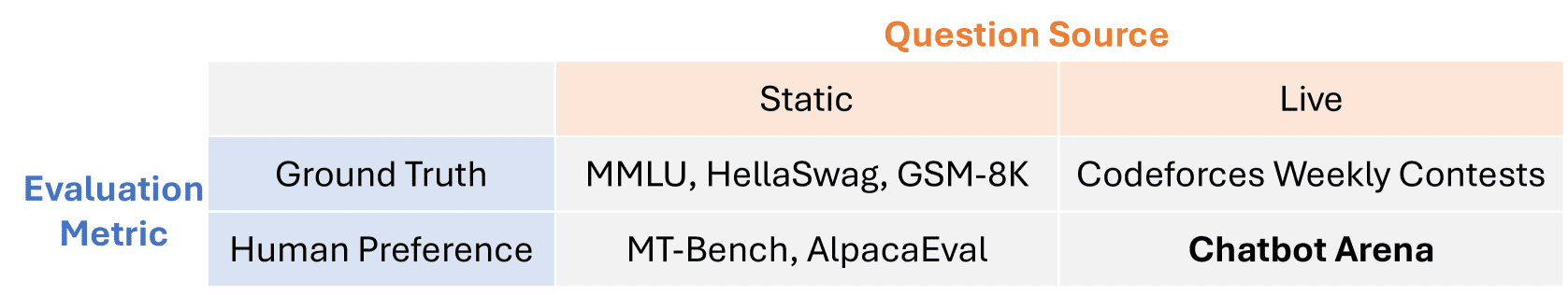

当前的LLM评估基准可以按两个维度进行分类:

问题来源:静态数据集 vs. 实时新问题;

评估指标:基于标准答案 vs. 人类偏好。

Figure 1:Classification of LLM benchmarks

根据这两个维度,基准可以分为四类,如图1所示。虽然多样化的基准是有益的,但目前最常用的评估方法仍是基于静态数据集和标准答案的评估,因为这种方法成本低、可复现。

然而,这种静态评估方法存在以下主要局限性:

问题不是开放性的,无法体现模型在真实场景中的灵活性与互动性;

测试集固定,容易被污染,影响评估的可靠性;

对于复杂任务,确定标准答案非常困难甚至不可能。

因此,当前的评估方法无法有效满足先进LLMs的评估需求,尤其是在用户偏好评估方面。因此,迫切需要一个开放、实时、基于人类偏好的评估平台。

构建评估平台的挑战¶

构建这样的平台面临三大挑战:

收集实时、多样化、新鲜的用户问题,以反映真实场景;

设计可扩展、高效、增量更新的排名系统,以评估大量模型;

确保人类评估的质量,因为人类偏好本身具有噪声。

Chatbot Arena 平台介绍¶

为解决上述问题,作者提出了Chatbot Arena平台。这是一个开源、免费、面向公众的LLM评估平台,用户可以在平台上匿名提交问题,并选择两个匿名模型的回答,进行投票。模型身份在投票后才被揭示。这种方式可以持续收集多样化的用户问题,并准确反映LLM在现实中的使用情况。

为了从这些数据中高效提取模型排名,平台使用了多种统计方法,包括:

Bradley-Terry模型(1952):用于估计模型之间的相对排序;

Vovk-Wang E值(2021):一种样本高效的估计方法; 并通过高效的采样算法,选择模型对比对,以加快排名收敛速度,同时保持统计有效性。

数据与分析¶

作者对平台收集的数据进行了深入分析,结果表明:

用户生成的问题多样性高,涵盖了各种LLM应用场景;

问题具有足够的挑战性,能够有效区分不同模型;

用户投票与专家评估高度一致,说明平台评估结果可信。

平台运行情况与贡献¶

平台自2023年4月运行以来,截至2024年1月:

收到了超过24万次投票;

涉及约9万名用户;

使用了100多种语言;

提供了50多个最先进的模型供用户免费使用;

与OpenAI、Google、Anthropic、Mistral、Hugging Face等领先模型开发者和多所大学合作,持续集成最新模型;

平台通过更新排行榜、发布博客、公开数据集、社交媒体互动等方式保持社区活跃。

主要贡献¶

构建了首个大规模实时、用户驱动的LLM评估平台,截至2024年3月已有超过100万次访问;

对平台数据进行了全面分析,包括问题多样性、投票质量、人类反馈等;

公开发布了包含10万次以上成对投票的数据集;

设计了高效的采样算法,显著提升了样本效率,提高了排名评估的准确性。

总结¶

本节主要介绍了Chatbot Arena平台的背景、动机、当前评估方法的局限、平台的设计思路与实现方法,并展示了平台的数据分析结果与实际运行成效。该平台通过依托用户投票的实时评估机制,有效弥补了现有LLM评估方法的不足,为LLM研究提供了重要的开放工具与数据支持。

2 相关工作(Related Work)¶

LLM 基准测试(LLM Benchmarks)¶

我们简要回顾了常见的 LLM 基准测试,并按照图1中的分类进行介绍。最常见的基准测试是基于静态数据、具有标准答案的测试,通常以多选题或问答题的形式呈现。这些基准涵盖语言理解、数学、编程和逻辑推理等多个领域。典型的例子包括:

MMLU(Hendrycks et al., 2020):涵盖多种学科的多选题;

HellaSwag(Zellers et al., 2019):测试常识推理;

GSM-8K(Cobbe et al., 2021):数学问题求解;

BigBench(Srivastava et al., 2023):大规模语言模型能力评估;

AGIEval(Zhong et al., 2023):通用智能评估;

HumanEval(Chen et al., 2021):代码生成任务。

此外,还有一些安全相关的基准,如 ToxicChat(Lin et al., 2023),以及综合性的评估套件,如 HELM(Liang et al., 2022)。

除了封闭式问题,一些基准测试也涉及开放式问题,这些任务需要依靠人类判断进行评分,可以由专家或如 Amazon Mechanical Turk 的众包平台完成。近年来的趋势是使用如 GPT-4 来模拟人类判断,例如:

MT-Bench(Zheng et al., 2023b);

AlpacaEval(Li et al., 2023)。

除了静态基准测试,也存在动态基准测试,它们使用新鲜的问题,例如来自年度考试或每周在线竞赛,如 Codeforces(Li et al., 2022;Huang et al., 2023),或来自人类互动的数据。一部分研究探索了通过人类实时互动进行强化学习(如 Bai et al., 2022;Ouyang et al., 2022;Touvron et al., 2023),但这类研究通常局限于特定组织。

本文中,我们提出了 Chatbot Arena,这是首个开放、大规模、众包式的基准平台,使用实时人机互动进行模型评估。

静态基准测试的局限性(Risks of Static Benchmarks)¶

静态基准测试存在一些问题,包括:

污染(contamination):模型可能在训练中已见过测试数据;

饱和(saturation):模型性能提升空间有限;

过拟合(overfitting):模型可能适应特定测试集;

缺乏与人类偏好的对齐(lack of human alignment)。

DynaBench(Kiela et al., 2021)指出了这些挑战,并建议使用包含人类反馈的动态基准。本文系统采用了类似思路,但专注于与大语言模型聊天这一场景,并在更大规模的用户群体中实现。

排名系统(Ranking System)¶

排名系统是一个在统计学中已有广泛研究的问题,相关研究包括:

概率模型(Hunter, 2004;Rao & Kupper, 1967);

排名收集方法(Szörényi et al., 2015;Busa-Fekete et al., 2014);

在线实验设计(Chernoff, 1992;Karimi et al., 2021)。

Elo 排名系统也被应用于 LLM 的排名中,例如 Bai et al.(2022)和 Boubdir et al.(2023)的工作。

在本文中,我们提出了适用于大规模、真实世界 LLM 场景的排名技术,重点包括:

加速排名收敛;

异常检测机制(例如识别用户行为异常或模型表现异常)。

人类偏好数据集(Human Preference Dataset)¶

由于人类偏好在模型评估中的重要性,已有多个包含人类偏好的数据集和分析方法,例如:

OpenAssistant(Köpf et al., 2023);

HH-RLHF(Bai et al., 2022);

LMSYS-Chat-1M(Zheng et al., 2023a);

UltraFeedback 和 Nectar(Cui et al., 2023;Zhu et al., 2023)等合成偏好数据。

其中,LMSYS-Chat-1M 也是通过众包方式收集的数据,但它仅包含对话内容,没有人类偏好信息,因此不适用于排名研究。本文的重点是基于人类偏好数据的排名分析。

3 Human Preference Data Collection¶

3 人类偏好数据收集¶

本节主要介绍我们用于收集人类偏好的界面设计,并呈现相关数据统计摘要。

3.1 界面设计¶

Chatbot Arena 通过用户反馈来进行模型评估。我们的目标是设计一个易于使用的界面,从而降低用户贡献数据的门槛。

由于我们从大量用户中收集反馈,设定统一的评分标准较为困难。因此,我们采用了成对比较机制(pairwise comparison):用户只需比较两个模型的响应,并投票选择更好者,而不需要提供绝对评分。

在每一轮比较中,系统会随机抽取两个匿名模型。用户可以自由输入任意提示,以增加数据的多样性。我们认为这种方式有助于提升用户参与度,特别是因为我们提供的是免费服务。此外,这种方式也有助于我们收集真实世界中的多样化输入。

在模型生成响应后,用户可以并排比较(side-by-side),并选择更喜欢的回答。如果用户在第一轮无法决定,可以继续与模型互动直到明确胜出者。对于不明确的情况,用户还可以选择“平局”或“两者都很差”两个按钮。

图8展示了界面的截图。在使用服务前,用户需要同意使用条款,以授权我们公开数据。

重点总结:

采用成对比较,简化用户评分流程。

用户可自由输入提示,提高数据多样性。

提供“平局”和“两个都不好”的选项,增强用户参与。

用户需授权后,数据可被公开使用。

3.2 数据统计¶

我们从2023年4月开始收集数据,截至2024年1月,已收集到24万个投票,来自超过9万名用户。数据中涉及50多个模型,包括专有模型(如 GPT-4、Claude、Gemini)和开源模型(如 LLaMA、Mistral)。

语言分布方面,对话覆盖超过100种语言,其中英语占77%,中文占5%,其他语言(如俄语、德语、西班牙语、法语、日语)各占不到2%。

每个数据点包含用户与两个大模型之间的多轮对话,以及一个用户偏好投票。

我们对这些数据进行了统计总结,并与现有数据集(如 Anthropic HH、OpenAssistant)进行了对比,如表1所示。

表1 总结了多个偏好数据集的主要统计信息,包括对话数量、模型数量、用户数量、语言数量、平均对话轮次、平均提示和响应的 token 数量等。可以看出,Chatbot Arena 在对话数量、用户数量和语言多样性方面明显优于现有数据集。

在图10中,展示了每个模型的投票数,平均每个模型获得约8000票。图2展示了部分代表性模型的胜率和对战数量。我们采用了非均匀采样策略,将更多投票集中在性能相近的模型对上,以提高排名结果的稳定性。

此外,我们还开发了自适应采样方法,并在第5节中展示了其相对于随机采样的优势。

我们采取了以下措施以确保数据安全和匿名性:

使用关键词过滤掉包含模型身份信息(如模型名、公司名)的对话。

采用 OpenAI 的内容审核 API 标记不安全内容,占总量的3%。

图9展示了有效用户投票随时间的变化,近期平均每天收到1000到2000票,新增模型或排行榜更新时会有投票量的显著增加。

重点总结:

数据覆盖时间长(2023年4月–2024年1月),用户和模型数量众多。

覆盖语言广泛,数据多样性高。

采用非均匀采样和自适应采样策略,提高排名效率。

通过过滤和审核机制,确保数据质量和用户隐私。

小结¶

本节详细介绍了Chatbot Arena用于收集人类偏好的界面设计和数据统计情况,强调了:

成对比较机制的易用性和高效性;

用户自由输入提示带来的数据多样性;

丰富的用户和模型覆盖;

数据匿名和内容审核机制;

非均匀采样和自适应采样策略提升排名效果。

这些方法和结果为后续模型的评估和训练提供了高质量、大规模的人类偏好数据。

4 From Pairwise Comparisons to Rankings¶

问题提出¶

核心问题: 我们的数据是“两两比较”(pairwise comparisons),但如何利用这些比较来恢复所有

M个模型的完整排名?背景: 这是一个在“学习排序”(learning to rank)领域被广泛研究的问题。

数据定义: 定义了比较数据集

𝒜,它包含了所有可能的模型对(m, m')(其中m < m')。例如,有3个模型,𝒜就包含(1,2),(1,3),(2,3)这三对。

交互过程与数据形式¶

交互设置: 描述了一个顺序(sequential) 的数据收集过程。

在时间点

t,系统主动选择一个模型对A_t展示给人类评估者。然后,系统观测到人类的反馈

H_t。

反馈示例:

A_t = (1,2)且H_t = 1表示人类更喜欢模型2胜过模型1。反馈类型: 虽然主要讨论二值反馈(0或1,代表更喜欢哪一个),但方法也适用于更复杂的反馈(例如,表达偏好程度或平局)。

核心目标——胜率矩阵¶

关键目标: 估计 “胜率矩阵”(win matrix)

θ*(a)。θ*(a)的定义是:给定展示了模型对a,人类反馈H_t的期望值。即θ*(a) = E[H_t | A_t = a]。

二值情况下的解释: 在二值反馈下,

θ*(a)就是模型a₂击败模型a₁的概率。问题性质: 估计胜率矩阵本质上是一个均值估计问题(mean-estimation problem),相对直接。更复杂的方法将在第5节详述。

从胜率到分数和排名¶

分数(Score)概念: 引入一个分数函数

s(ℙ),它是一个长度为M的向量(每个模型都有一个分数值)。分数基于数据和反馈的联合分布ℙ计算得出。排名定义: 模型

m的排名rank(ℙ)_m正式定义为:1 + 比它的分数更高的模型数量。分数最高的模型排名为1。

允许并列(分数相同的模型获得相同排名)。

选择分数函数——Bradley-Terry模型¶

标准方法: 介绍了一种标准的分数函数——布拉德利-特里系数(Bradley-Terry coefficients)。

BT模型假设: 在BT模型中,模型

m击败模型m'的概率由一个逻辑函数(logistic)建模。这个概率只与两个模型的相对分数(ξ_m - ξ_m')有关。分数估计: 真实的BT系数分数

s(ℙ)被定义为,能最小化二元交叉熵损失(binary cross-entropy loss) 的那个参数向量ξ。这本质上就是在用逻辑回归来拟合数据。

模型的鲁棒性与选择理由¶

模型假设的鲁棒性: 即使真实数据不严格符合BT模型的假设(即公式2),只要使用正确的统计方法(“三明治”协方差矩阵进行校正),其最大似然估计量仍然是渐近有效的。

扩展性: 论文还提供了一个非参数扩展的BT模型(见附录B),说明该方法并不严格依赖于参数假设。

历史对比与选择理由: 之前的工作(如早期版本的在线系统)使用过其他分数(如Elo分数)。本文改用BT系数,原因是BT系数在统计估计的目的上更为优越(可能指其坚实的统计理论基础和性质)。

总结概要¶

这一节阐述了如何从大量的两两比较数据中构建一个全局排名。其核心路径是:

收集数据: 通过不断给人类展示模型对

(A_t)并收集反馈(H_t)。估计胜率: 首要目标是计算胜率矩阵

θ*,它记录了任意两个模型对战时,一方击败另一方的概率。分配分数: 采用布拉德利-特里模型,将胜率矩阵背后隐含的模型实力用一个连续的分数向量

ξ来表示。这个分数通过最小化一个损失函数(交叉熵)从数据中拟合出来。生成排名: 最后,简单地根据每个模型的BT分数进行降序排序,并处理并列情况,从而得到所有模型的最终排名。

论文强调,即使BT模型的假设不完全成立,其估计方法仍然是可靠的,并且BT系数比之前使用的Elo分数在统计上更稳健。

5 Efficient Approximate Ranking¶

5 Efficient Approximate Ranking (高效近似排名)¶

本节核心目的: 在前一章(Section 4)已经定义了如何从两两比较中计算胜率矩阵、分数和排名的理论方法。本章节旨在说明在实际中,如何根据收集到的用户投票数据来估计这些量,并量化估计过程中的不确定性(如计算置信区间),最终得到一个考虑不确定性的稳健排名。

1. Win matrix estimation (胜率矩阵估计)¶

目标: 估计真实的胜率矩阵参数 \(\theta^*\)(其元素 \(\theta^*(a)\) 表示模型对 \(a\) 的胜率)。

方法: 使用逆概率加权(Inverse Probability Weighting) 来构造一个无偏估计量。这是因为不同的模型对 \((a)\) 被采样到的概率 \(P_t(a)\) 可能不同(例如,采用主动采样时),直接平均会引入偏差。

估计量定义: \(X_t(a) = \frac{1}{P_t(a)} H_t \mathds{1}\{A_t = a\}\)。这里:

\(H_t\) 是时刻 \(t\) 的投票结果(例如,1 表示 \(a\) 中的第一个模型赢,0 表示第二个赢)。

\(\mathds{1}\{A_t = a\}\) 是一个指示函数,只有当时刻 \(t\) 确实抽中了模型对 \(a\) 时才为 1。

\(\frac{1}{P_t(a)}\) 是逆概率权重,用于纠正采样偏差。

最终的估计量 \(\hat{\theta}_T\) 是所有这些 \(X_t\) 的简单平均值(公式 4)。该估计量是无偏的,即 \(\mathbb{E}[\hat{\theta}_T] = \theta^*\)。

不确定性量化:

计算估计量 \(\hat{\theta}_T\) 的协方差矩阵 \(\widehat{\Sigma}_T\)(公式 5),用于衡量估计的波动性。

在一定的正则条件下(主要是采样概率 \(P_t(a)\) 不能趋于 0,且最终会稳定下来),估计量 \(\hat{\theta}_T\) 服从渐近正态分布(公式 6)。这意味着我们可以利用正态分布的性质为真实的 \(\theta^*\) 构建置信区间。

🔵⏺️☀️一个大比喻:给一堆歌手(LLM模型)排名次

假设我们有周深、邓紫棋、毛不易等很多歌手,但没办法让他们全部同台唱一遍。怎么办呢?我们就让观众两两PK来投票。

目标: 想知道周深和任何人PK的胜率是多少。

问题: 周深和某些歌手比得多,和某些比得少,直接算胜率不公平。

解决方法(逆概率加权):

每次让周深和毛不易PK时,因为这场PK很稀有,所以这一票的权重就特别高(乘以10倍)。

每次让周深和邓紫棋PK时,因为这场很常见,所以这一票的权重就正常(乘以1倍)。

最后,把所有加权后的票数平均一下,就得到了一个公平的、无偏差的“周深胜率”。

置信区间: 我们说“周深的胜率大概是85%”,但这个数字不一定准。通过计算,我们可以说“我们有95%的把握,周深的真实胜率在82%到88%之间”。这个范围就是置信区间。

2. Estimating the BT scores (估计Bradley-Terry分数)¶

目标: 估计 Bradley-Terry 模型的参数 \(\xi\)(即每个模型的实力分数)。

方法: 使用加权最大似然估计(Weighted MLE)(公式 7)。

损失函数 \(\ell\): 通常是交叉熵损失,用于衡量预测概率(基于当前分数估计 \(\xi\))与实际观测结果 \(H_t\) 的差异。

权重 \(\frac{1}{P(A_t)}\): 同样是逆概率权重,目的是使估计目标变为一个在所有可能模型对上均匀分布的虚拟分布下的BT分数。这确保了估计的公平性,不会偏向被频繁采样的模型对。

不确定性量化:

论文尝试了两种方法为BT分数估计构建置信区间:

Pivot Bootstrap: 一种重采样方法。

Sandwich Robust Standard Errors: 基于渐近理论的方法,对方差进行稳健估计。

最终选择: 根据模拟实验(附录A)的结果,选择了 Sandwich方法,因为在大样本下它能给出更小的(更精确的)置信区间。

🔵⏺️☀️一个大比喻:给一堆歌手(LLM模型)排名次

目标: 光有胜率不够,我们想给每个歌手一个绝对的实力分数(比如周深95分,邓紫棋93分…)。

计算方法: 用一个复杂的数学公式(最大似然估计),根据所有PK结果,反推出最有可能的那组分数。这个公式同样考虑了加权,保证公平。

分数的不确定性: 我们说“周深大概是95分”,但也可以算出“周深的真实分数有95%的可能性在93分到97分之间”。

3. Approximate rankings (近似排名)¶

目标: 获得一个考虑估计不确定性的排名,而不仅仅是基于点估计(如BT分数)的简单排序。

方法:

首先为所有模型的真实BT分数向量 \(s(\mathbb{P})\) 构建一个联合置信集 \(\mathcal{C}\)(公式 8)。这个置信集有至少 \(1-\alpha\) 的概率包含真实的分数向量。

对于每个模型 \(m\),其保守排名 \(R_m\) 通过以下方式计算:

查看所有其他模型 \(m'\)。

如果另一个模型 \(m'\) 的置信区间下限(最差可能情况)都高于模型 \(m\) 的置信区间上限(最好可能情况),即 \(inf\mathcal{C}_{m‘} > sup\mathcal{C}_m\),那么就认为 \(m'\) 的排名肯定高于 \(m\)。

模型 \(m\) 的排名 \(R_m\) 就是 1 加上所有肯定比它好的模型 \(m'\) 的数量。

统计保证:

这种方法提供的排名是保守的。它保证了(以高概率)没有模型的表现会被低估(即它的报告排名 \(R_m\) 不会比其真实排名

rank(ℙ)m更差)。要保证没有模型被高估,只需交换inf和sup的逻辑。论文使用基于渐近正态理论和Sandwich方差的卡方区间来构造这个联合置信集 \(\mathcal{C}\)。

🔵⏺️☀️一个大比喻:给一堆歌手(LLM模型)排名次

问题: 如果周深是

95±2分,邓紫棋是93±2分,那么周深一定比邓紫棋强吗?不一定,因为周深有可能最低93分,邓紫棋有可能最高95分,两人实力可能非常接近。解决方法(保守排名):

我们做一个非常保守的假设:周深按最差情况算(93分),邓紫棋按最好情况算(95分)。

这时,如果邓紫棋的最好情况(95分)还是比周深的最差情况(93分)高,那我们就能百分之百确定邓紫棋排名比周深高。

如果像这个例子一样,两人分数区间有重叠,我们就认为他们名次并列。

最终结果: 这样排出来的名次非常可靠。它保证不会冤枉任何一个歌手,不会把实力强的歌手排到实力弱的歌手后面。

4. Active sampling rule (主动采样规则)¶

目标: 说明如何智能地选择让用户比较哪些模型对,以高效地降低估计的不确定性。

方法: 公式 (9) 定义了一个自适应采样概率 \(P_t(a)\)。

核心思想: 优先采样那些能带来最大信息增益的模型对。具体来说,是采样那些能最大程度减少置信区间体积(此处用标准误 \(\sqrt{\Sigma_{t,a,a} / n}\) 来衡量)的模型对 \(a\)。

公式解读: 采样概率 \(P_t(a)\) 与“当前已采样次数下 \(a\) 的标准误”减去“如果再采样一次 \(a\) 后的标准误”成正比。这个差值代表了“再采样一次 \(a\) 所能带来的不确定性减少量”。减少得越多,这个对就越值得采样。

🔵⏺️☀️一个大比喻:给一堆歌手(LLM模型)排名次

目标: 让哪两个歌手PK,才能最快地确定大家的真实实力?

策略: 优先安排那些**“最说不准”** 的PK。

比如,周深和邓紫棋的实力一直没比明白,他俩的胜负不确定性很大,那就多安排他们俩PK。

比如,毛不易和某位新歌手,实力悬殊很大,结果一目了然,那就少安排他们PK。

好处: 用最少的PK次数,最快地得到最精确的排名。

5.1 Detecting Anomalous Users (检测异常用户)¶

本节是一个相对独立的部分,旨在识别可能是机器人或刷票者的异常用户行为。

核心思想: 将一个新用户的投票模式与历史数据中相同模型对下的投票分布进行比较。

方法:

计算逐次p值 (\(p_i\)): 对于新用户的第 \(i\) 次投票(投给了模型对 \(A‘_i\),结果是 \(H’_i\)),计算一个 p值(公式 10)。这个 p值衡量的是,在历史上所有针对同一模型对 \(A‘_i\) 的投票中,新用户的这次投票结果 \(H’_i\) 有多么极端(例如,\(p_i\) 很小意味着这次投票结果比历史记录好得出奇)。在零假设(用户行为正常)下,\(p_i\) 服从均匀分布。

组合p值进行检验: 随着该用户投票次数 \(j\) 的增加,使用 Fisher组合检验 将前 \(j\) 次投票的 p值 (\(p_1, ..., p_j\)) 组合成一个统计量 \(M_j = -2 \sum_{i=1}^j \log(p_i)\)。

决策: 在用户投票过程中的5个随机时间点(防止恶意用户规避检测)进行检查。如果 \(M_j\) 超过了卡方分布的临界值(\(\chi^2_{2j, 1-\alpha/5}\)),就认为该用户是异常的。

总结: 这是一种统计异常检测方法,通过比较用户投票与历史分布的一致性,并经过多次随机抽查,来有效地识别可疑行为。

6 Data Analysis¶

本节主要验证了 Arena 数据集是否反映了真实世界中的使用场景,通过主题建模分析用户提示(prompts)的多样性,并探讨这些提示在区分模型性能方面的有效性。最后,还验证了用户投票的质量,通过专家重新标注数据进行评估。

6.1 用户提示的主题建模分析(Topic Modeling on User Prompts)¶

为了研究用户提示的多样性,作者构建了一个基于 BERTopic 的主题建模流水线,使用 OpenAI 的 text-embedding-3-small 模型将提示转换为向量表示。

为了降低维度并缓解“维度灾难”,使用 UMAP 将向量从 1,536 降维到 5 维。然后使用 HDBSCAN 聚类算法(最小簇大小为 32)对提示进行分组,最后从每个簇中抽取 10 个提示,用 GPT-4-Turbo 对簇主题进行总结。

结果发现,共识别出 600 个主题簇,覆盖了从诗歌写作、编程、数学到医疗查询等多个领域。最大的簇仅占提示总数的 1%,其余均小于 0.5%,说明用户提示的分布具有明显的长尾和多样特性。

作者展示了前 16 个主题簇的相似性矩阵(图 3),并附有 前 64 个簇的相似性矩阵与层级结构图(图 11、12)在附录中。

6.2 Arena 提示是否能区分模型性能?(Can Arena Prompts Distinguish Models?)¶

作者进一步研究了这些主题簇是否能够有效区分不同模型的性能。由于 LLM 能力迅速提升,构造挑战性提示变得愈加困难。例如,Llama-2-70b-chat 在电影推荐或旅行建议方面可能与 GPT-4 表现相当,但在代码或推理任务上差距明显。

作者从 7 个主题簇中随机抽取 30 个提示,使用 GPT-4 作为评估者(LLM-as-judge) 对 Llama-2-70b-chat 和 GPT-4 的响应进行比较。

结果显示,GPT-4 在需要编程和推理的任务中胜率高达 97%,而在问题解决要求较低的簇中(如诗歌创作或旅行建议),胜率则下降到 60% 以下。这表明不同模型在不同领域具有不同优势,也说明 Arena 的部分主题簇能有效区分模型。

主题簇 |

GPT-4 胜率 |

簇大小(%) |

|---|---|---|

Python 游戏编程挑战 |

96.7% |

0.2% |

C/C++ 多线程编程 |

86.7% |

0.3% |

SQL 数据库查询 |

73.3% |

0.2% |

诗歌创作提示 |

66.7% |

1.1% |

Python 基础编程 |

65.0% |

0.2% |

语言分析与文字游戏 |

58.3% |

0.7% |

旅行行程规划 |

58.3% |

0.4% |

电影推荐与评分 |

53.3% |

0.2% |

构建高质量基准(Building Challenging Benchmark)

作者进一步说明,可以使用用户提示构建一个具有挑战性的基准测试(Arena Bench)。通过从每个主题簇中挑选具有挑战性的问题,作者验证了这些提示在区分模型方面非常有效。图 4 展示了 Arena Bench 与 MT-Bench 的比较,发现 Arena Bench 更能揭示开源模型与专有模型之间的性能差距。

6.3 验证用户投票质量(Validating Vote Quality)¶

为了评估用户投票的可靠性,作者随机选取了 160 场对比战(battles),分别比较了 GPT-4-Turbo 与 Llama-2-13B,以及 GPT-4-Turbo 与 GPT-3.5-Turbo-0613 的响应,并请 加州大学伯克利分校的研究生专家 重新标注用户偏好。

专家在不了解模型身份的前提下,通过外部资源(如搜索引擎)进行事实核查,每条数据平均耗时 3-5 分钟。作者还使用 GPT-4 作为裁判 对比模型响应。

结果表明,用户投票与专家的一致性在 72% 到 83% 之间,专家之间的一致性也在 79% 到 89% 之间。部分差异是由于某些提示没有明确答案,不同评价者可能认为两个答案各有优劣(见附录 D.4)。

差异中的 5%-10% 是由于普通用户在判断时可能遗漏或错误地评估了模型回答中的事实错误。总体来看,用户投票质量较高。

Llama-2-13b |

专家 1 |

专家 2 |

GPT-4 |

|---|---|---|---|

用户投票 |

72.8% |

77.8% |

75.6% |

专家 1 |

- |

89.8% |

81.0% |

专家 2 |

- |

- |

78.5% |

基线 |

用户投票 |

专家 1 |

专家 2 |

GPT-4 |

|---|---|---|---|---|

Llama-2-13b |

81.2% |

89.4% |

86.9% |

78.8% |

GPT-3.5-Turbo |

76.3% |

82.5% |

89.4% |

79.4% |

总结¶

本节通过三种方式验证了 Arena 数据集的可靠性:

主题建模:用户提示具有高度多样性;

模型区分力:部分提示能有效区分模型性能;

用户投票质量:用户投票与专家判断一致率较高,说明具有一定的可信度。

这些分析表明,Chatbot Arena 平台的数据集和投票机制能够较为准确地反映模型性能差异,是一个有价值的模型评估工具。

7 Experiments¶

7 实验¶

7.1 排名系统¶

计算真实数据上的排名¶

本节报告了我们在近似排名上的实验结果。我们使用平台历史上的 T = 213,576 次投票数据,进行了回放实验,并通过之前描述的估计算法计算了 Bradley-Terry(BT)系数,同时计算了置信区间。图5展示了在使用和未使用多重修正(multiplicity correction)情况下的置信区间。虽然理论上计算排名需要多重修正以确保所有分数的置信区间都被同时包含(从而确保排名的准确性),但这样做会带来更保守的结果,因此我们同时报告了两种方法下的置信区间。

重点:图5显示了使用和未使用多重修正的置信区间,强调了多重修正对置信区间的保守性影响。

评估置信区间的覆盖率¶

一个自然的问题是,这些置信区间是否能够以概率至少 1−α 捕捉真实的 BT 系数。由于这个问题无法在真实数据上评估,我们进行了模拟实验。我们从一个 β(1/γ, 1/γ) 分布中生成 BT 系数向量,γ = 2,并合成数据集进行 20 次试验,评估置信区间的覆盖率和平均宽度。图6展示了不同模型数量下的区间行为,结果显示覆盖率集中于 1−α,模型数量越多,置信区间越宽。

重点:覆盖率与理论预期一致(约为 1−α),模型数量增加时区间变宽,说明模型间比较的不确定性提高。

评估主动采样规则¶

我们评估了用于估计赢矩阵(win matrix)的主动采样规则(见公式9)。通过在 213,576 份保留数据集中取最优拟合的 BT 系数,并使用主动采样算法进行采样。结果显示主动采样在估计精度方面显著优于随机采样。例如,要达到 0.2 的精度,随机采样需要 6,800 个样本,而主动采样只需 4,400 个;对于 0.3 的精度,随机采样需要 17,200 个样本,而主动采样只需 16,400 个。这说明主动采样在样本效率上分别减少了 54% 和 5% 的数据量。

重点:主动采样在样本效率上优于随机采样,且在所有样本数量下表现更优。

7.2 异常用户检测¶

异常用户检测评估¶

我们评估了第5.1节中的异常用户检测方法。构建了一个包含 25 个异常用户和 25 个正常用户的评估集,其中异常用户的行为高度重复或无意义(如重复发送“hi”或输入乱码)。对每个用户计算统计量 Mj,如果其超过一定阈值(χ² 分布临界值),则判定为异常用户。

在不同显著性水平 α 下评估了检测性能(见表5),结果显示该方法具有较高的检测能力(如 90% 的真正例率和 60-70% 的真反例率)。不过,部分假反例是由于这些用户并不总是表现出异常行为,因此更难检测。

重点:检测方法在多数情况下表现良好,但对行为不稳定的异常用户检测效果有限。

8 Discussion¶

8 讨论¶

Limitations(局限性)¶

本节主要讨论了研究中存在的几个局限性。

用户群体的偏差

虽然研究的用户基数较广,但预计用户将主要由LLM爱好者和研究人员构成,他们倾向于尝试和评估最新的大语言模型(LLMs)。这种用户构成可能导致样本分布存在偏倚,即结果可能无法代表普通用户的实际使用情况。数据来源的局限性

尽管研究中涉及的提示(prompt)话题范围较广,但大部分数据来自在线聊天接口。这种数据来源可能无法准确反映LLMs在生产环境或专业领域中的实际使用情况,从而导致提示分布的偏倚。忽视模型的安全性

本研究的重点是评估LLMs的有用性(helpfulness),但忽略了安全性(safety)方面的评估。作者指出,建立一个并行的安全性评估机制是必要且可能的。

Future Directions(未来方向)¶

本节提出了未来的研究方向和改进计划。

构建更全面的评估体系

未来计划开发综合性主题排行榜(topic leaderboards),并设立专门的板块用于评估多模态(multimodal)和基于代理(agent-based)的LLMs。这些评估将设置在更动态、更具游戏化(gamified)的环境中,以应对更复杂的任务。改进有害用户检测方法

作者认为当前对有害用户(harmful users)的检测方法仍有改进空间。他们提出可以借鉴非负超鞅(nonnegative supermartingales)和E值(E-values)的理论(参考Howard et al., 2020;Waudby-Smith & Ramdas, 2020;Vovk & Wang, 2021;Ramdas et al., 2023),以更严谨的方式处理数据依赖问题。但作者也指出,他们尝试的变体在统计功效(statistical power)方面表现不佳。

总结:

本节重点讨论了当前研究存在的用户偏倚、数据来源限制和安全性不足三大问题,并提出了未来在评估体系构建和有害用户检测方法改进方面的工作方向。

9 Conclusion¶

9 结论¶

在本论文中,作者提出了 Chatbot Arena,这是一个开放平台,通过众包方式收集用户对大语言模型(LLMs)的成对偏好,从而对模型进行评估。平台的核心在于利用真实用户的反馈来衡量不同模型的表现。

作者对众包用户提交的提示(prompts)和偏好投票(preference votes)进行了深入分析,以验证其多样性和质量。这是平台数据可信度和实用性的关键部分。

为了有效处理大量的模型对比数据,作者开发了一种高效的模型抽样和排序算法,这对于在大量模型中识别出表现更优的模型至关重要。这部分是技术实现的重点之一。

最后,作者承诺将发布一个包含10万个成对偏好投票的数据集,为后续研究提供宝贵资源。这将是未来研究的重要基础,也是本论文的重要贡献之一。

Acknowledgments¶

致谢¶

本项目得到了Kaggle、MBZUAI、a16z、Together AI、Anyscale和HuggingFace的赞助支持。还部分得到了Accenture、AMD、Google、IBM、Intel、Microsoft、Samsung SDS、SAP、Uber和VMware的支持。作者特别感谢Siyuan Zhuang的深入讨论,以及Tijana Zrnić对论文稿件的有益反馈。

Appendix A Confidence Interval Simulation Study¶

附录 A 置信区间模拟研究¶

本节通过模拟研究比较了自助法(bootstrap)置信区间与夹心法(sandwich estimator)置信区间的表现。

主要结论:¶

整体而言,两种方法在大多数情况下生成的置信区间非常接近,甚至在视觉上难以区分。但在某些实验中,仍观察到一些差异。

第一个实验(图13):¶

使用主文中提到的213576个数据点,进行回放实验(replay study)。

图13展示了两种方法的区间、覆盖率和平均区间大小。

夹心法区间在小样本中更宽,但更稳定;而在大样本中,其区间反而更小。

两种方法均使用了多重性校正(multiplicity corrected version),因此它们的覆盖率都为1。

注意:这里的覆盖率是相对于完整数据集上的Bradley-Terry(BT)系数解计算的,因此不如后续模拟中的覆盖率更具统计意义。

第二个实验(图14):¶

基于主文中相同的β分布生成过程,设置参数 γ=2,进行一系列合成实验(synthetic experiment)。

结果显示,无论 γ 和模型强度如何变化,两种方法的区间表现都良好。

图14中:

左图:系数从BT系数分布中抽样。

中图:未校正区间的覆盖率。

右图:区间宽度的折线图,几乎完全吻合。

此结果表明,两种方法在实际应用条件下都具有良好的覆盖率和区间宽度。

总结:¶

bootstrap 和 sandwich 置信区间在视觉上几乎相同,但在小样本中 sandwich 置信区间更稳定。

在多种参数设置下,两者均表现良好,适用于实际应用。

实验结果支持两种方法在大多数实际情境中是可靠且可互换的。

Appendix B The Nonparametric Bradley-Terry Model¶

以下是论文附录 B “The Nonparametric Bradley-Terry Model” 的内容总结,按照原文结构顺序进行讲解,重点内容进行详细讲解,次要内容适当精简:

附录 B:非参数 Bradley-Terry 模型¶

非参数 Bradley-Terry (NBT) 模型¶

本节考虑 Bradley-Terry (BT) 模型的一个非参数扩展,用于处理模型排名可能不具有传递性的情况。传统的 BT 模型假设模型之间的胜负概率具有固定的、使用参数的形式(如指数函数),但 NBT 模型不依赖于这样的参数假设,具有更强的鲁棒性。

1. 定义路径集合 𝒢(m)¶

设 𝒢(m) 表示所有从模型 1 到目标模型 m 的路径集合,每个路径是一个由模型配对组成的链:

其中,\(\mathcal{B} = \mathcal{A} \cup \{ (a_2, a_1) : a \in \mathcal{A} \}\),表示所有可能的模型配对及它们的反向。

每个路径是一个模型之间的比较序列,最终指向目标模型 m。

例如,若 m = 5 且 M = 6,则一个路径可能是:((1,2), (2,4), (4,3), (3,6), (6,5))。

2. 定义得分函数 s(θ)_m¶

非参数 BT 模型的得分函数是所有路径对数概率的平均,定义为:

其中,θ’ 是对 θ 的扩展函数,根据 a 是否属于原始配对集合 \(\mathcal{A}\) 进行调整。

重点在于:这一得分函数是基于所有路径的平均得出的,具有良好的数学性质,例如光滑性与良定义性(总是存在)。

3. 简化后的表达式¶

通过分析路径的结构和对称性,作者推导出得分函数可以简化为:

这个简化形式表明,得分函数可以看作是对每个模型对 (m’, m) 的比较进行加权求和。

重点:这种形式使得模型在非传递性下仍具有可解释性和可计算性。

4. 与传统 BT 模型的关系¶

传统 BT 模型假设模型 m 与 m’ 的胜负概率为:

其中 \(\xi_1, \xi_2, ..., \xi_M\) 是 Bradley-Terry 系数,表示模型的强度。

传统 BT 的目标是通过观察胜负数据估计这些参数。

而在 NBT 模型中,得分函数经过推导可以还原出这些参数 \(\xi_m\)。即:

如果传统 BT 模型的参数形式是正确的(well-specified),那么 NBT 模型将精确恢复 Bradley-Terry 系数。

重点:NBT 不依赖于传统 BT 的参数形式,因此即使胜负概率不满足传递性、非二元、或者逻辑回归形式被误设(misspecified),NBT 依然有效。

5. 非参数模型的优势¶

不依赖参数假设:适用于更一般的胜负数据。

鲁棒性强:不假设胜负概率具有特定形式。

统计有效性:即使在传统 BT 模型假设不成立时,也能提供可靠的估计。

实用性强:可以通过公式(20)直接计算非参数 BT 系数。

总结¶

本节提出了一种非参数的 Bradley-Terry 模型,通过定义路径集合和得分函数,能够在不依赖传统 BT 模型参数假设的情况下,进行模型排序估计。这种方法具有更高的灵活性和鲁棒性,适用于非传递性或模型形式未知的场景。其核心优势在于:

理论保障:得分函数可还原传统 BT 系数。

广泛应用:不依赖胜负是否二元或模型是否满足传递性。

计算简便:可通过简洁表达式直接计算模型得分。

Appendix C Valid P-Value¶

本节的目的是证明一个p值的定义是有效的,即在零假设成立(数据点是可交换的)下,满足p值的基本性质:

对任意的 \(t \in [0, 1]\),有 \(\mathbb{P}(p_i \leq t) \leq t\)。

1. p值的定义¶

定义的p值如下:

其中,\(\mathcal{H}_{A'_{i}}\) 表示与样本 \(A'_i\) 相关的统计量集合;

\(H'_i\) 是样本 \(A'_i\) 对应的统计量;

\(\mathds{1}\{h \geq H'_i\}\) 是一个指示函数,若 \(h \geq H'_i\) 则为1,否则为0;

该p值的计算方式是在这个集合中统计比 \(H'_i\) 大或等于的统计量的数量,加上1,然后除以集合大小加1。

2. p值的等价表达式¶

为了方便证明,作者给出了一个等价表达式:

其中,\(\mathcal{H}' = (H_t : A_t = A'_i) \parallel (H'_i)\),即所有属于序列 \(A'_i\) 的统计量,加上 \(H'_i\) 本身的合集;

该公式更直观地表示了 \(p_i\) 是在整个集合中,有多少统计量大于等于 \(H'_i\),然后除以集合的大小。

3. 有效性证明的关键步骤¶

第一步:构造不等式¶

为了证明 \(p_i\) 是有效的,作者给出了一个不等式链:

其中 \(k = \lfloor t |\mathcal{H}'| \rfloor\)。即,\(k\) 是不超过 \(t |\mathcal{H}'|\) 的最大整数。这个步骤是为了将连续的 \(t\) 转换成离散的 \(k\),便于后续分析。

第二步:利用可交换性假设¶

假设 \(\mathcal{H}'\) 是可交换的(exchangeable),即每个统计量在集合中是“对称”的,没有特别的位置。

在这种情况下,\(H'_i\) 在 \(\mathcal{H}'\) 中的排名是均匀分布的;

因此,\(p_i\) 表示的是一个“随机排名”中大于等于某值的概率;

由此可得: $\( \mathbb{P}\left(p_i \leq \frac{k}{|\mathcal{H}'|}\right) \leq \frac{k}{|\mathcal{H}'|} \leq t \)$

4. 证明结论¶

结合上述不等式链:

可得最终结论:

即,p值是有效的。

总结¶

本节定义了一个p值的表达式,并在零假设下(数据点可交换)证明了其有效性;

有效性的关键在于利用了可交换性假设,从而使得统计量在集合中的排名是均匀的;

通过构造不等式链,最终证明该p值满足 \(\mathbb{P}(p_i \leq t) \leq t\),符合p值的基本性质;

重点在于p值的定义形式和可交换性假设的应用,其余为推导步骤。

Appendix D Sample Prompts¶

D.1 不同聚类的提示示例¶

示例 1: 来自“Python 游戏编程挑战”聚类的示例用户提示¶

此提示清楚地分离了 GPT-4-0613 和 Llama-2-70b-chat 的表现。用户请求“更高品质的代码”。GPT-4-Turbo 提供了正确的实现和有用解释,而 Llama-2-70b-chat 没有提供任何程序,总体响应也不如 GPT-4-Turbo 有用。

用户提示¶

开发一个类似于 Hangman 的雪人游戏,它绘制一个站在雪上的雪人图案,而不是 hangman。它还从(或使用库)下载完整的英语词典,选择三个难度级别的单词。一步一步思考,深呼吸,并为每一步选择高质量的代码。

GPT-4-0613 的回答¶

GPT-4-0613 提供了一个完整的代码实现和详细的步骤说明:

导入必要的库

下载英语词典文件

加载词典并按难度分类单词

创建随机选择单词的函数

创建打印雪人的函数

创建主游戏函数

运行游戏

Llama-2-70b-chat 的回答¶

Llama-2-70b-chat 提供了一个更通用的开发指南,但没有实际的代码实现,仅描述了步骤和所需库,但没有提供可运行的代码。

GPT-4-Turbo 的判决¶

GPT-4-0613 胜出,因为它提供了完整的代码实现和清晰的步骤说明,更符合用户的请求。

示例 2: 来自“Python 游戏编程挑战”聚类的示例用户提示¶

此提示清楚地分离了 GPT-4-0613 和 Llama-2-70b-chat 的表现。由于空间有限,每个助手的代码响应未列出。

用户提示¶

编写一个 Python 函数,打印一个由星号组成的圣诞树,唯一的输入是大小。

GPT-4-0613 的代码输出¶

GPT-4-0613 输出了格式化的圣诞树,每个层级的星号数量和排版都正确。

Llama-2-70b-chat 的代码输出¶

Llama-2-70b-chat 输出了一个倒置的圣诞树,星号的排列不符合标准圣诞树的形状。

GPT-4-Turbo 的判决¶

GPT-4-0613 胜出,因为它按正确的格式打印了圣诞树。

示例 3: 来自“电影推荐与评分”聚类的示例用户提示¶

两个助手都正确检索了电影信息,并给出了几乎相同的解释。因此,此提示无法区分 GPT-4-0613 和 Llama-2-70b-chat 的表现。

用户提示¶

哪部电影先上映,《盲井》还是《傅满洲的面具》?

GPT-4-0613 的答案¶

《傅满洲的面具》于 1932 年上映,《盲井》于 2003 年上映,因此《傅满洲的面具》先上映。

Llama-2-70b-chat 的答案¶

《傅满洲的面具》先上映,它于 1932 年上映,而《盲井》于 2003 年上映。

GPT-4-Turbo 的判决¶

平局,两个答案都正确且信息一致。

示例 4: 来自“旅行行程规划”聚类的示例用户提示¶

两个助手都提供了同样有帮助的行程。因此,此提示无法区分 GPT-4-0613 和 Llama-2-70b-chat 的表现。

用户提示¶

你能给我列一个在法国里尔和女朋友可以做的事情清单吗?

GPT-4-0613 的答案¶

GPT-4-0613 提供了详细的活动清单,包括博物馆参观、散步、美食探索等,共 15 项活动。

Llama-2-70b-chat 的答案¶

Llama-2-70b-chat 也提供了类似的活动清单,包括探索历史地标、参观博物馆、运河散步、购物等,共 15 项活动。

GPT-4-Turbo 的判决¶

平局,两个答案都提供了丰富且实用的活动建议。

D.2 Arena Bench 提示¶

示例 1: 一个来自 Arena Bench 的提示,要求非常高的复杂问题解决技能和推理能力,并符合现实应用。¶

创建一个用于日常习惯跟踪的 Flutter 应用。用户应能够创建多个日常任务,并将这些习惯分组。当用户完成一个任务时,会获得一定数量的积分。应用应有一个页面汇总每个组的总分,并汇总所有组的总分。此 Flutter 应用需要能够在 Android 和 iOS 上编译。

示例 2: 一个来自 Arena Bench 的提示,要求非常高的复杂问题解决技能和推理能力,并符合现实应用。¶

我想设置一个远程的 Raspberry Pi Zero,由太阳能板供电,使用简单的布线。我想用它来驱动一个 2W 泵、一个简单的电容麦克风、以及一个在 Raspberry Pi 上运行的自定义 Python 脚本,用于分类麦克风检测到的音频。我需要哪些组件来优化成本并最小化任何电气工作(例如焊接)?我需要多大尺寸的太阳能板来为整个系统供电?

D.3 Arena Bench 系统提示¶

新颖的评估程序如下:我们将 GPT-4-Turbo 与系统提示、用户提示、参考答案和两个助手的答案一起提示。对于参考答案,我们向 GPT-4-Turbo 呈现用户提示和三个助手的答案(GPT-4-Turbo、GPT-4-0314 和 Claude-1),并要求 GPT-4-Turbo 生成一个答案。为了确保一致性的配对判断,我们将 GPT-3.5-Turbo-0301 设为所有模型比较的基准答案。为了避免位置偏差,我们对每个提示进行两次判断:第一次将基准答案设为助手 A,第二次设为助手 B。总共进行 700 次配对比较,每个模型与 GPT-3.5-Turbo-0301 进行比较,计算对基准的胜率。然后我们将胜率投射到 0 到 10 的范围内,将胜利评为 10,平局评为 5,失败评为 0。此外,我们将显著的胜利或失败评为 3 次胜利或失败,其他判断视为单次胜利、失败或平局。最后,通过计算胜利、失败和平局的平均值来计算最终得分。

D.4 无真实答案的 Arena 战斗¶

示例 1: GPT-4-Turbo 和 Llama-2-13B-chat 之间的 Arena 战斗示例,根据不同的偏好,任一答案都可以被认为是更好的。虽然两个答案都正确,但 GPT-4-Turbo 的答案简洁且适合多项选择题的格式。另一方面,Llama-2-13B-chat 为多项选择题提供了有帮助的解释。¶

用户提示¶

多项选择题 所有植物都有单倍体和双倍体形式。植物在从一种形式转变为另一种形式时,这被称为:

GPT-4-Turbo 的答案¶

世代交替

Llama-2-13B-chat 的答案¶

正确答案是:世代交替。植物和其他生物一样,有不同的生命周期阶段,可以存在两种不同的形式:单倍体和双倍体。单倍体形式是一套染色体,双倍体形式是两套染色体。当植物从一种形式转变为另一种形式时,这被称为世代交替。这个过程涉及单倍体和双倍体阶段的交替,是植物生命周期的基本方面。替代生命周期和演替不是这个过程的正确描述,因为它们指的是不同的概念。

判决¶

平局,两个答案都正确,但 GPT-4-Turbo 的答案更简洁,而 Llama-2-13B-chat 的答案更详细。

示例 2: GPT-4-Turbo 和 Llama-2-13B-chat 之间的 Arena 战斗示例,根据不同的偏好,任一答案都可以被认为是更好的。¶

用户提示¶

初创公司创始人产品思维的关键要素是什么?

GPT-4-Turbo 的答案¶

GPT-4-Turbo 提供了详细的关键要素列表,包括客户中心性、价值主张、问题解决焦点、迭代开发和数据驱动决策等。

Llama-2-13B-chat 的答案¶

Llama-2-13B-chat 也提供了类似的关键要素列表,包括客户中心性、迭代和实验、价值焦点、协作和数据驱动决策等。

判决¶

平局,两个答案都提供了全面且有深度的见解,内容相似但表述略有不同。