2512.13564❇️_MemorySurvey: Memory in the Age of AI Agents: A Survey¶

引用: 0(2025-12-20)

组织:

National University of Singapore,

Renmin University of China,

Fudan University,

Peking University,

Nanyang Technological University,

Tongji University,

University of California San Diego,

Hong Kong University of Science and Technology (Guangzhou),

Griffith University,

Georgia Institute of Technology,

OPPO,

Oxford University

GitHub: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

总结¶

方向

生成式记忆

RL 全面接管记忆策略

2. Preliminaries: Formalizing Agents and Memory¶

2.1 LLM-based Agent Systems

把各种看起来很不一样的 LLM Agent 系统,统一成一个标准的决策过程框架。无论你是 ReAct、Planner–Executor、Debate、Multi-Agent Coding,本质都能塞进同一个“环境—观察—策略—行动—轨迹”的盒子里。

核心三件事

LLM Agent 不等于环境 环境可以是代码仓库、网页、仿真器、共享白板、文件系统

动作会影响环境,但不一定是确定性的 比如搜索结果、API 返回、他人 agent 的后续行为

多 agent 不一定要显式通信 可以“通过环境间接耦合”,这点非常像黑板系统(blackboard architecture) 2.2 Agent Memory Systems

“Agent 的记忆”一个统一、抽象、可组合的形式化框架,而不是某一种具体实现

记忆是状态,不是日志,不是 buffer,不是数据库,而是一个“可演化的状态”

拒绝规定记忆长什么样,记忆可以是任何一种形式,本论文讨论的是记忆机制(mechanism)不是 存储结构(data structure)

记忆不是“存 → 用”这么简单,而是一个完整生命周期

三个“算子”(operators):Formation(形成)Evolution(演化)Retrieval(检索)

典型操作包括:合并冗余、冲突消解、丢弃低价值、重排结构以便检索

记忆的演进

最简单:直接把 observation 丢进去

最复杂:抽象模式、技能、规则

一套把“Agent 记忆”从具体实现中解放出来的时间—算子抽象框架,短期与长期记忆不是结构划分,而是形成、演化、检索在时间维度上的使用方式 2.3 Comparing Agent Memory with Other Key Concepts

LLM记忆

直接干预模型内部状态(如架构修改、缓存重写、注意力稀疏化)属于LLM记忆

其目标是扩展模型自身的表示能力,而非为决策智能体提供演化的外部记忆库

RAG

模块化RAG

对应智能体记忆中的检索阶段技术(如向量搜索)

图RAG

对应智能体记忆中的图结构记忆

关键区别:RAG的图通常是静态知识库,而智能体记忆的图是动态演化的经验表示

智能体化RAG

与智能体记忆的概念空间最接近

核心区别:智能体化RAG通常操作于外部、任务特定的数据库,而智能体记忆维护内部、持久、自演化的跨任务记忆库

上下文工程

上下文工程:是一种资源管理范式。

它将上下文窗口视为受限的计算资源,系统性地优化其中的信息载荷(指令、知识、状态、记忆),以最大化推理效能。

它关注的是信息的结构性组织、接口正确性和执行效率。

智能体记忆:是一种认知建模范式。

它关注的是为一个持续存在的实体维护一个具有演化身份的持久认知状态。

它定义智能体知道什么、经历过什么、以及这些如何随时间演化

3. Form: What carries Memory?¶

核心问题:记忆以何种物理或逻辑形式存在?

核心观点:

不存在一种万能记忆结构。

不同任务 → 需要不同“记忆形态”。

不同的存储形式决定了记忆的不同能力(如如何积累信息、保持行为一致性)。

分类依据:根据记忆存储的位置和表示的形式进行分类。

3.1 Token-level Memory

将信息存储为持久、离散的单元,这些单元可以从外部访问和检查。

“令牌”是一个广义概念,可以是文本、图像块、音频帧等任何可以脱离模型参数进行读写的离散元素。

特点:透明、易编辑、易解释

按拓扑复杂性将其分为三类:

扁平记忆Flat Memory (1D)

平面结构化记忆Planar Memory (2D)

分层记忆Hierarchical Memory (3D)

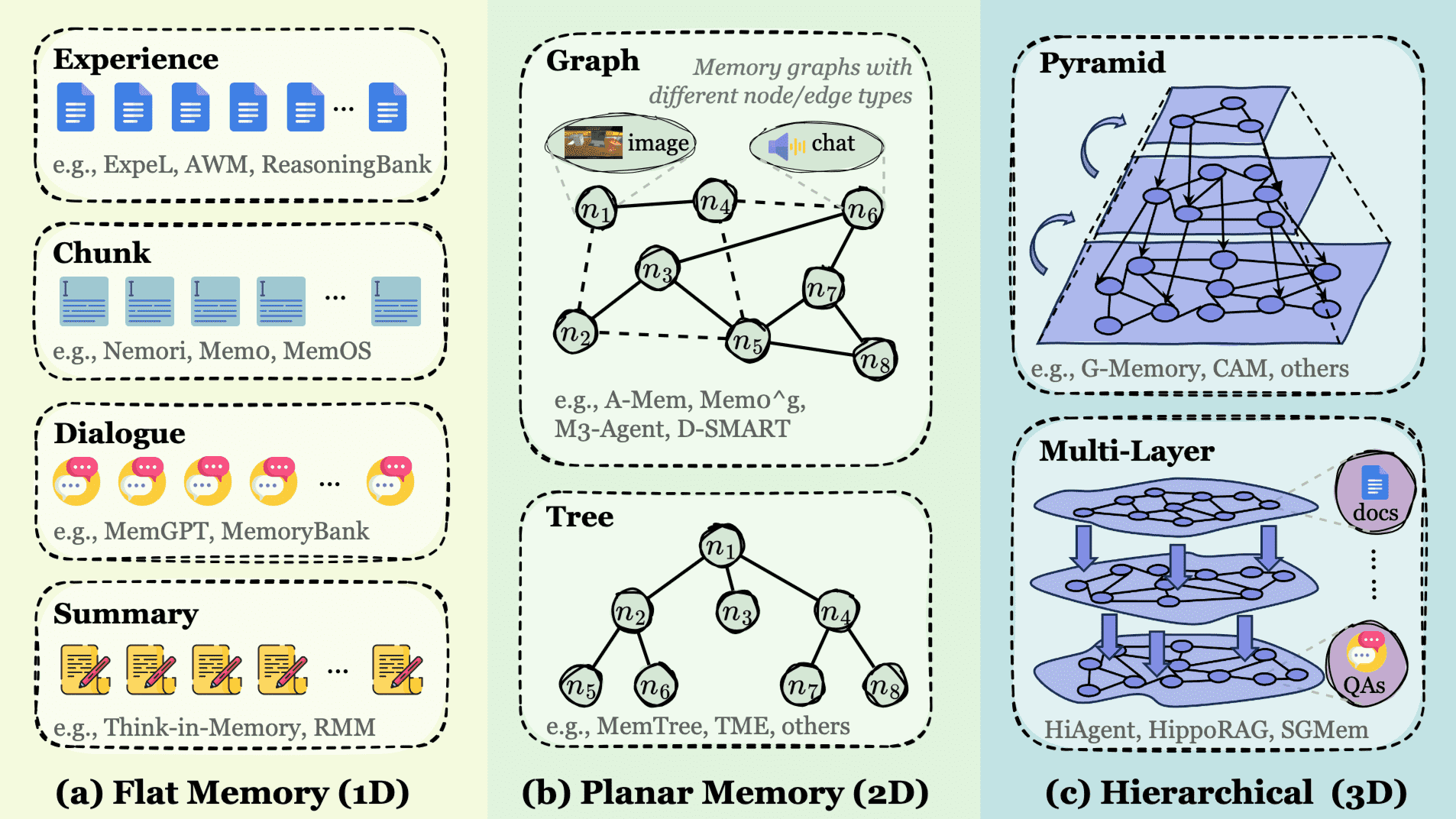

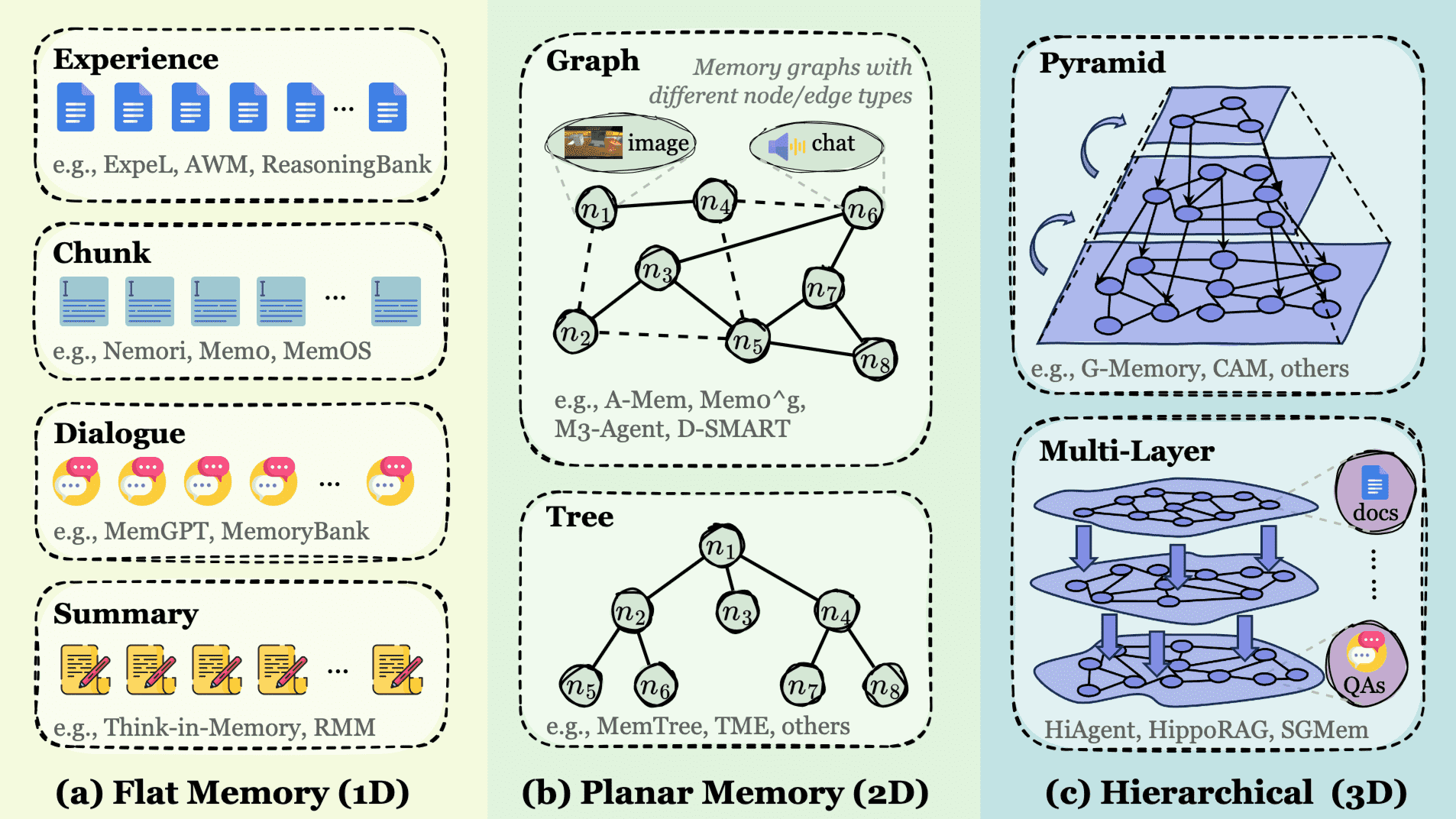

Figure 3 Taxonomy of token-level memory organized by topological complexity and dimensionality

总览¶

Key Questions ❶ How is agent memory defined, and how does it relate to related concepts such as LLM memory, retrieval-augmented generation (RAG), and context engineering? ❷ Forms: What architectural or representational forms can agent memory take? ❸ Functions: Why is agent memory needed, and what roles or purposes does it serve? ❹ Dynamics: How does agent memory operate, adapt, and evolve over time? ❺ What are the promising frontiers for advancing agent memory research?

各章节

Introduction: 进行了总体介绍

Preliminaries: 详细介绍了代理记忆系统的基本概念和定义,并对比了记忆与LLM memory、RAG和Context Engineering之间的区别。

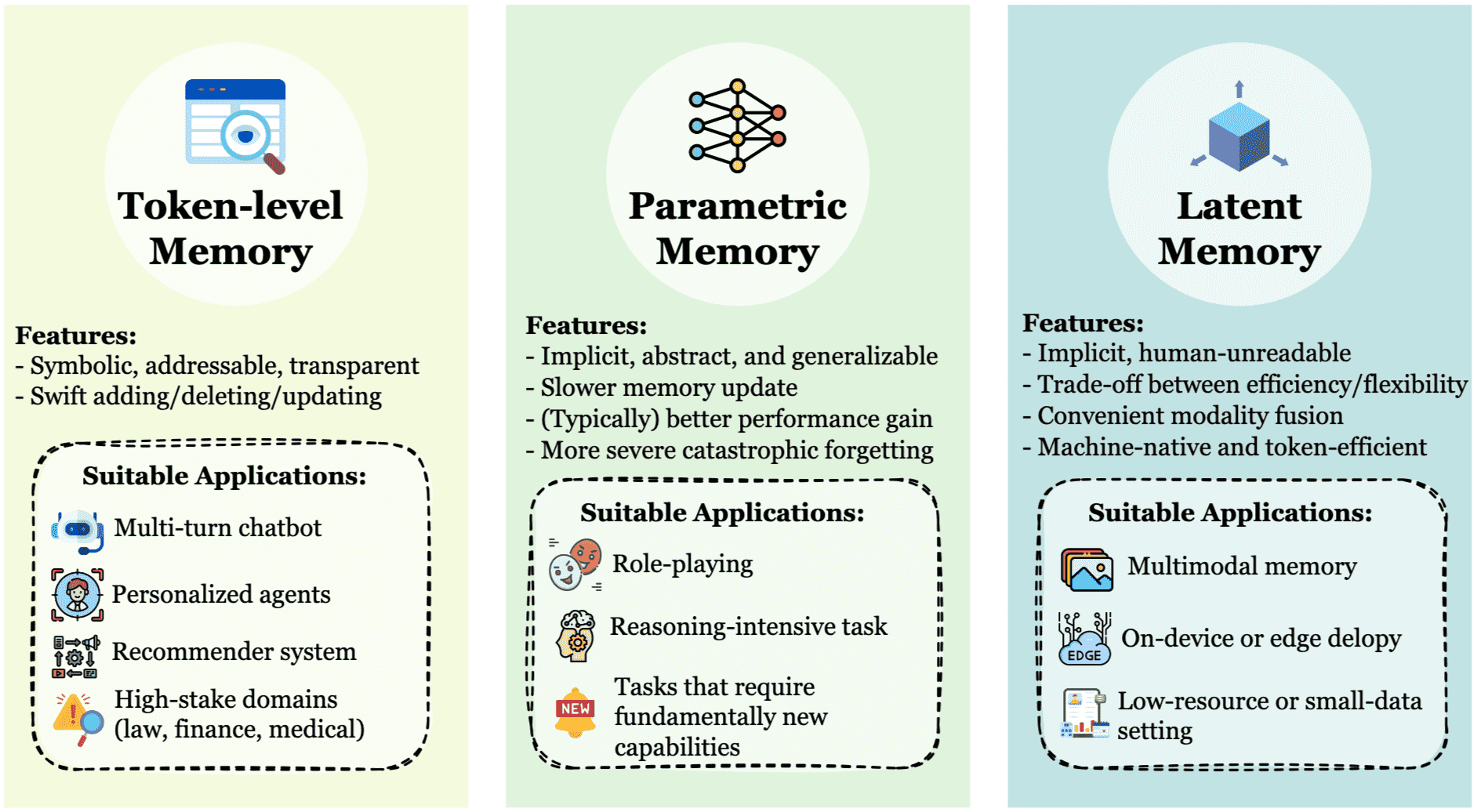

Forms: 详细介绍了代理记忆的架构或表征形式,并详细介绍了三种主要实现方式:Token-level Memory、Parametric Memory和Latent Memory。

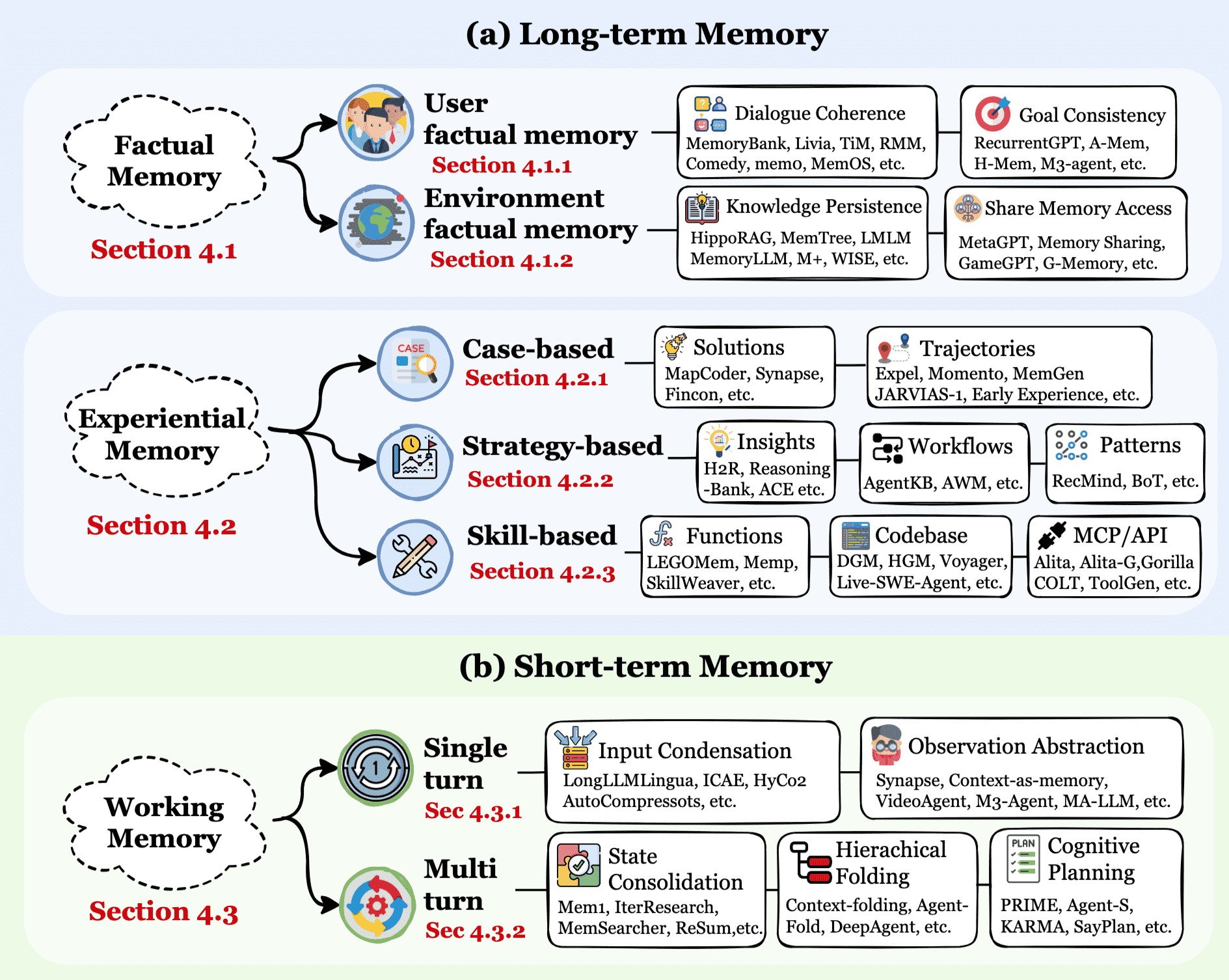

Functions: 详细介绍了代理记忆的功能,并详细介绍了三种主要功能:事实记忆、经验记忆和工作记忆。

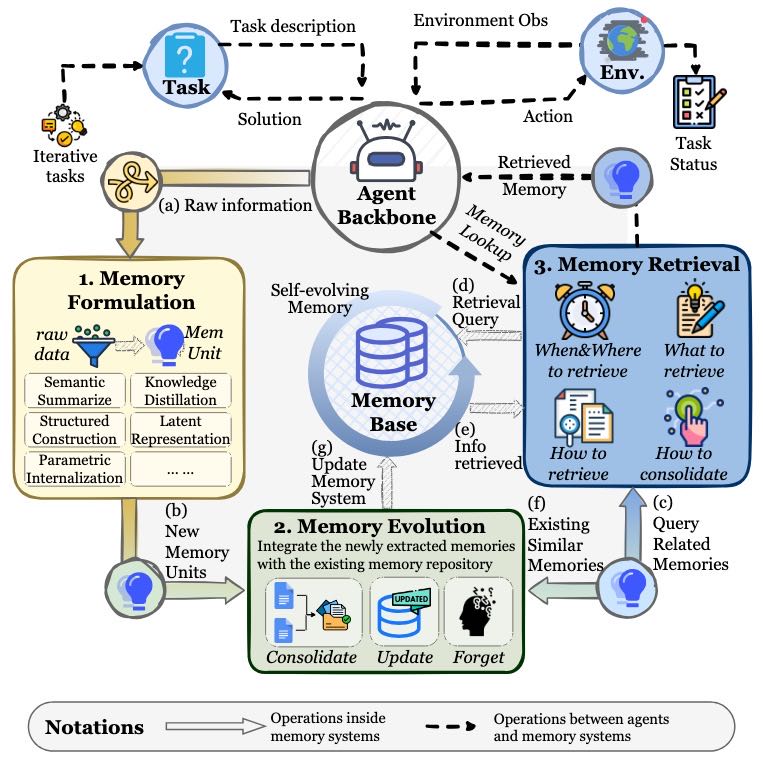

Dynamics: 详细介绍了代理记忆系统的动态过程,并详细介绍了三种主要算子:Memory Formation、Memory Evolution和Memory Retrieval。

Resources and Frameworks: 详细介绍了代理记忆系统的资源框架

Conclusions: 详细介绍了代理记忆系统的未来研究方向,并详细介绍了几种可能的方向,如自动化设计、RL集成、多模态和多智能体共享记忆等。

From Moonlight¶

三句摘要¶

🗺️ 这篇综述旨在解决AI智能体记忆研究领域日益碎片化的问题,明确界定其范围并与LLM memory、RAG和Context Engineering等相关概念区分。

📄 论文从形式(token-level, parametric, latent)、功能(factual, experiential, working memory)和动态(形成、演化、检索)三个统一视角,提供了一套全面的智能体记忆分类体系。

💡 该研究不仅梳理了现有工作,还总结了代表性基准和开源框架,并展望了自动化设计、RL集成、多模态和多智能体共享记忆等未来前沿方向。

关键词¶

AI Agents: AI Agents (人工智能代理) 是指由基础模型驱动的系统,它们除了核心的大语言模型(LLM)骨干外,还配备了推理、规划、感知、记忆和工具使用等能力。这些能力将静态的LLM转变为能够与外部环境交互并适应性进化的可学习策略,朝着通用人工智能(AGI)的方向发展。它们通过与环境的互动来适应和进化,记忆是实现这种能力的关键组成部分。

Agent Memory: Agent Memory (代理记忆) 是AI代理的核心能力,是实现代理长期推理、持续适应和有效与复杂环境交互的基础。它被形式化为一个不断演变的记忆状态Mt,用于存储和管理代理从先前互动中获得的信息。这种记忆系统支持代理的决策过程,并通过读写互动来运作,无论是在单次任务中(短期/会话内记忆)还是跨任务(长期/跨会话记忆)。它与LLM内存、RAG和上下文工程等概念有所区别,侧重于代理的认知状态和持久性。

Forms: Forms (形态) 指的是代理记忆的架构或表征形式。论文将其归纳为三种主要实现方式:Token-level Memory(令牌级记忆)、Parametric Memory(参数记忆)和Latent Memory(潜在记忆)。这三种形态决定了记忆信息的存储、组织和更新方式,从而影响代理如何累积信息和保持行为一致性。

Functions: Functions (功能) 指的是代理记忆存在的目的和所扮演的角色。论文将其分为三个主要支柱:Factual Memory(事实记忆)、Experiential Memory(经验记忆)和Working Memory(工作记忆)。这些功能协同工作,使代理能够保持交互的一致性、进行持续学习和自我进化,以及管理当前任务的活动上下文。

Dynamics: Dynamics (动态) 指的是记忆系统如何随时间形成、演变和检索。论文将其分解为三个概念性算子:Memory Formation(记忆形成),即代理产生信息产物并将其转化为记忆候选;Memory Evolution(记忆演化),即整合新记忆候选到现有记忆库,进行巩固、冲突解决或丢弃低效信息;以及Memory Retrieval(记忆检索),即在决策时根据上下文检索相关记忆信号。

Token-level Memory: Token-level Memory (令牌级记忆) 指的是将信息存储为外部可访问、可检查的、离散的单元(称为“令牌”)。这些令牌可以是文本、图像或音频等离散元素。它们是透明的、易于编辑的,并且可以存储在结构化形式中。令牌级记忆可以进一步细分为Flat Memory(平坦记忆,1D)、Planar Memory(平面记忆,2D)和Hierarchical Memory(层级记忆,3D),分别对应不同的组织拓扑复杂性。

Parametric Memory: Parametric Memory (参数记忆) 指的是将信息直接存储在模型的参数中,信息通过参数空间的统计模式进行编码,并在前向计算中隐式访问。它不像令牌级记忆那样是可见和可编辑的。根据存储位置,Parametric Memory又分为Internal Parametric Memory(内部参数记忆,直接嵌入模型原始权重)和External Parametric Memory(外部参数记忆,存储在适配器或辅助参数集中)。

Latent Memory: Latent Memory (潜在记忆) 指的是在模型内部表征(如KV缓存、激活、隐藏状态、潜在嵌入)中隐式携带的记忆,而非显式的人类可读令牌或专用参数集。它不暴露记忆的明文,并且可能引入较少的推理延迟,同时通过保留模型自身表征空间中的精细上下文信号来提供更好的性能。根据其来源,Latent Memory被分为Generate(生成)、Reuse(复用)和Transform(转换)三种类型。

Factual Memory: Factual Memory (事实记忆) 指的是代理存储和检索关于过去事件、用户特定信息和外部环境状态的显式、陈述性事实的能力。它是代理的陈述性知识库,旨在确保交互的一致性、连贯性和适应性。它回答“代理知道什么?”的问题。Factual Memory可进一步细分为User factual memory(用户事实记忆)和Environment factual memory(环境事实记忆)。

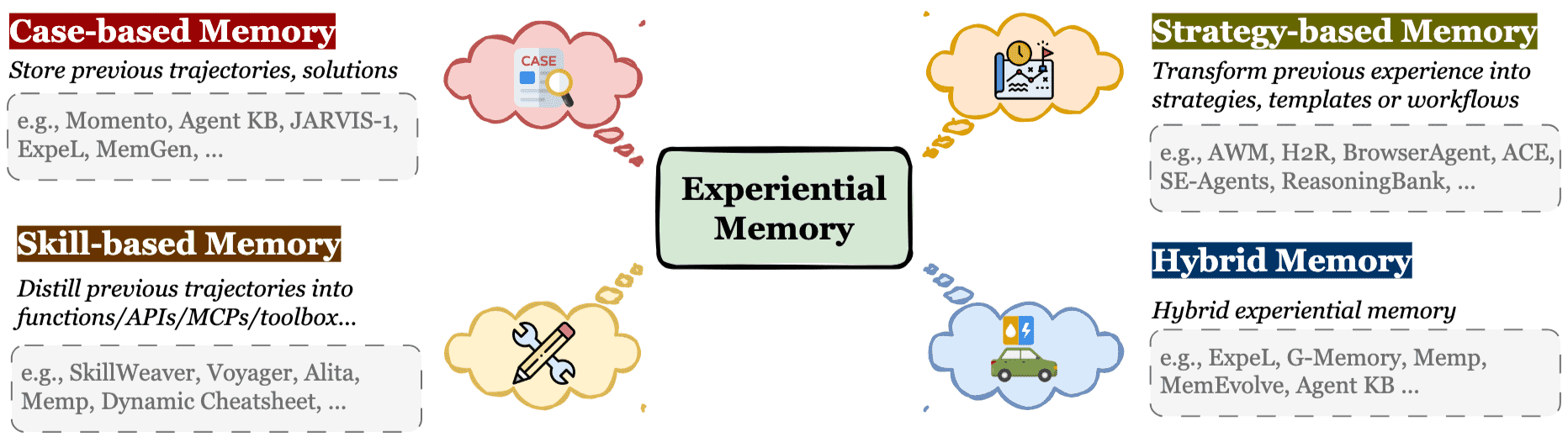

Experiential Memory: Experiential Memory (经验记忆) 指的是代理从过去轨迹、失败和成功中累积的程序性和策略性知识。它的目的是实现持续学习和自我进化,帮助代理提高问题解决能力。它回答“代理如何改进?”的问题。这种记忆通常基于代理的互动经验,通过抽象化和泛化来形成可重用的策略或技能。

Working Memory: Working Memory (工作记忆) 指的是代理在单个任务或会话期间用于主动上下文管理的、容量有限的、动态控制的“草稿板”。它为代理的当前推理提供即时信息支持。它回答“代理现在在思考什么?”的问题,是短期记忆的一种形式,负责处理当前需要处理的信息。

LLM Memory: LLM Memory (LLM记忆) 指的是早期研究中用于描述LLM内部或与其紧密集成的记忆机制的概念,包括管理Transformer的KV缓存、设计长上下文处理机制等。论文认为,在当前更成熟的代理概念下,许多“LLM记忆”实际上属于Agent Memory的范畴。但专门针对模型内部状态优化的工作(如架构修改以支持更长上下文)被视为LLM Memory,而与代理的决策循环和外部状态交互无关。

Retrieval-Augmented Generation (RAG): Retrieval-Augmented Generation (RAG) (检索增强生成) 是一种技术,它通过在生成过程中检索外部知识来增强LLM的能力,以期提高生成内容的准确性、减少幻觉。RAG系统通常从静态知识源中检索信息,而Agent Memory则更侧重于代理与环境的持续交互中不断累积和演变的信息。尽管两者在技术实现上有重叠(如向量索引),但RAG主要用于增强单个推理任务,而Agent Memory则侧重于代理的长期、多任务交互和适应性。

Context Engineering: Context Engineering (上下文工程) 是一种设计方法论,它将上下文窗口视为一种受限的计算资源,并通过优化其中包含的信息(指令、知识、状态、记忆)来提高LLM的推理效率。从上下文工程的角度看,Agent Memory只是需要有效调度的上下文组件之一。而从Agent的角度看,上下文工程是确保认知连续性在模型物理限制内的实现层。两者在短时文本处理和工作记忆实现上高度重叠,但在支持长期代理、跨任务持久性等方面存在概念上的差异。

Memory Lifecycle: Memory Lifecycle (记忆生命周期) 描述了记忆系统如何运作、适应和随时间演变。论文将其形式化为三个概念性算子:Memory Formation(记忆形成),即将代理的行动产物(如工具输出、推理轨迹)转化为潜在有用的记忆;Memory Evolution(记忆演化),即将新形成的记忆整合到现有记忆库中,进行巩固、冲突解决、丢弃等操作,使其保持更新和高效;以及Memory Retrieval(记忆检索),即根据代理的当前观察和任务需求,从记忆库中提取相关信息以辅助决策。

摘要¶

这篇调查论文深入探讨了AI智能体记忆(Agent Memory)这一核心能力,旨在为该领域日益碎片化的研究提供一个统一且全面的视角。论文指出,当前对智能体记忆的理解存在概念模糊和分类不足的问题,传统的长/短期记忆分类已无法涵盖其多样性和动态性。因此,该调查提出了一个全新的“形式-功能-动态”(Forms-Functions-Dynamics)统一分类法,并详细阐述了智能体记忆与LLM记忆、RAG(Retrieval Augmented Generation)和上下文工程(Context Engineering)等相关概念的区别与联系。

1. 智能体与记忆系统的形式化定义 (Preliminaries: Formalizing Agents and Memory) 论文首先形式化了基于LLM的智能体系统。一个智能体 \(i \in I\) 在环境 \(S\) 中运作,其在时间步 \(t\) 的行动 \(a_t\) 由策略 \(\pi_i(o_t^i, m_t^i, Q)\) 决定,其中 \(o_t^i\) 是智能体的观察,\(Q\) 是任务规范,\(m_t^i\) 是记忆系统提供的信号。记忆系统被定义为一个可演变的记忆状态 \(M_t \in \mathcal{M}\)。记忆的生命周期由三个概念性操作符描述:

记忆形成 (Memory Formation):\(M_{\text{form}}^{t+1} = F(M_t, \phi_t)\),将智能体产生的有用信息 \(\phi_t\)(如工具输出、推理轨迹等)选择性地转化为记忆候选。

记忆演化 (Memory Evolution):\(M_{t+1} = E(M_{\text{form}}^{t+1})\),将形成的记忆候选整合到现有记忆库中,可能涉及冗余消除、冲突解决或重组。

记忆检索 (Memory Retrieval):\(m_t^i = R(M_t, o_t^i, Q)\),通过一个检索操作符 \(R\) 获取上下文相关的记忆信号,并格式化为LLM策略可直接使用的形式。 文章强调,短时记忆和长时记忆并非独立模块,而是通过记忆操作符不同时间频率的调用模式而产生的现象。

2. 智能体记忆与其他概念的比较 (Comparing Agent Memory with Other Key Concepts)

智能体记忆 vs. LLM记忆 (Agent Memory vs. LLM Memory):论文认为,多数自称为“LLM记忆”的工作(如MemoryBank、MemGPT)实际上是智能体记忆的早期实例。智能体记忆关注维护一个持久且自演化的认知状态,整合事实知识和经验,支持跨任务持久性和环境驱动的适应性。而狭义的LLM记忆则关注模型内部状态的管理,如Transformer的KV cache、长上下文处理机制、模型架构修改等,其目标是扩展或重组基础模型的表示能力,不涉及自主的记忆操作或跨任务持久性。

智能体记忆 vs. RAG (Agent Memory vs. RAG):两者都利用辅助信息存储扩展LLM能力。RAG主要从静态知识源中检索信息以增强LLM的生成,通常用于单次推理任务,且不维护内部演化记忆。智能体记忆则在智能体与环境的持续交互中,不断将智能体自身的行动和环境反馈生成的新信息整合到持久记忆库中。虽然技术栈共享,但核心区别在于,智能体记忆侧重于维护一个“活的”、演进的经验表示,而非仅限于外部静态知识的按需访问。论文进一步结合RAG的既有分类(Modular RAG, Graph RAG, Agentic RAG)来阐述其与智能体记忆的联系和区别。

智能体记忆 vs. 上下文工程 (Agent Memory vs. Context Engineering):上下文工程是一种系统性设计方法,将上下文窗口视为受限计算资源,优化信息载荷以提高推理效率。它侧重于资源分配和接口正确性,强调语法有效性和执行效率。智能体记忆则具有更广泛的认知范围,包括事实知识的持久存储、经验轨迹的积累和演化,以及记忆内化到模型参数中。上下文工程是实现智能体记忆内部物理限制的关键层,但智能体记忆本身支撑了学习、适应和自主性等更高层次的认知功能。

3. 形式:记忆的载体 (Form: What Carries Memory?) 论文将智能体记忆的架构或表示形式分为三大类:

Token-level Memory (Token-level Memory):以显式、离散单元(如文本、视觉tokens)形式存储信息,可被独立访问、修改和重建。其特点是透明、易编辑和解释。根据组织结构又细分为:

Flat Memory (1D):信息以序列或单元包的形式累积,无显式拓扑关系。适用于广泛回忆、情景积累和快速变化的交互历史,但缺乏明确的关系组织,难以支持组合推理和长序列规划。例子包括Reflexion(轨迹和反馈)、MemGPT(虚拟内存)、MemoryBank(历史和用户画像)、Voyager(可执行技能代码库)等。

Planar Memory (2D):在单一结构层内引入显式组织拓扑(如图、树、表格),单位之间通过邻接、父子关系或语义分组编码关系。支持结构化的键值查找和关系遍历。例子包括D-SMART(推理树)、PREMem(交叉会话连接三元组)、A-MEM(卡片式连接记忆)、M3-Agent(图结构中的多模态节点)等。

Hierarchical Memory (3D):信息跨多层组织,通过层间连接形成立体结构,支持不同抽象程度的表示(从原始观察到高层主题)。能够进行复杂的多路径查询,但在构建和维持语义意义方面面临挑战。例子包括HiAgent(子目标中心的分层工作记忆)、GraphRAG(多级社区图索引)、Zep(时间知识图)、G-Memory(查询中心三层图结构)等。

Parametric Memory (Parametric Memory):信息直接存储在模型的参数中,通过参数空间的统计模式隐式编码和访问。

Internal Parametric Memory (Internal Parametric Memory):记忆编码在模型原始参数(如权重、偏置)中,通过微调(fine-tuning)等方式直接调整基础模型。优点是结构简单,无额外推理开销。缺点是更新困难,成本高,易出现灾难性遗忘。适用于大规模领域知识或任务先验的存储。例子包括LMLM(预训练阶段知识检索)、Character-LM(后训练阶段角色特性)。

External Parametric Memory (External Parametric Memory):记忆存储在额外的辅助参数集(如适配器、LoRA模块)中,不修改原始模型权重。优点是平衡了适应性和模型稳定性,支持模块化更新和受控回滚。缺点是其影响间接,效果取决于与模型内部表示流的接口。例子包括MLP-Memory(通过MLP集成RAG知识)、K-Adapter(训练任务特定适配器)。

Latent Memory (Latent Memory):记忆隐式存储在模型的内部隐藏状态、连续表示或演化潜藏结构中,而非显式可读的token或专用参数集。

生成 (Generate):由独立模型或辅助模块生成紧凑的连续状态(如嵌入、特殊token)作为可重用记忆。优点是可主动构建高信息密度的表示,减少重复处理。缺点是可能引入信息损失或偏差,且训练成本高。例子包括Gist(生成gist tokens)、AutoCompressor(编码文档为摘要向量)、MemGen(动态生成LoRA fragments)。

重用 (Reuse):直接重用模型内部的激活(主要是KV cache)作为记忆,不进行转换或压缩。优点是保留了模型内部激活的完整性,概念简单。缺点是KV cache随上下文长度迅速增长,效率受索引策略影响。例子包括Memorizing Transformers(外部KV cache)、FOT(Memory-Attention KV)。

转换 (Transform):修改、压缩或重构现有潜在状态。位于生成和重用之间,通过选择、聚合或结构转换来重塑KV cache和隐藏激活。优点是生成更紧凑和信息密集的记忆表示,降低存储成本。缺点是存在信息丢失风险,且额外的计算开销增加了系统复杂度。例子包括Scissorhands(基于注意力分数的token裁剪)、SnapKV(聚合高重要性前缀KV)、PyramidKV(分层重新分配KV预算)。

4. 形式的适应性 (Adaptation) 论文强调,记忆类型的选择应与智能体在特定任务中的行为预期相匹配,而非简单的组合选择。

Token-level Memory:适用于需要显式推理、可控性和可问责性的场景,如多轮对话系统、个性化智能体、推荐系统和高风险领域(法律、金融)。其优点在于透明、易审计、可转移,能实现长期稳定性并避免灾难性遗忘。

Parametric Memory:适用于需要概念理解和广泛模式归纳的任务,如角色扮演、数学推理、编程、游戏以及需要结构化洞察、鲁棒抽象和根深蒂固行为模式的场景。

Latent Memory:在灵活性和效率之间取得平衡,适用于多模态智能体、设备端/边缘部署和加密/隐私敏感应用。其低可读性提供隐私保护,高表达能力实现紧凑语义编码,并支持高效的推理时检索和集成。

5. 功能:智能体为何需要记忆 (Functions: Why Agents Need Memory?) 智能体从无状态处理器向自主、目标导向实体的转变,凸显了记忆的必要性。记忆是实现持久、智能行为的基础。论文将智能体记忆的功能分为三个核心支柱,跨越长时记忆和短时记忆两个时间维度:

事实记忆 (Factual Memory):智能体的陈述性知识库,确保交互的一致性、连贯性和适应性。它回答了“智能体知道什么?”的问题。

用户事实记忆 (User factual memory):关于特定用户的事实(如身份、偏好、历史承诺),维持人机交互的一致性。通过启发式选择和语义抽象,实现对话连贯性(如Think in Memory、Reflective Memory Management)和目标一致性(如RecurrentGPT、A-Mem),避免偏离意图。

环境事实记忆 (Environment factual memory):关于外部世界的事实(如文档状态、资源可用性),维持与环境的一致性。(此部分在提供的文本中被截断,未能完全展开)

经验记忆 (Experiential Memory):智能体的过程性和策略性知识,通过从过去轨迹、失败和成功中抽象来支持持续学习和自我演化。它回答了“智能体如何改进?”的问题。(此部分在提供的文本中未展开)

工作记忆 (Working Memory):智能体在单个任务或会话期间用于主动管理瞬态上下文的容量有限、动态控制的暂存器。它回答了“智能体现在在思考什么?”的问题。(此部分在提供的文本中未展开)

这些记忆系统并非孤立,而是构成一个动态、相互关联的认知循环:编码(将交互结果整合到长时记忆)、处理(在工作记忆中进行推理)、检索(从持久存储中获取相关上下文和技能)。

6. 贡献与未来方向 (Contributions and Future Directions) 本调查的贡献在于:提出了更新的多维度智能体记忆分类法(Forms-Functions-Dynamics)、深入讨论了不同记忆形式和功能目的的适用性与相互作用、探讨了新兴和有前景的研究方向,并汇总了基准和开源框架资源。 论文指出的新兴研究前沿包括:自动化导向的记忆设计、强化学习与记忆系统的深度整合、多模态记忆、多智能体系统的共享记忆以及可信赖性问题。

Abstract¶

核心观点:

如果你在做 Agent,却没有把“记忆”当成一等系统能力来设计,那你做的只是带工具的聊天模型。

不是所有记忆都该被长期保存,也不是所有记忆都值得反复召回。

定义:

Agent Memory:一种可以被写入、被更新、被选择性使用,并且会影响未来行为的内部能力结构。重点不在“存没存”,而在“会不会改变 Agent 接下来怎么做”

现在的 Agent 已经变了:

long-horizon reasoning:跨时间尺度的推理(不是一次对话,而是多天、多任务、多阶段)

continual adaptation:持续适应,它要在过程中不断调整策略(Agent 能不能“学着用”)

interaction with complex environments:复杂环境交互(工具、世界状态、他人、任务流)

对比

模型记住了什么(参数、权重)

我从外部检索了什么(RAG)

我在 prompt 里拼了什么(context engineering)

主流三类分类:

显式可读的记忆:文本、token、结构化记录 → 好查、好解释,但上下文有限、成本高

写进模型里的记忆:参数变化、微调结果 → 稳定、隐式,但不可控、不可回滚

介于两者之间的状态记忆:latent state、belief、隐变量 → 不直接可读,但持续影响决策

功能分工:

有些记忆是为了知道世界是什么样的

有些记忆是为了记住我经历过什么

有些记忆是为了支撑当前正在进行的任务

动态视角:记忆“如何随时间变化”

有的记忆是即时生成的

有的记忆需要反思、压缩、重写

有的记忆会被强化

有的记忆应该被遗忘

记忆的变化本身会反过来塑造 Agent 的行为轨迹,形成闭环

这一步已经把 Agent Memory 拉进了“学习系统”的范畴,而不只是存储系统

记忆洞察 → 记忆生成 → 记忆选择 → 记忆演化

1. Introduction¶

Agent=LLM + 一组外部与内部能力

能力包括:

推理(reasoning)

规划(planning)

感知(perception)

记忆(memory)

工具使用(tool-use)

这些能力有的通过强化学习内化到模型参数中(如推理),有的则依赖外部智能体框架(如记忆)。

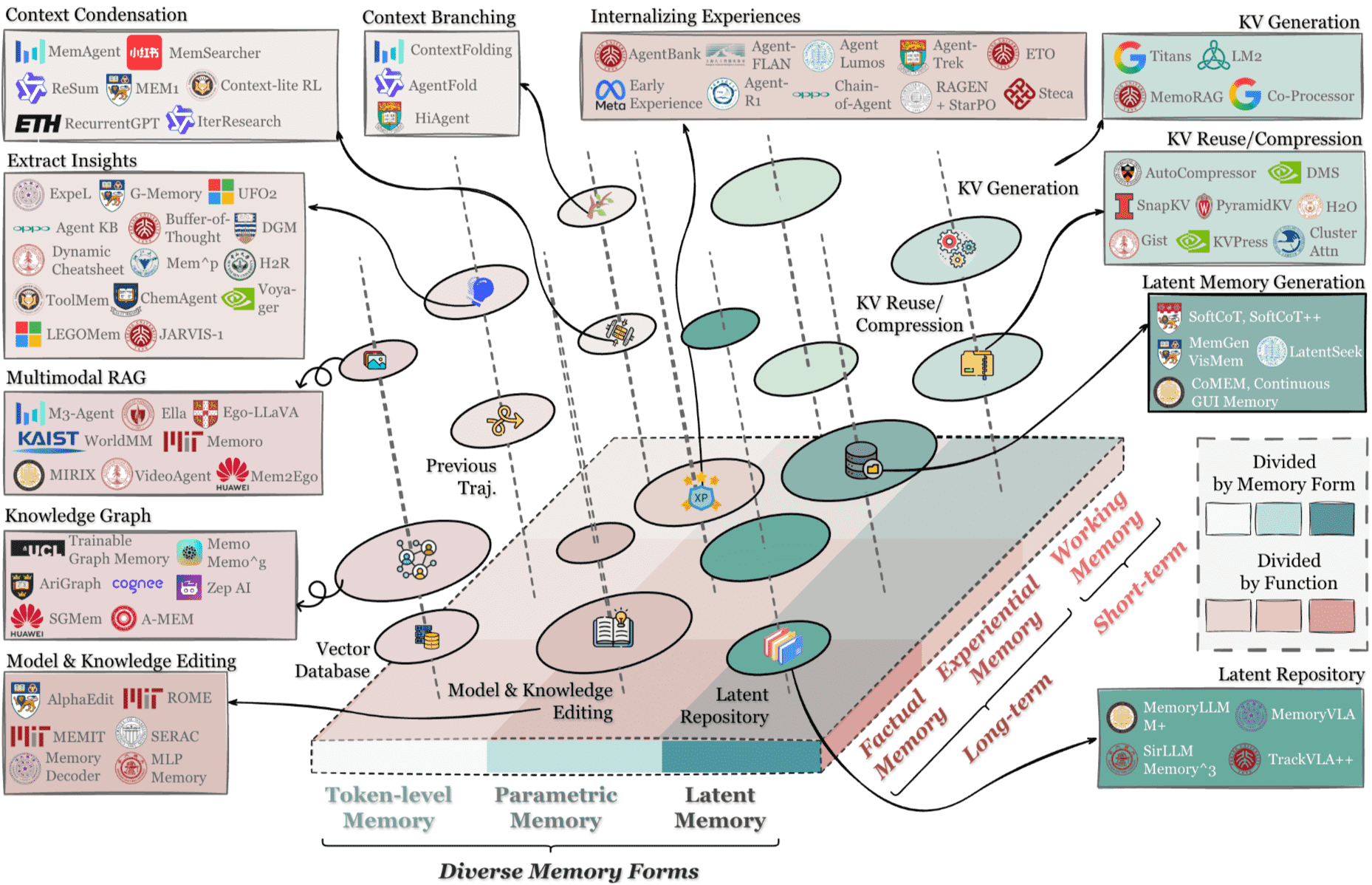

Figure 1 Overview of agent memory organized by the unified taxonomy of forms (Section 3), functions (Section 4), and dynamics (Section 5). The diagram positions memory artifacts by their dominant form and primary function. It further maps representative systems into this taxonomy to provide a consolidated landscape.

备注

AGI 的一个核心目标是:Agent 能通过与环境互动而持续演化。而这种演化能力,本质上建立在 memory 之上。

记忆的不同分类

episodic / semantic(认知科学范式)

parametric / declarative(工程范式)

RAG + cache + logs(系统范式)

2. Preliminaries: Formalizing Agents and Memory¶

2.1 LLM-based Agent Systems¶

核心做的事

把各种看起来很不一样的 LLM Agent 系统,统一成一个标准的决策过程框架。

无论你是 ReAct、Planner–Executor、Debate、Multi-Agent Coding,本质都能塞进同一个“环境—观察—策略—行动—轨迹”的盒子里。

Agents and Environment¶

先把 Agent 系统抽象成一个受控随机过程,这是强化学习(RL)和多智能体系统的经典起手式

核心三件事

LLM Agent 不等于环境 环境可以是代码仓库、网页、仿真器、共享白板、文件系统

动作会影响环境,但不一定是确定性的 比如搜索结果、API 返回、他人 agent 的后续行为

多 agent 不一定要显式通信 可以“通过环境间接耦合”,这点非常像黑板系统(blackboard architecture)

形式化定义

用索引集 \( I = \{1, ..., N\} \) 表示智能体。

\( N=1 \) 是单智能体(如ReAct),\( N>1 \) 是多智能体(如辩论debate、规划-执行架构planner–executor)。

环境

用状态空间 \( S \) 描述。

环境根据受控的随机转移模型随时间演进 \( s_{t+1} \sim \Psi(s_{t+1} | s_t, a_t) \)

观察

每个 Agent i 在 t 时刻看到的是:

[ o_t^i = O^i(s_t, h_t^i, Q) ]

( s_t ):环境真实状态(Agent 未必全知)

( h_t^i ):Agent 可见的历史

聊天记录

工具输出

中间推理

共享白板

其他 Agent 的消息

( Q ):任务定义(用户指令 / 目标)

👉 这一步已经把 “上下文工程 + 多 Agent 可见性” 抽象进 observation 里了。

备注

关键点:不关心环境是不是物理的、网页的、代码仓库的、聊天系统的。只要“Agent 的行为会改变某种状态”,就够了。

Action Space(动作空间)¶

统一视觉:These actions, though diverse in semantics, are unified by the fact that they are produced through an autoregressive LLM backbone.不管动作看起来多复杂,系统都把它们当成:“LLM 在给定上下文下生成的一段结构化输出”。

核心观点:LLM智能体的行动空间是异构的,不局限于生成纯文本。

行动类型:

自然语言生成:如生成推理、解释、响应或指令。

工具调用:调用外部API、搜索引擎、计算器等。

规划行动:输出任务分解、执行计划或子目标。

环境控制:直接操控外部环境(如导航、编辑代码库)。

通信行动:与其他智能体进行结构化消息交互。

策略:所有行动都由一个基于上下文输入的自回归LLM骨干网络产生。智能体 \( i \) 的策略为 \( a_t = \pi^i(o_t^i, m_t^i, Q) \),其中 \( m_t^i \) 是来自记忆的信号。

Interaction Process and Trajectories(交互过程与轨迹)¶

轨迹:系统的完整执行产生一个轨迹 \( \tau = (s_0, o_0, a_0, s_1, o_1, a_1, ..., s_T) \)。

步骤循环:每一步都交织着(i)环境观察、(ii)可选记忆检索、(iii)基于LLM的计算、(iv)驱动状态转移的行动执行。

2.2 Agent Memory Systems¶

核心思想是:智能体的记忆是一个统一的、动态演化的系统,其“短期”和“长期”功能不是通过固定的硬件模块实现,而是通过一套“生命周期”操作在不同时间尺度上的调用模式而“涌现”出来的。

关键步骤:

形成:形成记忆备选

演化:可以从简单的原始观察累积,到复杂的、可重用模式或抽象的精炼提取

检索:可以仅在任务初始化时执行一次,也可以间歇性或持续性地基于上下文触发

一个完整的智能体循环包括:观察环境 →(可选)检索记忆 → 计算行动 → 接收反馈 →(可选)通过形成和演化更新记忆

1. 记忆系统的必要性¶

智能体的瞬时观察 \( o_t^i \) 通常不足以进行有效决策,需要依赖当前任务和过往任务中积累的额外信息。

2. 统一记忆状态¶

形式化定义:用一个演化的记忆状态 \( M_t \in \mathcal{M} \) 来表示统一的智能体记忆系统。\( M_t \) 可以采用文本缓冲区、键值存储、向量数据库、图结构等多种形式,不强制规定其内部结构。

统一容器:任务开始时,\( M_t \) 可能已包含从先前轨迹中提炼的信息(跨任务/长期记忆)。任务执行期间,新信息不断积累,充当任务内/短期记忆。这两种角色由同一个记忆容器支持,其时间上的区别源于使用模式,而非架构上的分离。

3. 记忆生命周期:形成、演化和检索¶

记忆系统的动态特性由三个概念性算子描述:

形成:智能体在时间 \( t \) 产生信息产物 \( \phi_t \)(如工具输出、推理痕迹)。形成算子 \( M_{t+1}^{form} = \mathcal{F}(M_t, \phi_t) \) 有选择性地将这些产物转化为记忆候选,提取具有潜在未来价值的信息,而非存储整个交互历史。

演化:演化算子 \( M_{t+1} = \mathcal{E}(M_{t+1}^{form}) \) 将形成的记忆候选整合到现有记忆库中。这可能涉及合并冗余条目、解决冲突、丢弃低价值信息或重组记忆以利于高效检索。演化后的记忆状态会在后续决策步骤和任务中持久存在。

检索:当选择行动时,智能体 \( i \) 检索一个与上下文相关的记忆信号 \( m_t^i = \mathcal{R}(M_t, o_t^i, Q) \)。检索算子 \( \mathcal{R} \) 构建一个任务感知查询,并返回相关的记忆内容,格式化后供LLM策略直接使用。

4. 智能体循环中的时间角色¶

核心观点:记忆的三种生命周期算子(\( \mathcal{F}, \mathcal{E}, \mathcal{R} \))不需要在每个时间步都被调用。

不同的调用模式产生不同的记忆效果:

检索:可以仅在任务初始化时执行一次,也可以间歇性或持续性地基于上下文触发。

形成:可以从简单的原始观察累积,到复杂的、可重用模式或抽象的精炼提取。

结论:因此,短期和长期记忆现象并非源于离散的架构模块,而是源于形成、演化和检索这三种操作被调用的时间模式。

5. 记忆-智能体耦合¶

智能体策略一般形式为 \( a_t = \pi^i(o_t^i, m_t^i, Q) \),检索到的记忆信号 \( m_t^i \) 可能存在也可能不存在(取决于检索计划)。

整体智能体循环:观察环境 → (可选)检索记忆 → 计算行动 → 接收反馈 → (可选)通过形成和演化更新记忆。

灵活性:不同的智能体实现会在不同的时间频率实例化这些操作的不同子集,从而产生从被动缓冲区到主动演化知识库的各种记忆系统。

2.3 Comparing Agent Memory with Other Key Concepts¶

本节目的:澄清“智能体记忆”与易混淆的相关概念(LLM记忆、RAG、上下文工程)之间的区别与联系,避免概念碎片化。

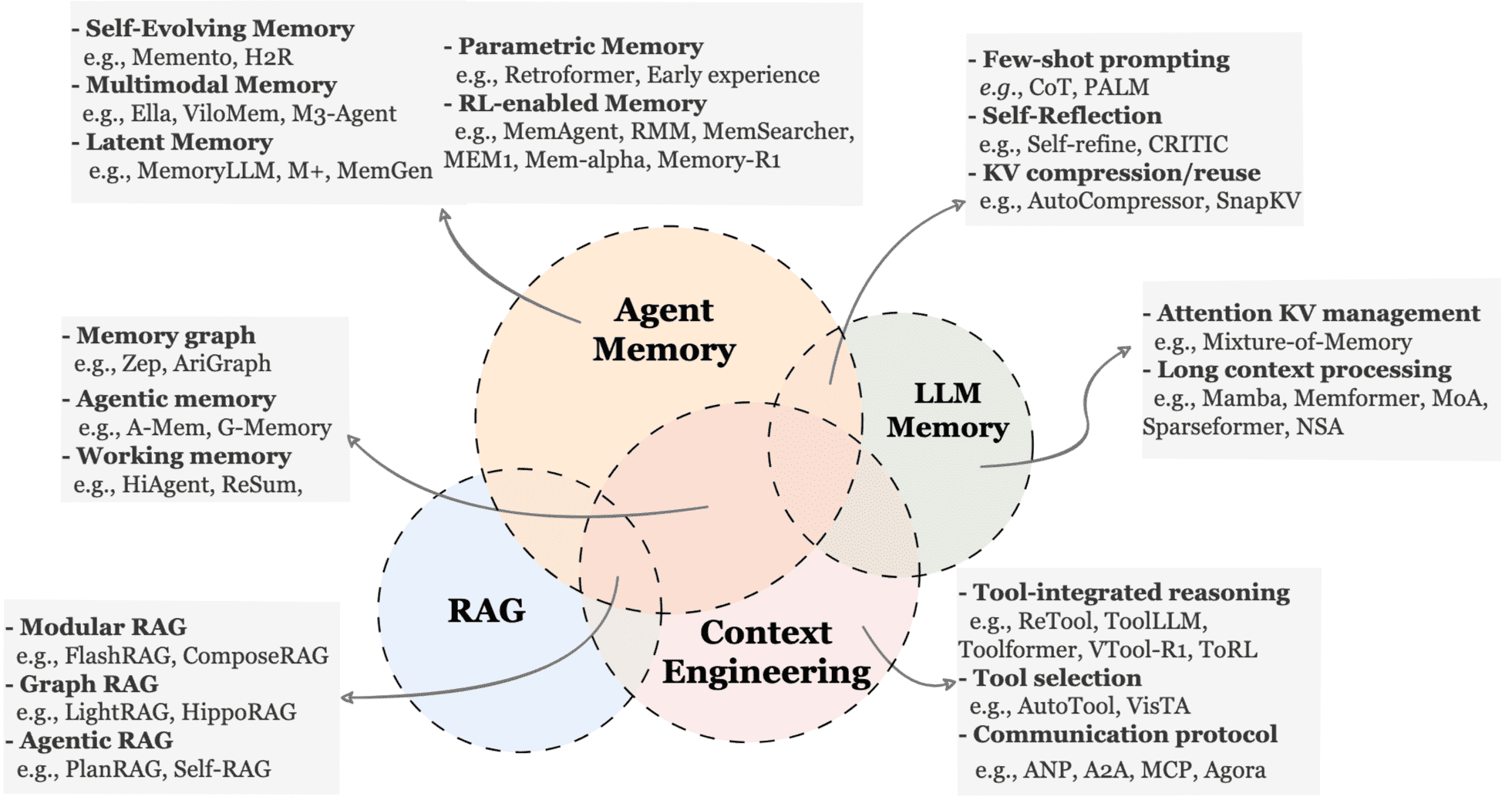

Figure 2 Conceptual comparison of Agent Memory with LLM Memory, RAG, and Context Engineering.

2.3.1 智能体记忆 vs. LLM记忆¶

智能体记忆 > LLM记忆:历史上许多称为“LLM记忆”的机制(如MemoryBank, MemGPT)本质上是解决智能体挑战(如追踪用户偏好、维护对话状态),在现代视角下应归类为智能体记忆。

真正的LLM(内部)记忆:指管理Transformer的KV缓存、设计长上下文处理机制、修改模型架构(如RWKV, Mamba)等,旨在从模型内部增强信息保留能力,不涉及智能体行为。

重叠与区分:

重叠:少样本提示(作为长期记忆)、自我反思(作为短期记忆)、KV压缩(在任务内保留关键信息)等,在智能体语境下可被视为智能体记忆机制。

区分:直接干预模型内部状态(如架构修改、缓存重写、注意力稀疏化)属于LLM记忆,其目标是扩展模型自身的表示能力,而非为决策智能体提供演化的外部记忆库。

2.3.2 智能体记忆 vs. RAG¶

概念重叠:两者都构建、组织和利用辅助信息存储来扩展LLM/智能体的能力,技术栈有共同点(如向量索引、语义搜索)。

历史性区分:

经典RAG:主要用静态知识源(文档库、知识库)增强LLM,用于单次推理任务,目的是信息检索的准确性。

智能体记忆:在智能体与环境的持续交互中实例化,不断将自身行动和环境反馈产生的新信息整合到一个持久、演化的记忆库中,目的是支持持续性、适应性。

边界模糊:随着RAG系统本身变得动态(如多跳QA、HippoRAG),以及智能体记忆系统也在某些文档QA任务上评估,两者的界限已不清晰。

基于RAG分类的进一步辨析:

模块化RAG:对应智能体记忆中的检索阶段技术(如向量搜索)。

图RAG:对应智能体记忆中的图结构记忆。关键区别:RAG的图通常是静态知识库,而智能体记忆的图是动态演化的经验表示。

智能体化RAG:与智能体记忆的概念空间最接近。核心区别:智能体化RAG通常操作于外部、任务特定的数据库,而智能体记忆维护内部、持久、自演化的跨任务记忆库。

2.3.3 智能体记忆 vs. 上下文工程¶

本质区别:

上下文工程:是一种资源管理范式。它将上下文窗口视为受限的计算资源,系统性地优化其中的信息载荷(指令、知识、状态、记忆),以最大化推理效能。它关注的是信息的结构性组织、接口正确性和执行效率。

智能体记忆:是一种认知建模范式。它关注的是为一个持续存在的实体维护一个具有演化身份的持久认知状态。它定义智能体知道什么、经历过什么、以及这些如何随时间演化。

重叠:在技术实现上高度重合,尤其是在处理长序列交互的“工作记忆”时。两者都使用信息压缩、组织、选择、滚动摘要等技术来在有限上下文内维持操作连续性。此时,优化上下文和维护短期记忆的边界是模糊的。

区分:当视角超越短期的文本处理,扩展到长生命周期的智能体时,区别最为明显。上下文工程构建的是使智能体能够在资源约束下感知和行动的外部脚手架;而智能体记忆构成的是支持学习、适应和自主性的内部认知基底。前者优化瞬时接口,后者维持持久认知状态。

3. Form: What Carries Memory?¶

核心问题:记忆以何种物理或逻辑形式存在?

核心观点:不存在一种万能记忆结构。不同任务 → 需要不同“记忆形态”。不同的存储形式决定了记忆的不同能力(如如何积累信息、保持行为一致性)。

分类依据:根据记忆存储的位置和表示的形式进行分类。

三大记忆形式

令牌级记忆:记忆被组织为显式、离散的单元(如文本块、对话记录、代码片段)。这些单元可以被单独访问、修改和重建,通常存储在模型参数之外(如数据库、文本文件)。

参数记忆:记忆存储在模型的参数内部。信息通过参数空间的统计模式被编码,在模型进行前向计算时被隐式地访问和调用。这是模型通过预训练和微调学到的“世界知识”。

潜在记忆:记忆体现在模型的内部隐藏状态、连续表示或演化的潜在结构中。它在推理过程中或跨交互周期中持续存在和更新,用于捕捉与上下文相关的内部状态(类似于人类的“工作记忆”或当前思考的上下文)。

理解

令牌级:看得见、摸得着,像外接的硬盘或笔记本,易于管理和解释。

参数级:内化于模型的“本能”或“技能”,是模型的一部分,不可直接查看,但决定了模型的基调和能力。

潜在级:模型在运行时的“大脑活跃状态”,是实时、连续且与当前任务高度相关的思维流。

3.1 Token-level Memory¶

定义

将信息存储为持久、离散的单元,这些单元可以从外部访问和检查。“令牌”是一个广义概念,可以是文本、图像块、音频帧等任何可以脱离模型参数进行读写的离散元素。

特点:透明、易编辑、易解释,是检索、路由、冲突处理以及与参数/潜在记忆协调的天然层。这是最常见、研究最多的记忆形式。

关键词

persistent(可长期保存)

discrete(离散)

externally accessible(外部可访问)

inspectable(可解释、可审计)

组织结构分类(关键创新点)

虽然都是离散单元,但单元间的组织结构差异巨大,这决定了记忆的搜索、更新和推理效率。

论文按拓扑复杂性将其分为三类:

扁平记忆Flat Memory (1D):

单元间没有显式的拓扑结构。

记忆以序列或集合的形式积累(如聊天记录流、经验片段包)。

平面结构化记忆Planar Memory (2D):

在单一平面内有结构化组织。

单元通过图、树、表等关系连接,但没有跨层关系。

分层记忆Hierarchical Memory (3D):

跨越多个层次进行组织,具有层间链接,形成立体或分层的记忆结构。

备注

核心理解:这是一个从“无序集合”到“单层结构”再到“多层立体结构”的演进,代表着记忆组织复杂度和能力的提升。拓扑结构越复杂,越能支持复杂的推理和抽象,但构建和维护成本也越高。

Figure 3 Taxonomy of token-level memory organized by topological complexity and dimensionality

3.1.1 Flat Memory (1D)¶

定义¶

扁平记忆将信息存储为离散单元的累加,不显式建模单元间的语义或关系依赖。这些单元可以是文本块、用户画像、经验轨迹等。单元间的关系没有直接编码在记忆中。

任何离散、可读、可写、可重排的记忆单元——包括:

文本 token / chunk

图像 token(patch、object)

音频帧

结构化条目(QA、卡片、轨迹)

备注

核心理解:好比一个简单的日志文件或一个没有标签的笔记集合,信息一条条堆叠,但彼此之间没有明确的链接。

五大典型应用场景¶

论文将扁平记忆的研究按设计目标和技术侧重点进行了梳理:

对话:存储和管理对话内容。研究历程:

早期:为防止遗忘,直接存储原始对话历史或生成递归摘要。

发展:引入类似操作系统的分级管理思想(如MemGPT),解耦活动上下文和外部存储。

深化:优化检索粒度(如压缩成语义表示、查询-响应对),并引入认知心理学概念(如基于贝叶斯惊讶的事件分割)。

进阶:存储高级认知过程(如归纳思考、反思)和复杂叙事结构(如分解为事实、情节、角色层面)。

自动化:记忆从静态存储演变为可自适应优化,引入强化学习、动态校准、冗余管理等机制。

偏好:专注于建模用户不断演化的品味、兴趣和决策模式(尤其在推荐场景)。与对话记忆不同,其核心是识别用户偏好。方法包括分离用户画像与物品信息、构建交互索引、设计结构化记忆(追踪实体和态度)等。

画像:专注于存储和维护稳定的用户画像、角色属性或长期身份信息,以保证智能体跨对话和任务的行为一致性。方法包括按时间戳组织、结合多维度交互信息、形成实时更新的画像池、以及从剧本中提取角色知识等。

经验:源自智能体在实际交互任务中的动态积累,包括观察、思维链、行动轨迹和环境反馈。

基础:直接存档历史行为轨迹(成功或失败的案例)。

抽象:将具体交互提炼为更高层次的通用经验(如工作流、规则模板、“思想模板”),以促进跨问题迁移。

结构化:构建特定领域的结构化知识库、采用分层计划-执行架构、融入类人遗忘和反思机制。

技能化:在编程或工具使用场景,将经验固化为可执行的代码库、脚本或工具使用条目,实现自我进化。

多模态:存储从原始多模态数据(图像、视频帧、音频、文本)中提取的离散词符级单元。研究场景包括:

可穿戴/第一人称视角:将视频/语音转为轻量级语言描述或嵌入块,并融入情感、遗忘策略。

视频理解:分离瞬时视觉线索与持久上下文信息,采用短期/长期记忆、双记忆库(原始特征+查询嵌入)、语义组织(时间线记忆+物体级记忆)。

具身智能:记忆与空间结构和持续交互紧密绑定。常用多级系统(长期静态3D场景图+短期动态物体状态)、分离全局地图、地标描述、访问历史等。

讨论¶

优势:简单、可扩展性强。可以低成本地追加或修剪记忆,通过相似性搜索等检索方法可以灵活访问,无需预定义结构。适合广泛召回、情景积累和快速变化的交互历史。

劣势:缺乏显式的关系组织,记忆的连贯性和相关性严重依赖检索质量。随着记忆增长,冗余和噪声会累积,模型可能检索到相关单元但不理解它们之间的关系,限制了组合推理、长期规划和抽象形成的能力。

3.1.2 Planar Memory (2D)¶

定义¶

平面记忆在记忆单元之间引入了显式的组织拓扑,但仅限于单个结构层。拓扑可以是图、树、表等,其中邻接、父子顺序或语义分组等关系被编码在一个平面上,没有层级或跨层引用。

核心理解:好比在一张白纸上绘制知识图谱或树状图,所有节点和链接都处于同一层级。核心是从“存储”到“组织”的飞跃。

主要结构类型¶

树状结构:以分层方式组织信息,处理不同抽象级别。

例子:HAT通过分段和聚合构建层次聚合树;MemTree从对话日志推断层次模式,将具体事件总结为更高层概念。

图结构:由于能捕捉复杂关联、因果关系和时间动态,在2D记忆中占主导。

例子:Ret-LLM将存储抽象为可寻址的三元组单元;KGT将用户偏好编码为用户特定知识图谱中的节点和边;A-Mem将知识标准化为卡片单元,按相关性组织在“盒子”里形成网络。

混合结构:为复杂任务设计,分离不同认知功能但共享记忆基底。

例子:Optimus-1将静态知识(用于规划)与动态交互(用于反思)分离;D-SMART结合了结构化的事实记忆(知识图谱)和基于遍历的推理树。

讨论¶

优势:通过有效建立节点间的链接,使记忆能够利用集体协同效应,编码更全面的上下文知识。它支持超越简单迭代的检索机制,如结构化键值查找和沿图边的关系遍历。擅长存储、组织和管理记忆。

劣势:所有记忆必须整合到一个单一的模块中。随着任务场景变得复杂多样,这种冗余和平铺的设计变得不足。更重要的是,高构建和搜索成本严重阻碍了其实际部署。

3.1.3 分层记忆(3D)¶

定义¶

分层记忆跨越多层组织信息,利用层间连接将记忆塑造成一个立体结构化空间。这种层次结构支持不同抽象程度的表示——从原始观察到紧凑的事件摘要,再到更高级的主题模式。层间连接进一步产生了一个立体记忆空间,系统不仅可以横向导航,还可以垂直跨越抽象层级。

核心理解:这不仅是分层,更是构建一个立体的、多维度的记忆网络。信息在不同粒度层级上都有组织,并且层级间可以互通。

主要实现形式¶

金字塔型:构建多级金字塔,信息被逐步组织到更高抽象层,并以从粗到细的方式进行查询。

例子:HiAgent管理子目标中心的层次工作记忆;GraphRAG通过社区检测构建多层图索引;EMG-RAG组织可编辑记忆图为三层。

多层型:强调分层专业化,将记忆组织成专注于特定信息类型或功能的不同模块或层级。

例子:Lyfe Agents将重要的长期记录与低价值的瞬时细节分离;HippoRAG将记忆分解为关联索引组件(知识图谱)和底层段落存储;AriGraph在统一图中按信息类型分离记忆。

讨论¶

优势:通过将记忆节点置于层次和关系维度的交叉点,使不同记忆能够互动并形成多维协同效应,编码的知识更全面、更深层地语境化。它支持强大的检索:可以进行复杂的、多路径查询,在每层内部的关系网络中移动,并在层间跨越抽象级别移动,从而以高精度检索任务相关记忆。

劣势:结构的复杂性和密集的信息组织给检索效率和整体有效性带来了挑战。特别是,确保所有存储的记忆保持语义意义,并设计最优的三维布局,仍然是困难且关键的问题。

总结¶

本节系统阐述了词符级记忆的定义、分类(1D/2D/3D)以及每种类型下的具体技术流派和代表工作。它清晰地描绘了一个从简单到复杂、从存储到组织再到立体抽象的技术演进图谱:

1D 扁平记忆:是基础,强调可扩展和灵活检索,但缺乏关系理解。

2D 平面记忆:引入了关系组织,支持复杂查询,但受限于单层结构和构建成本。

3D 分层记忆:实现了多层抽象和立体关联,能力最强,但设计和维护也最为复杂。

这种分类为理解和设计智能体记忆系统提供了一个清晰的理论框架。

3.2 Parametric Memory¶

核心定义:将信息直接存储在模型的参数中,使其能够内化知识,无需依赖外部存储即可回忆。

token-level memory: 信息是显式的、可见的、可编辑的离散单元(例如提示词、RAG 文档、上下文窗口里的内容)

parametric memory: 信息被隐式地编码进模型参数空间,模型“记住”它,但你看不到具体内容

备注

parametric memory = 模型通过参数变化“内化”知识,而不是去读外部记忆。

根据记忆存储位置与核心模型参数的相对关系,将参数化记忆分为两大主要类型:

Internal Parametric Memory内部参数化记忆:记忆编码在模型的原始参数(如权重、偏置)中。这种方法直接调整基础模型以融入新知识或行为。

External Parametric Memory外部参数化记忆:记忆存储在额外的辅助参数集中,例如适配器、LoRA模块或轻量级代理模型。这种方法引入新参数来承载记忆,而不修改原始模型权重。

核心设计选择:这种区分反映了一个关键的设计权衡——是将记忆完全吸收到基础模型中,还是以模块化的形式附加在模型旁边。

3.2.1 内部参数化记忆¶

核心概念与目标¶

目标:将领域知识、个性化知识或下游任务所需的先验知识注入模型。增强模型的长上下文能力也被视为一种先验注入。

关键特征:存储在内部参数中的记忆不增加额外参数或附加模块,因此推理时没有额外开销。

注入时机与相关研究¶

记忆注入可以在不同训练阶段进行:

预训练阶段:

目的:解决长尾世界知识难以压缩到有限模型参数中的问题。

代表工作:

LMLM, HierMemLM:在预训练阶段让模型学习“如何检索记忆”,而知识本身存储在外部的知识库中。

其他工作通过优化注意力计算效率来增强长窗口记忆能力。

中训练阶段(继续预训练):

目的:融入来自下游任务的、可泛化的“经验”。

代表工作:一些研究让模型集成智能体经验,或在此阶段提升大模型的长窗口性能/效率。

后训练阶段(如微调):

目的:使模型适应特定下游任务,如记忆用户个性化历史、学习过去任务执行的成功与失败经验。

代表工作:

Character-LM / CharacterGLM:将大模型微调成具有不同“角色”特征。

SELF-PARAM:通过KL散度蒸馏注入额外知识,无需额外参数。

KnowledgeEditor, MEND:专注于知识编辑,旨在精准修改特定知识,而不影响其他功能。

DINM:使模型学会拒绝危险请求,同时不影响正常功能。

讨论:优缺点¶

优点:结构简单,不增加推理开销或部署成本。

缺点:难以更新。存储新记忆需要重新训练,成本高昂且容易导致灾难性遗忘。

适用场景:更适用于大规模存储领域知识或任务先验,而不是用于存储短期的个性化记忆或工作记忆。

3.2.2 外部参数化记忆¶

产生背景¶

纯粹的Token存储或内部参数存储各有弊端。因此,一些工作采取折中方案:通过引入外部参数来承载记忆,而不改变大模型的原始参数。

主要实现方法¶

基于适配器的方法:

核心思想:将记忆存储在附加到冻结的基础模型上的小型可训练模块中。

代表工作演进:

K-Adapter:通过训练任务特定的适配器来注入新知识,保持主干网络不变,实现持续的知识扩展。

WISE:引入双参数记忆(分离预训练知识和编辑后知识)和路由机制,在推理时动态选择使用哪部分记忆,缓解知识编辑冲突。

ELDER:维护多个LoRA模块,并学习一个根据输入语义自适应选择或混合它们的路由函数,提升了长期编辑的鲁棒性和可扩展性。

共同优势:以模块化、可逆的方式存储和检索记忆,避免了直接修改核心模型权重带来的灾难性干扰风险。

基于辅助语言模型的方法:

核心思想:采用架构上更解耦的形式,将记忆存储在独立的模型或外部知识模块中。

代表工作:

MAC:将新文档信息通过一个“摊销网络”压缩成紧凑的调制向量,存储在记忆库中。

Retroformer:提出一种学习范式,用于记住过去任务执行中的成功或失败经验。

讨论:优缺点¶

优点:在适应性和模型稳定性之间取得平衡。记忆模块可以独立地添加、移除或替换,支持模块化更新、任务特定个性化及可控回滚,有效避免了灾难性遗忘和全局权重扭曲。

缺点:外部参数模块仍需与模型内部表示流集成,其影响是间接的(通过模型的注意力和计算路径中介)。因此,记忆注入的有效性取决于外部参数与内部参数化知识的接口能力。

一级分类:基于存储位置,分为 内部参数化记忆 和 外部参数化记忆。

二级分类:基于文章涉及的训练阶段(预训练、中训练、后训练)。

比较维度:

类型:记忆的性质(如“事实性”、“经验性”、“工作记忆”)。

任务:目标下游应用(如问答、角色扮演、模型编辑)。

优化:采用的优化策略(如监督微调、知识蒸馏、强化学习、提示工程)。

3.3 Latent Memory¶

潜在记忆的定义

潜在记忆是指隐含地存储在模型内部表示中的记忆(例如,KV缓存、激活值、隐藏状态、潜在嵌入),而不是存储为显式的、人类可读的文本或专用的参数集。

优势:

隐蔽性:避免了以明文形式暴露记忆内容。

高效性:实际引入的推理延迟更低。

性能潜力:在模型自身的表示空间中保留了细粒度的上下文信号,可能带来更好的性能提升。

潜在记忆的三种主要类型

根据潜在记忆的“起源”(即潜在状态如何形成并被引入智能体)将其分为三类:

生成:由独立的模型或模块产生,然后作为可复用的内部表示提供给智能体。

重用:直接从先前的计算中继承而来,最典型的是KV缓存的复用(在单轮或多轮对话中),以及传播隐藏状态的循环或有状态控制器。

变换:将现有的潜在状态转换为新的表示(例如,通过蒸馏、池化或压缩),使智能体在降低延迟和减少上下文占用空间的同时保留关键信息。

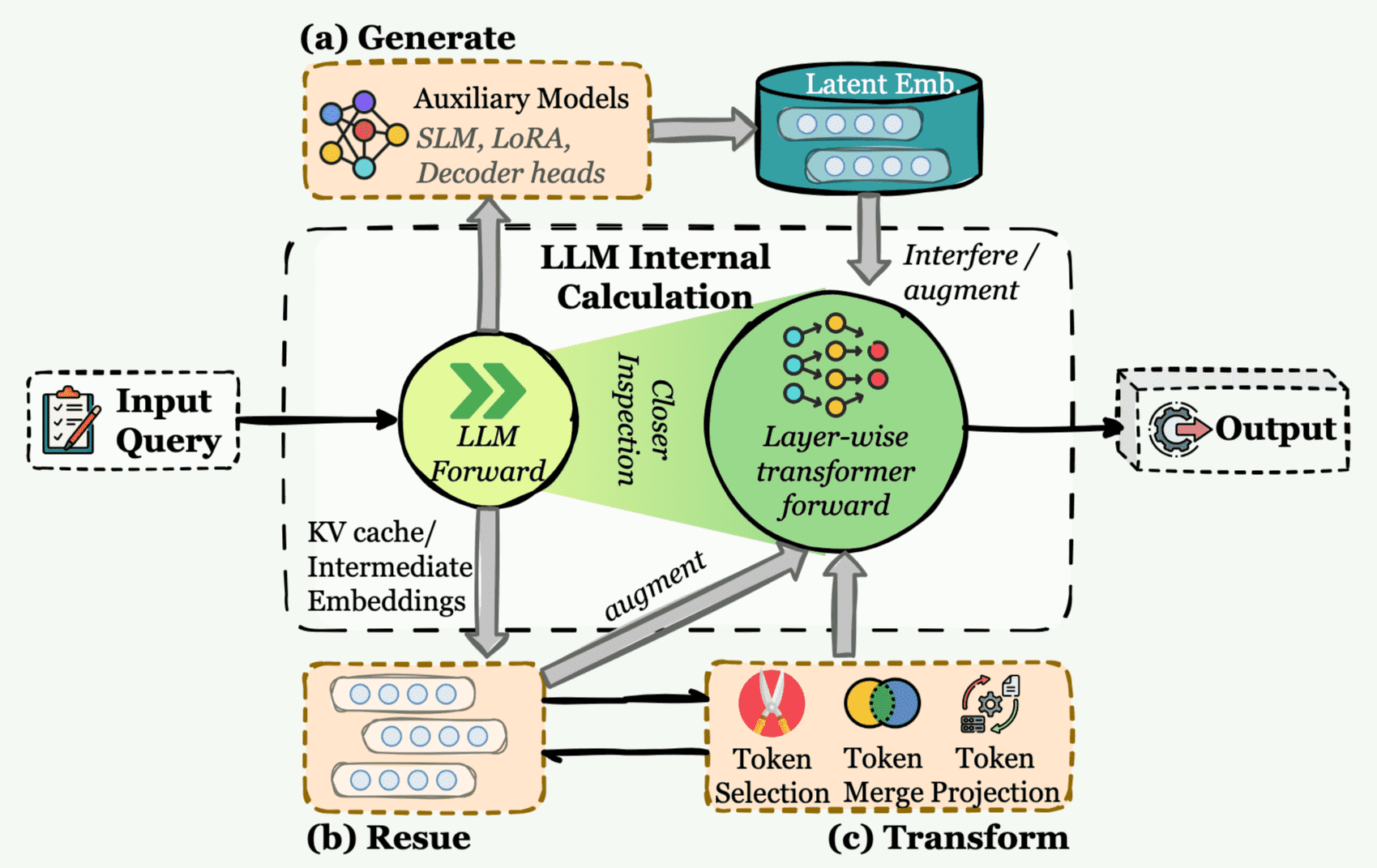

Figure 4 Overview of Latent Memory integration in LLM agents.

该图展示了潜在记忆与LLM推理流程整合的三种方式:

(a) 生成:由辅助模型(如小语言模型、LoRA适配器、解码器头)产生“潜在嵌入”,来干扰或增强LLM的内部计算。

(b) 重用:直接复用先前的计算状态(如KV缓存或中间嵌入),方法是选择相关标记、合并标记或进行投影。

(c) 变换:对KV缓存或中间嵌入进行变换,通过选择、合并或投影来压缩内部状态,以保持上下文处理的高效性。

3.3.1 Generate¶

这类方法的核心是通过编码或压缩,主动生成新的、紧凑的连续潜在状态来构建记忆,而不是重用或变换现有的激活值。

工作原理:模型或辅助编码器(如另一个小模型)会生成一种“潜在摘要”。这种摘要可能以序列中的特殊标记形式出现,或是独立的向量。它总结了来自长上下文、任务轨迹或多模态输入的关键信息。

存储与使用:生成的潜在摘要被存储、插入或作为后续推理决策的条件。这使得系统能够突破原始上下文长度限制、维持任务特定的中间状态,并在多个“回合”中保留知识而无需重新处理原始输入。

与参数记忆的区分:虽然生成过程可能依赖训练好的模块(易与参数记忆混淆),但关键区别在于,这里生成的潜在表示是显式实例化并作为独立记忆单元被重用的,而不是直接嵌入到模型参数或前向传播的激活值中。

具体研究案例:

单模态(文本):

长上下文压缩:例如 Gist、AutoCompressor 等方法,将长文档压缩成少数几个“摘要向量”或“软提示”,在后续推理中复用。

持久记忆架构:例如 MemoryLLM、M+ 在模型的潜在空间中嵌入专用的记忆标记;LM2 在每一层引入矩阵形态的记忆槽。

参数化生成:例如 Titans 将长程信息压缩进一个在线更新的MLP权重中;MemGen 在解码时动态生成潜在记忆。

多模态:

将图像、音频、视频或交互轨迹编码为紧凑的潜在嵌入,作为即插即用的记忆。例如 CoMem、Time-VLM、MemoryVLA。

讨论:

优点:可以主动构建信息密度高、任务定制化的表示,以最小存储成本捕捉关键动态或跨模态关系;避免了重复处理完整上下文,跨长程交互推理更高效。

缺点:生成过程可能引入信息损失或偏差;记忆状态在多次读写循环中可能漂移或累积错误;训练专用生成模块会增加计算开销、数据需求和工程复杂度。

3.3.2 Reuse¶

这类方法与“生成型”相反,它直接重用模型内部的计算激活值(主要是KV缓存)作为潜在记忆,不对存储的KV对进行变换(修改、压缩)。

工作原理:将前向传播产生的原始激活值(KV对)视为可复用的记忆条目。核心挑战在于决定保留哪些KV对、如何建立索引,以及在长上下文或连续处理需求下如何高效检索。

认知类比:类似于生物记忆的“键-值”系统,其中“键”作为检索地址,“值”编码存储内容。

具体研究案例:

Memorizing Transformers:显式存储过去的KV对,在推理时通过K近邻搜索检索。

FOT:引入记忆注意力层,在推理时对额外的KV记忆进行基于KNN的检索。

LONGMEM:使用轻量级残差侧网络,将历史的KV嵌入视为持久记忆存储。

讨论:

优点:保留了模型内部激活值的完整保真度,没有因剪枝或压缩造成信息损失;概念简单,易于集成到现有框架中,高度忠实于模型的原始计算。

缺点:原始KV缓存随上下文长度快速增长,增加内存消耗,可能降低检索效率。因此,其效果高度依赖于索引策略。

3.3.3 Transform¶

这类方法专注于修改、压缩或重组现有的潜在状态,而不是生成全新的状态或直接重用原始KV缓存。它在概念上介于“生成”和“重用”之间。

工作原理:将KV缓存和隐藏激活值视为可塑的记忆单元,通过选择、聚合或结构变换来重塑它们。主要目标是压缩KV缓存同时保留核心语义。

具体技术路径:

基于重要性选择/剪枝:只保留最重要的标记或KV对。例如:Scissorhands(基于注意力分数剪枝)、SnapKV(聚合高重要性前缀KV)、SirLLM(基于标记熵估计重要性)、Memory3(只存储最关键的KV对)。

压缩与重编码:例如 RazorAttention,计算每个注意力头的有效范围,仅保留局部窗口,并使用补偿标记来保留被丢弃条目的信息。

简单驱逐策略:例如 H2O,仅保留最近的标记和一些特殊标记来减少内存占用。

讨论:

优点:能产生更紧凑、信息密度更高的记忆表示,降低了存储成本,使长上下文检索更高效;经过提炼的语义信号可能比原始激活值更有用。

缺点:变换过程有信息损失的风险;与直接重用的KV缓存相比,压缩后的状态更难解释或验证;进行剪枝、聚合或重编码所需的额外计算增加了系统复杂性。

核心要点总结¶

本质:潜在记忆是模型内部表示的隐式携带,是高效、隐蔽的记忆形式。

分类逻辑:依据记忆的“起源”分为生成(全新创建)、重用(原样复用)、变换(修改压缩)。

权衡:

生成型:灵活、高效,但可能损失信息且复杂。

重用型:保真、简单,但存储和检索开销大。

变换型:折中、紧凑,但可能损失信息且增加计算。

3.4 Adaptation¶

Figure 5 Overview of three complementary memory paradigms for LLM agents

记忆类型 |

核心特征 |

适合的应用场景 |

|---|---|---|

Token-level Memory |

符号化、可寻址、透明。 |

多轮对话、个性化代理、推荐系统、高风险领域(法律、金融、医疗)。 |

Parametric Memory |

隐式、抽象、可泛化。 |

角色扮演、推理密集型任务、需要获得根本性新能力的任务。 |

Latent Memory |

隐式、人类不可读。 |

多模态记忆、设备端或边缘部署、低资源或小数据场景。 |

Token-level Memory¶

特征: 符号化、可寻址、透明。这意味着记忆像数据库中的一条条记录,可以被精确查找、理解和修改。

优势:

实时可控: 适合需要持续跟踪和修订信息的场景。

可解释与可审计: 决策可追溯到具体记忆单元,这对高风险领域(如法律、医疗)至关重要。

长期稳定: 避免了“灾难性遗忘”,知识可长期可靠积累。

即插即用: 作为外部模块,易于与各种大模型集成,无需修改模型内部参数。

应用场景解读: 所列举的场景(如聊天机器人、个性化档案、推荐系统、企业知识库)共同特点是:需要精确管理、高度透明、长期稳定且可验证的知识。记忆在这里更像一个外部知识库或用户档案。

Parametric Memory¶

特征: 隐式、抽象、可泛化。记忆被“融化”在模型参数中,成为其内在能力的一部分。

优势:

概念理解与模式归纳: 擅长捕捉跨领域的通用知识和规则。

流畅推理与端到端处理: 由于知识已内化,无需外部查询,推理过程更流畅。

系统性泛化: 能将学到的模式推广到未见过的任务变体上。

应用场景解读: 所列举的场景(如角色扮演、数学推理、代码生成、人类价值观对齐)共同特点是:需要智能体具备深层次的理解、稳定的风格或强大的推理泛化能力。记忆在这里表现为模型的内在秉性、专业风格或核心思维框架。

Latent Memory¶

特征: 介于显式数据和固定参数之间,是一种压缩的、机器友好的中间表示。人类难以解读,但机器处理效率高。

优势:

隐私保护: 低可读性天然适合处理敏感信息。

高表达与高效率: 能以高密度压缩知识,实现高效检索和集成,适合注入大量知识。

多模态融合: 便于统一处理文本、图像等多模态信息。

资源友好: 高压缩比使其适合设备端(边缘)部署和低资源环境。

应用场景解读: 所列举的场景(多模态架构、边缘部署、隐私敏感应用)共同特点是:需要在资源受限、注重效率、或涉及多模态/隐私数据的环境中,实现高性能的知识存储与调用。记忆在这里像一个高效的、加密的、跨模态的“缓存”或“索引”。

本节总结与启示¶

设计选择即行为塑造: 选择哪种记忆,决定了智能体是像一个严谨的档案管理员(词元级)、一个富有洞察力的专家(参数化)、还是一个高效隐蔽的处理器(潜藏记忆)。

权衡是核心: 三种记忆在可解释性 vs. 性能、更新灵活性 vs. 稳定性、资源消耗 vs. 效率等方面存在根本性权衡。

实际应用: 在构建智能体系统时,应根据任务的核心需求(是否需要透明审计?是否需要深度推理?是否受资源限制?)来主导记忆类型的选择,甚至可以混合使用以兼顾不同需求。

备注

记忆不是存储问题,而是行为塑形问题。

选 token-level,你在设计一个可控、可审计的理性代理

选 parametric,你在塑造一个有内在能力与风格的智能体

选 latent,你在构建一个高效、密集、机器原生的认知系统

4. Functions: Why Agents Need Memory?¶

备注

从“无状态的大模型”到“有目标、可持续行动的 Agent”,不是加点功能,而是范式跃迁。

Figure 6 The functional taxonomy of agent memory.

核心矛盾:无状态的局限性

大语言模型(LLM)的默认状态:是无状态的通用文本处理器。每次交互都是独立的,不“记得”之前的对话或经历。

智能体的本质要求:必须能够持续存在、适应并在时间线上连贯地互动。这与“无状态”是根本矛盾的。

解决方案:记忆能力

解决问题的关键不仅仅是扩大上下文窗口(一次性可处理的信息量),而在于具备真正的记忆能力。

本章节聚焦于记忆的 “功能/目的”(Why),而非具体实现方法(How)。

记忆的功能性分类 论文提出了一个系统性的功能分类法,将记忆按时间跨度和核心目的进行划分:

按时间跨度分:

长期记忆:持久的、跨会话的知识存储。

短期记忆:临时的、会话内的工作空间。

按功能目的分(三大支柱):

事实性记忆

经验性记忆

工作记忆

功能类型 |

对应问题 |

核心目的 |

类比与示例 |

|---|---|---|---|

1. 事实性记忆 |

“智能体知道什么?” |

确保一致性、连贯性与适应性。存储关于用户、环境、世界等的声明性知识(具体事实)。 |

如同个人的长期知识库或数据库。例如:记住用户的姓名、偏好、之前对话中提到的关键信息、环境规则等。 |

2. 经验性记忆 |

“智能体如何改进?” |

实现持续学习与自我进化。存储程序性知识,即从过去的成功、失败、策略中抽象出的“经验”和“技能”。 |

如同个人的经验教训库或技能手册。例如:记住解决某个问题的最佳步骤、上次尝试失败的原因、有效的沟通策略等。 |

3. 工作记忆 |

“智能体现在在想什么?” |

进行活跃的上下文管理与即时推理。作为容量有限、动态控制的临时“便签本”,用于处理当前任务。 |

如同你大脑中正在思考问题的“桌面”。它从长期记忆中提取相关信息,并在此进行组合、推理和规划。 |

动态认知循环:

这三类记忆并非孤立,而是构成了一个动态、互联的认知循环架构:

编码:智能体将互动结果(新事实、失败的计划)通过总结、反思、抽象等方式,巩固到长期记忆(事实性和经验性记忆)中。

处理:在工作记忆这个活跃工作区中进行即时推理和决策。

检索:为了支持上述处理,系统需要从长期记忆中检索相关的背景知识和技能,填充到工作记忆中。

4.1 Factual Memory¶

核心概念解析

定义:事实性记忆是指智能体存储和提取明确的、陈述性的事实的能力。这些事实包括过去的事件、用户特定信息和外部环境的状态。

内容范围:对话历史、用户偏好、外部世界的相关属性(如文档状态、工具可用性)。

核心作用:通过利用历史信息来理解当前输入,它是实现情境感知、个性化响应和长期任务规划的基石。

理论框架:借鉴认知科学

为了理解记忆的结构,论文借鉴了认知科学中的 “陈述性记忆” 框架。

陈述性记忆:指可以有意识访问的长期记忆。

两大组成部分:

情景记忆:存储个人亲历的、有具体时空背景的事件(什么、在哪里、何时)。其核心特征是能够“在心理上重新体验”过去。

语义记忆:存储独立于获取情境的普遍事实、概念和词语含义。

在智能体系统中的映射:

并非严格的二分法,而是一个处理连续体。

流程:系统首先记录具体的交互历史作为情景痕迹(如对话轮次、用户行为)。

抽象化处理:随后通过总结、反思、实体提取、事实归纳等方法进行处理。

存储:处理后的抽象知识被存储在向量数据库、键值对存储或知识图谱中,并经过去重和一致性检查。

最终目标:将原始的事件流,逐渐转化为可重复使用的语义事实库。

功能性要求

这种架构确保了智能体在交互中表现出三个基本属性:

连贯性:强大的情境感知能力。能回忆并整合相关历史,提及过去的用户输入,保持话题连续性,确保对话逻辑相连而非孤立。

一致性:行为和自我呈现随时间保持稳定。通过维护关于用户事实和自身承诺的持久内部状态,避免矛盾和立场随意变化。

适应性:基于存储的用户画像和历史反馈来个性化行为的能力。使响应风格和决策逐渐符合用户的特定需求和特点。

分类视角:以实体为中心

为了方便阐述,论文根据记忆所指涉的主要实体进行组织,分为两大应用领域:

用户事实性记忆:维持人与智能体之间交互一致性的信息(身份、稳定偏好、任务限制、历史承诺)。

环境事实性记忆:维持与外部世界一致性的信息(文档状态、资源可用性、其他智能体的能力)。

4.1.1 User factual memory¶

定义与功能

定义:跨会话和任务持续保存关于特定用户的可验证事实,包括身份、偏好、习惯、历史承诺和显著事件。

主要功能:防止无状态交互的典型失败模式(如指代漂移、重复询问、矛盾回答),从而减少对长期目标的干扰。

工程实践目标:在有限的访问成本下,维持长程的对话和行为连贯性。主要包括:信息选择与压缩、结构化组织、检索与复用、一致性管理。

实现机制一:保障对话连贯性

为了在长对话中保持话题连贯、事实一致和角色稳定,现代系统采用两种互补策略:

启发式选择:

核心:在有限的上下文窗口内,有选择地保留和排序交互历史。

方法:并非保留所有原始日志,而是维护结构化存储,并根据相关性、新鲜度、重要性、独特性等指标对条目进行排序和筛选。

目的:保留高价值信息,并定期压缩成高级摘要,为后续响应提供上下文,避免工作记忆过载。

语义抽象:

核心:将原始对话片段转化和抽象为更高级别的语义表示。

方法:例如“在记忆中思考”和“反思性记忆管理”等方法,通过迭代更新操作,将原始交互痕迹转化为思想表征或反思。

优势:使智能体能够查询稳定的语义记忆,让后续回复在主题上更一致、更少重复。将记忆存储与原始的表面文本形式解耦,能稳定长对话中的角色和偏好表达。

实现机制二:保障目标一致性

为了确保任务目标不漂移,需要随时间维护和细化明确的任务表征。

动态任务状态跟踪:系统利用事实性记忆来动态追踪和更新任务状态。

方法:例如一些方法会保留已确认的信息,同时高亮未解决的元素。

作用:基于任务意图引导检索,帮助智能体满足缺失的约束,在跨会话中保持专注。

结构化记忆以支持复杂任务:对于长期复杂任务,记忆通常被结构化以便围绕当前目标进行局部检索。

例子:将记忆组织成互连的笔记图,或使用联想机制在后续步骤需要时回忆前提事实。

具身场景中的应用:在具身智能(如家庭机器人)场景中,事实性记忆将行为锚定在用户习惯和环境上下文中。

例子:持久化存储家庭成员、物品位置和日常习惯,复用这些信息以最小化冗余探索和重复指令。或将自我中心的视觉流处理成可通过文本寻址的条目,使智能体能基于过去的视觉经验回答问题。

本节总结 这些机制共同将短暂的交互痕迹转化为持久化的认知基础。通过整合基于检索的排序和生成式抽象,用户事实性记忆将系统从简单的相似性匹配,升级为对明确目标和约束的主动维护。这带来双重好处:

增强信任:通过长期的行为连贯性培养熟悉感和信任。

提升效率:通过提高任务成功率、减少冗余、降低错误恢复开销来增强操作效率。

4.1.2 Environment factual memory¶

定义与功能

定义:指与用户外部的实体和状态相关的记忆,涵盖长文档、代码库、工具和交互痕迹。

核心目标:提供一个可更新、可检索、可管理的外部事实层,为跨会话和阶段提供稳定参考。

解决的问题:事实回忆不完整、来源不可验证、多智能体协作中的矛盾和冗余、异构环境中长期任务的不稳定。

分类维度一:知识持久化 指对世界知识和领域特定知识的持久化表示,支持长文档分析、事实问答、多跳推理以及可靠的代码/数据资源检索。

知识组织:研究重点是如何结构化外部数据以增强推理能力。

例子:使用知识图谱促进证据传播,或使用动态层次结构优化大型语料库中的聚合和定向访问。

存储形式:将事实知识从模型权重中解耦,外化到数据库中。

优势:支持直接的知识编辑和来源验证,无需重新训练模型。

知识更新:针对需要持续学习的环境,参数中心化方法将持久化直接整合到模型架构中。

方法:引入可训练的记忆池或侧边网络来吸收新信息。

目的:专注于模型编辑的挑战,使智能体能适应动态环境、纠正过时事实,同时保持预训练主干模型的稳定性。

分类维度二:共享访问 为多智能体协作建立可见且可管理的共同事实基础,用于对齐目标、传递中间产物、消除冗余工作。

共享知识库:维护一个集中的历史查询和响应存储库。

作用:使智能体能够异步访问并基于同伴积累的见解进行构建,让个体直接从集体知识中受益,抑制矛盾结论,提升整体效率。

复杂项目协调:将共享消息池作为中央工作空间,用于发布计划和部分结果。

作用:促进围绕当前项目状态的一致性维护,减少通信开销,并能从历史协作中提取可复用的工作流。

社会模拟:在社会仿真平台中,将全局环境和公共交互日志建模为一个共享的记忆基质。

作用:该基质被群体逐步更新和观察,允许信息在智能体间自然扩散,支持大规模、连贯且具有历史感知的社会动态。

本节总结 环境事实性记忆提供了一个持续可更新、可审计、可复用的外部事实层。

在知识维度:通过结构化组织和长期记忆模块,提高了事实回忆的完整性、可解释性和可编辑性。

在协作维度:通过共享和治理机制,保持了跨智能体和跨阶段的一致性,从而在长期、多参与者和多源信息的复杂条件下,实现稳健的决策和执行。

总结:本章节系统性地阐述了智能体“事实性记忆”的概念、理论基础、功能属性,并重点从用户和环境两个实体维度,详细分析了其设计目标、实现技术和应用价值,构成了智能体具备长期一致性和情境感知能力的核心模块。

4.2 Experience Memory¶

Figure 7 Taxonomy of experiential memory paradigms.

体验记忆是智能体将历史轨迹、精炼策略和交互结果编码为持久、可检索表征的机制。它区别于处理瞬时上下文的工作记忆,专注于跨不同事件的长期知识积累与迁移。

编码的是历史轨迹(trajectories)

提炼的是策略(strategies)

保留的是交互结果(outcomes)

和 working memory(工作记忆)不同,这里的目标不是“撑住当前对话”,而是跨 episode 的知识积累与迁移。

理解解析:

核心功能: 记忆库或数据库,用于长期存储和复用过去的经验。

理论来源: 类比人类的非陈述性记忆(如骑自行车、形成习惯),即通过实践而非语言获得的技能。

程序性记忆(procedural memory)

习惯系统(habit systems)

实现差异: 人类依赖神经网络(隐式学习),而智能体使用明确的数据结构(如向量数据库、符号日志),从而获得了内省、编辑和推理自身知识的独特能力。

关键作用:

是实现持续学习和自我进化的基础。

通过积累结构化经验,智能体无需频繁调整模型参数(昂贵且低效)即可实现适应,形成“从交互到知识,再用知识指导交互”的学习闭环。

持续学习(continual learning)

自我演化(self-evolution)

具体带来的效果:

修正过去错误

抽象可泛化启发式

编译常规行为

减少重复计算

决策越来越“顺手”

分类标准: 论文按存储信息的抽象层级,将体验记忆分为三类(见图7和表5)。

三种体验记忆类型¶

基于案例的记忆(4.2.1): 存储最小化处理的历史事件原始记录,信息保真度高。用于直接回放和模仿,提供具体、可验证的证据。

基于策略的记忆(4.2.2): 从过去轨迹中提炼出可迁移的推理模式、工作流程和高级洞见。作为认知脚手架,将决策逻辑与具体情境解耦,提升跨任务泛化能力,约束复杂推理的搜索空间。

基于技能的记忆(4.2.3): 封装可执行的程序化能力(从代码片段到标准API)。将抽象策略具体化、可操作化,是智能体主动执行的底层基础,支持模块化能力扩展。

Case-based

Strategy-based

Skill-based

4.2.1 基于案例的记忆(Case-based Memory)¶

特点:

保留“情境 ↔ 结果”的原始对应关系

用于 replay、模仿、in-context exemplars

信息保真度最高,抽象最低

你可以把它理解成:

episode 日志

trajectory replay buffer

高级版的“对话样本 + 行为轨迹”

原文核心: 存储接近原始事件的记录,优先保真度,以便作为上下文中的示例进行回放或复用。它避免过度抽象,保留了情境与解决方案的原始对应关系。

理解解析:

本质: 一个事实证据库。像存档的监控录像或详细的实验记录。

两大存储类别:

轨迹: 存储完整的交互序列。例如,在游戏中回放成功通关的完整操作序列来学习。

解决方案: 存储被证明成功的具体解决方案。像一个“解题集”,遇到类似问题时直接检索和参考。

优点: 信息保真度高,提供可验证证据。

缺点: 依赖原始数据,可能导致检索效率低和上下文窗口消耗大。

定位: 是高级推理所依据的事实基础,本身不包含编排逻辑或函数接口。

“我以前遇到过类似情况,当时是这么做的。”

4.2.2 基于策略的记忆(Strategy-based Memory)¶

它存的是:

推理模式

工作流

抽象洞察

跨任务可迁移的结构

备注

Strategy 不是 action,它是 planning scaffold(规划脚手架)

原文核心: 区别于存储“发生了什么”的案例库,策略记忆提取关于“如何行动”的可迁移知识。它将经验提升为可编辑、可审计、可组合的高级知识,减少对冗长轨迹回放的依赖。

理解解析:

本质: 一个方法论知识库。像厨师的经验法则、工作流程手册或解决问题的通用模板。

三个层级(由细到粗):

洞见Insights: 细粒度的决策规则和反思启发(如“如果网页加载慢,先刷新试试”)。

示例

最小单位的经验提炼

决策规则

反思性启发式

典型用途:

从成功 / 失败中总结一句“教训”

高层 planning 时直接调用

工作流程Workflows: 结构化的行动序列(如“在线购物的标准步骤:登录-搜索-比价-下单-支付”)

比 insights 更结构化:

多步策略

可复用执行顺序

高层但仍然是“怎么走这条路”

示例

SOP

Plan template

高级宏指令

模式Patterns: 高级的认知模板,封装解决问题的结构(如“解决数学证明题的通用框架:假设-推导-验证”)

最高抽象层:

不告诉你具体做什么

告诉你问题应该长什么形状

示例

先分解 → 再验证 → 再反思

某类问题通用的 reasoning skeleton

优点:

提供可泛化的模式/模板

有效约束搜索空间

提升在未知任务上的鲁棒性

**关键区别:

** 策略是结构性指导方针,而非可执行动作。

它指挥计划过程,但不直接与环境交互

4.2.3 基于技能的记忆(Skill-based Memory)¶

原文核心: 技能记忆捕捉智能体的程序化能力,将抽象策略操作化为可验证的行动。它编码“智能体能做什么”,为感知-推理-行动循环提供可调用、可测试、可组合的执行单元。

理解解析:

本质: 一个可执行工具库。像程序员的代码函数库、工匠的工具箱或应用程序的API集合。

**核心标准:

可被 agent 调用(callable)

结果可验证(verifiable)

能与其他技能组合(composable)

具体形式(从内到外):

代码片段: 最直接、灵活的内部可执行单元。

函数/脚本: 模块化的行为封装,增强可复用性。

API: 技能封装的通用接口,当前瓶颈在于如何准确检索到合适的功能。

MCP: 旨在统一工具发现和使用的开放协议标准,解决API生态碎片化问题。

前沿探索: 研究正将技能记忆扩展为可学习的、可进化的、可编排的能力层,例如学习神经工具的特性、将工具符号参数化、或将整个专用智能体架构视为可调用技能。

总结作用: 是智能体主动执行的底层,弥合了抽象计划与环境交互之间的鸿沟。

4.2.4 混合记忆¶

原文核心: 先进的智能体架构越来越多地采用混合设计,集成多种形式的体验记忆,以在具体证据与可泛化逻辑之间取得平衡。通过维护从原始事件到抽象规则再到可执行技能的知识谱系,系统能动态选择最合适的内存格式。

理解解析:

核心理念: 没有一种记忆形式是万能的。一个强大的智能体需要综合运用不同层级的记忆。

常见组合模式:

案例 + 策略: 用策略(工作流/模式)进行高级规划,用具体案例提供执行细节和证据。

整合技能: 在循环中加入技能记忆,形成完整的“计划(策略)-> 参考(案例)-> 执行(技能)”链路。

动态进化: 成功的案例可以被自动编译成高效的技能,实现从“反复检索”到“快速调用”的自动化升级。

代表系统: 如

ExpeL、Agent KB、ChemAgent、LARP等,它们都设计了机制来协同利用多种记忆,实现更鲁棒、更高效的推理与行动。

总结而言,本节系统地阐述了体验记忆作为智能体持续学习核心机制的理论基础、分类体系(案例、策略、技能)及其具体实现和融合方式,描绘了一个从具体经验存储到抽象知识提炼,再到具体能力封装的完整认知架构演进图景。

总结¶

备注

Experiential memory 不是一个存储模块,而是一条经验流动管线:

Case 是事实,Strategy 是思维,Skill 是行动。 Hybrid 是把三者接成闭环。

4.3 Working Memory¶

核心概念解析:

人类工作记忆:在认知科学中,工作记忆是一个容量有限、动态控制的机制。它不仅仅是短期存储,更是对信息的主动控制,包括选择、保持和转换,以支持推理、决策等高级认知。关键限制是注意力资源有限。

LLM的“工作记忆”问题:目前大语言模型的标准上下文窗口像一个只读的、被动的缓冲区。模型可以读取里面的所有信息,但缺乏像人类那样动态、主动管理这些信息的能力(比如聚焦关键点、忽略干扰、更新信息)。

论文中的定义:作者将LLM的工作记忆定义为 “在单个任务会话中,对上下文进行主动管理和操作的机制集合” 。目标是把被动的上下文窗口变成一个可控、可更新、抗干扰的工作空间。

核心益处:

在固定的注意力预算下,增加任务相关信息的密度。

抑制冗余和噪音。

通过重写或压缩表征,保持连贯的思维链。

两大分类(基于交互动态):

单轮工作记忆:处理单次输入中的海量信息(如长文档、视频流)。重点在于输入浓缩与抽象。

多轮工作记忆:处理多轮交互中的历史信息。重点在于时间状态维护,防止历史积累压垮系统。

4.3.1 单轮工作记忆¶

要解决的问题:在一次前向传播中,处理超长的单次输入(如整本书、整个视频)。

核心目标:构建一个可写的工作空间,对原始信息进行过滤和转换,在固定资源下提高信息密度和可操作性。

两大技术路线:

1. 输入浓缩¶

目标:减少物理Token数量,但保留核心信息。

硬浓缩:基于重要性评分(如困惑度)直接丢弃不重要的Token或片段。

优点:高效。

缺点:可能破坏语法或语义连贯性。

软浓缩:将变长上下文编码成固定长度的密集向量(记忆槽)。

优点:压缩比高,能保留更多语义。

缺点:需要额外训练,可能丢失细节。

混合浓缩:结合软硬两种方法的优势,例如用全局语义适配器(软)结合Token级保留概率(硬)。

2. 观察抽象¶

目标:将原始、高维、杂乱的观察数据(如网页DOM树、视频帧)转换为结构化的、语义化的表征。

作用:将动态的高维空间映射到固定大小的记忆状态,防止智能体被原始数据淹没。

实例:

将HTML树改写为任务相关的状态摘要。

将视频流转换为按时间顺序的事件描述,而非处理每一帧。

本节小结: 单轮工作记忆像一个主动压缩层,针对静态、复杂但单次的输入进行优化,最大化上下文窗口在即时推理中的效用。但它不处理跨轮次的连续性问题。

4.3.2 多轮工作记忆¶

要解决的问题:在长程多轮交互中,主要瓶颈从单次输入容量转向了任务状态和历史相关性的持续维护。即使上下文窗口很长,历史积累也会导致注意力饱和、延迟增加和目标漂移。

核心目标:构建一个外部化的状态载体,通过“读-评估-写”的循环,在一个有限的资源预算内,维护关键状态信息的可访问性和一致性。

三大状态管理策略:

1. 状态巩固¶

核心:将不断增长的交互轨迹动态更新到一个固定大小的状态空间。

方法:使用循环机制更新固定容量的记忆,丢弃冗余。

高级形式:将巩固过程构建为优化问题,或采用类似马尔可夫决策过程的框架,迭代地重构工作空间。

2. 层次化折叠¶

核心:为复杂的长期任务引入层次结构。基于子目标分解任务轨迹。

流程:

分解:为任务创建子目标。

执行:仅保留当前活跃子目标的详细轨迹(动作-观察对)。

折叠:子目标完成后,将其详细轨迹摘要为一个高级别的状态描述,存入记忆。

优点:允许工作记忆根据子任务的活跃度动态扩展和收缩,用稳定的高级抽象替换已完成的细节,保持活跃窗口小巧。

3. 认知规划¶

最高抽象级别:将工作记忆本身作为外部化的计划或世界模型来创建和维护。此时的状态不仅是过去的总结,更是指导未来行动的前瞻性结构。

方式:

将记忆检索直接集成到规划循环中。

在具身或智能体环境中,使用3D场景图、分层计划等作为工作记忆的核心,让智能体锚定在计划上进行推理和行动。

本节小结: 多轮工作记忆的核心是构建一个可操作的状态载体,而非保留原始历史。通过整合上述三种策略,它将推理性能与交互长度解耦,使智能体能够在无限长的交互中保持时间连贯性和目标一致性,同时遵守严格的计算约束。

总体总结¶

论文将认知科学中的工作记忆概念引入LLM研究,提出了一种范式转变:从被动的上下文缓冲转向主动的、会话内的上下文管理。通过模仿人类工作记忆的“主动操控”特性,这些机制能有效抑制干扰,并为长上下文推理的工程限制提供了实用的解决方案。单轮记忆解决信息广度问题,多轮记忆解决时间连续性问题。

5. Dynamics: How Memory Operates and Evolves?¶

阐述了智能体记忆系统的动态运行机制。

论文的核心主旨是:智能体的记忆不是一个静态的数据库,而是一个动态的、自我演化的生命系统。第五章旨在回答“记忆如何运行和演化?”这个问题。

本章核心:从静态的存储观念,转向动态的记忆管理范式。这是智能体实现终身学习和自我进化的关键。

本章将完整的记忆生命周期解耦为三个基础过程,它们形成一个闭环:

记忆形成:从原始经验中提取有用的知识单元。

记忆演化:将新记忆与旧记忆整合、更新,保持知识库的活力。

记忆检索:在需要时,精准地从知识库中获取相关信息。

5.1 Memory Formation¶

Figure 8 The operational dynamics of agent memory.

核心问题:“如何提取记忆?” 定义:将原始的、冗长的、嘈杂的交互数据(如对话、图像)编码为紧凑的知识表示。目的是解决处理长上下文时的计算开销和性能下降问题。

根据信息压缩的粒度和编码逻辑,论文将记忆形成分为五类:

1. 语义摘要Semantic Summarization¶

做什么:将冗长的原始数据压缩成紧凑的、保留全局高层语义的摘要(如文档叙事、任务流程、用户画像)。

关键词:宏观、低分辨率、高效率

目标:过滤冗余,提供高层蓝图,减少上下文负担。

特点:

保留 全局语义

丢掉 细节事实

非常省上下文

适合存什么?

文档主旨

任务流程概述

用户画像轮廓

两种实现方式:

增量式摘要:

像滚雪球一样,不断将新信息融合到现有摘要中,使其持续演化。优点是支持渐进学习,但可能存在语义漂移和累计错误。

后续演进方向是:

加过滤器

用 RL 强化总结能力

逐步“内化”总结技能

分区式摘要:

将信息按语义或结构划分成块,分别为每个区块生成摘要。优点是效率高,能捕捉细粒度语义,但可能丢失跨区块的语义关联。

特点:一种有损压缩,强调全局连贯性而非局部事实精确性。优势是高效,劣势是可能丢失关键细节。

语义摘要:像为一部电影写剧情简介。

目标:抓住整体故事脉络、核心主题和情感基调。

结果:“这是一个关于勇气与救赎的史诗故事,讲述了主角从懦弱到英雄的成长历程。”

你失去了:具体的对白、次要角色的细节、每一场打斗的招式。

你得到了:对影片全局的、高层的理解。

2. 知识蒸馏Knowledge Distillation¶

做什么:在比语义摘要更细的粒度上,从交互轨迹或文档中提取可重用的具体知识。

两种蒸馏类型:

事实记忆蒸馏:

提取关于用户和环境状态的可验证的、声明性事实(如用户偏好、目标、物体位置)。确保智能体的一致性和适应性。

经验记忆蒸馏:

从历史任务执行轨迹中提取策略、规划和关键洞察。

既从成功中学习通用模式,也从失败中反思错误,抽象出可迁移的规划原则

旨在提升特定任务的问题解决能力,并支持跨任务知识迁移

最新趋势:不再靠 prompt,而是训练模型“学会怎么提炼经验”

特点:提取的是功能特定的知识,每个知识可以看作一个扁平的记忆单元。它是更复杂记忆形成方法的基础组件。

关键思想:不要记“说过什么”,要记“事实是什么”

知识蒸馏:像为这部电影写观影指南或战术分析。

目标:提取具体、可复用的事实、技巧或洞察。

结果(事实性):“主角的武器是‘星光剑’,它怕水。”“反派Boss的弱点是其左肩的旧伤。”

结果(经验性):“面对群体敌人时,主角的策略是先解决远程攻击者。”“在第三幕的谈判中,成功的关键是出示信物A。”

你得到了:一系列离散的、可被直接调用和应用的“知识点”或“策略包”。

在长对话中:

语义摘要:将过去100轮对话总结为:“用户正在策划一次去日本的自由行,主要关注关西地区的美食和文化景点,预算中等。”

知识蒸馏:从中提取出:

事实记忆:“用户对生食海鲜过敏。”

经验记忆:“当用户犹豫时,提供带有图片和价格对比的选项列表最有效。”

在阅读技术文档后:

语义摘要:“这份文档介绍了深度学习框架PyTorch 2.0的核心特性,主要围绕编译优化和动态图增强展开。”

知识蒸馏:提取出:

事实记忆:“

torch.compile函数可以将模型转换为静态图以提高性能。”经验记忆:“对于包含大量控制流(if-else)的模型,使用

mode=‘reduce-overhead’编译选项效果更好。”

3. 结构化构建Structured Construction¶

做什么:将无定形的数据转化为有组织的拓扑结构表示(如知识图谱、层次树)。这不仅是存储格式的变化,更是主动的结构操作,决定了信息如何链接和分层。

核心优势:极大地增强了记忆的可解释性和检索效率,尤其擅长处理需要多跳推理的复杂逻辑和依赖关系。

两种构建范式:

实体级构建:

将文本原子化为实体和关系来构建底层拓扑(如知识图谱)。

最新进展是构建包含语义层、情景层和社区层的多层图结构,以更好地捕捉抽象和时间信息。

分层图

语义图 + 情景图 + 社区图

区块级构建:

将连续的文本片段或离散的记忆项作为节点,组织成拓扑结构。

演进路径是:从处理固定语料库的静态平面结构,到适应流式数据的动态平面结构,再到语义更丰富的动态层次(3D)结构。

特点:优势是可解释性强,能处理复杂关系查询。劣势是模式刚性,预定义的结构可能无法表达微妙信息,且构建和维护成本高。

4. 潜在表示Latent Representation¶

做什么:绕过人类可读的格式,将原始经验直接编码成机器原生的潜在空间表示(如向量嵌入、Transformer的KV缓存)。

核心思想:直接在潜在空间中存储经验,减少了先摘要再编码过程中的信息损失。更利于机器认知,并能实现跨模态的统一表示。

两种类型:

文本潜在表示:例如,将记忆表示为可自我更新的潜在嵌入,在推理时注入模型层;或利用KV缓存作为记忆的一种形式。

多模态潜在表示:将视觉、语言等多模态输入压缩成固定长度的潜在令牌,实现密集、连续的跨模态记忆。

特点:优势是密度高、语义丰富,能与模型内部计算无缝集成,支持多模态对齐。劣势是不透明,像一个黑盒,难以调试、编辑或验证。

5. 参数化内化Parametric Internalization¶

做什么:将外部记忆直接整合到模型自身的参数(权重)中。这是记忆的终极巩固形式,将“检索信息”的模式转变为“拥有能力”的模式。

核心价值:从根本上增强模型的内在能力,消除外部存储和检索的开销,实现零延迟访问。

两种内化策略:

知识内化:将外部存储的事实性记忆(如概念、领域知识)注入模型参数。通常通过模型编辑技术实现(如ROME, MEMIT),或使用LoRA等参数高效微调方法。

能力内化:将程序性经验知识(如解决模式、战略规划)嵌入模型参数。通常通过从推理轨迹中进行监督微调或偏好优化来实现(如DPO, GRPO)。

特点:优势是访问零延迟,能力成为本能。劣势是容易导致灾难性遗忘,更新成本高,且一旦内化难以精确修改,灵活性差。

总结与关系¶

这五种记忆形成策略并非互斥,一个算法可以整合多种策略。它们构成了一个从“外部、显式、易编辑”到“内部、隐式、本能化”的连续谱:

语义摘要和知识蒸馏侧重于内容提炼,产生人类可读的知识单元。

结构化构建在提炼的基础上增加了组织关系,提供了更好的结构和可解释性。

潜在表示转向机器友好的密集编码,追求效率和与模型计算的融合。

参数化内化是最终阶段,将知识转化为模型的内在参数,实现能力的根本性提升。

这一节(5.1)系统性地回答了“记忆如何从原始经验中被提取和塑造出来”,为后续的记忆演化(5.2)和检索(5.3)提供了原材料和基础。

5.2 Memory Evolution¶

Figure 9 The landscape of Memory Evolution mechanisms.

如果一直写入新记忆不演化会导致三类灾难:

语义层面:新旧记忆可能重复、矛盾、指向同一事实的不同版本

时间层面:事实有时效性,旧信息可能已经失效

系统层面:记忆无限膨胀,检索和推理都会退化

原文定位与摘要:本节是“记忆形成”的后续步骤,核心问题是如何将新形成的记忆与已有的记忆库整合,以实现记忆系统的动态演化。作者指出,简单的追加策略会忽视记忆间的语义依赖、潜在矛盾和时效性。因此,需要引入“记忆演化”机制来综合处理这些挑战。

备注

核心思想:记忆演化不是一个被动的存储过程,而是一个主动的、智能的认知管理过程。它旨在维护记忆库的紧凑性、一致性和相关性,使系统能够适应环境和任务的变化。 Memory Evolution:不是“存更多”,而是 整理、修正、裁剪。

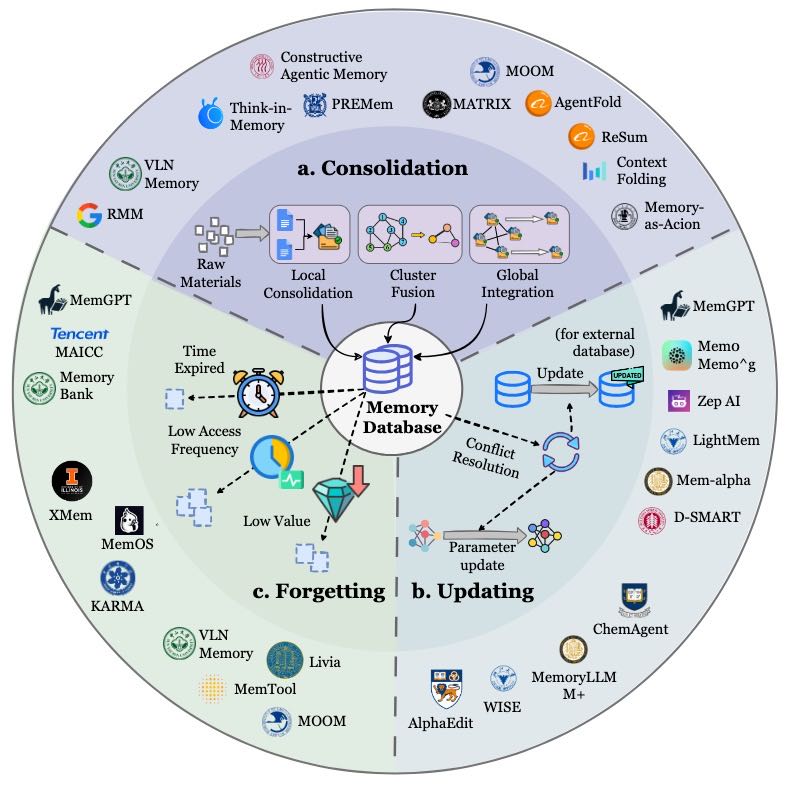

Three Mechanisms of Memory Evolution¶

三种机制:

Consolidation:合并、抽象、升维

Updating:冲突修正、事实同步

Forgetting:主动遗忘、控制复杂度

作者将记忆演化分解为三个具体机制,它们共同构成了一个完整的认知管理循环:

记忆巩固(Memory Consolidation - 5.2.1):“融合与升华”

目标:

把短期、碎片、情境化的信息,转成结构化、可泛化的长期知识

不只是简单合并,而是进行反思性整合(reflective integration),形成更泛化(generalized)的洞察。这确保了学习是**累积性(cumulative)**的,而不是孤立的。

类比:就像学生把课堂笔记整理成思维导图或知识大纲,将零散知识点提炼为系统的、可迁移的概念。

两个关键作用

结构化:把零散的经历组织成 schema,避免短期记忆消失后信息断裂。

抽象与泛化:从具体事件中提取可复用模式,支持跨任务迁移。

记忆更新(Memory Updating - 5.2.2):“纠错与同步”

目标:解决新旧记忆间的冲突,通过修正和补充来保持知识的准确性和相关性。这使得智能体能够适应环境或任务需求的变化。

类比:像更新手机App或修正百科全书中的错误条目,确保信息是最新且正确的。

记忆遗忘(Memory Forgetting - 5.2.3):“精简与优化”

目标:主动移除过时或冗余的信息,释放存储容量并提高效率。这防止了因知识过载导致的性能下降,确保记忆库专注于可用的、当前的知识。

类比:就像清理电脑硬盘中的缓存文件或整理书房,扔掉不再需要的旧报纸和杂志,为重要资料腾出空间。

总结关系:这三个机制分别负责知识质量提升(巩固)、知识准确度维护(更新)和知识库效率优化(遗忘)。它们共同赋予了记忆系统主体性(agentic capabilities),使其能够进行持续学习和自主改进。

5.2.1 Consolidation¶

核心解读:本小节详细阐述如何将新获得的、短期的、碎片化的记忆痕迹,转化为结构化的、可泛化的长期知识。

两个主要目的:

结构化:将碎片信息重组成连贯的结构,防止关键细节在短期保留中丢失,并形成稳定的知识图式(knowledge schemas)。

抽象与泛化:通过对经验数据的抽象、压缩和概括,从具体事件中提取可复用的模式,获得支持跨任务泛化的洞察。

核心挑战:决定新记忆应以何种粒度与现有记忆匹配和合并。这引出了一个从微观到宏观的“融合光谱”:

备注

核心目标: Consolidation 的目标不是“存得更久”,而是:把短期、碎片、情境化的信息,转成结构化、可泛化的长期知识 本质上:从 episodic → semantic / procedural 的跃迁机制。

1. 局部融合Local Consolidation

最保守、最低风险

特征:只在高度相似的记忆之间操作,合并决策通常交给 LLM 判断

目标是:1. 减少重复2. 保留细节3. 不做激进泛化

优势:1.精度2.不容易“过度总结”

局限:1.看不到更高阶结2.无法形成跨事件的规则

操作对象:高度相似的细粒度记忆片段。

代表方法:

RMM:为每个新主题记忆检索K个最相似的候选,由LLM判断是否合并,降低错误泛化的风险。

VLN(多模态):当容量饱和时,触发“池化”机制,识别最相似或冗余的记忆对,将其压缩为更高级的抽象。

优点:精炼细节知识,保持全局结构,提升精度和存储效率。

局限:无法捕获集群级关系或跨语义相关记忆出现的高阶依赖。

2. 集群级融合Cluster-level Fusion

从“编辑”走向“建模”,是记忆从“日志”变成“知识结构”的关键跃迁

目标

把语义上相关的一组记忆视为一个 cluster

在 cluster 内或 cluster 间形成更高层表示

操作对象:一组相关的记忆(集群),旨在捕获跨实例的规律性。

代表方法:

跨集群(如 PREMem):对齐新旧记忆集群,应用“泛化”、“精炼”等融合模式,形成高阶推理单元,提升可解释性和推理深度。

集群内(如 TiM, CAM):在共享同一哈希桶或目标集群内的节点中,合并语义冗余条目或生成一个代表性摘要。

意义:在更广的范围内重组记忆结构,是迈向结构化知识的重要一步。

3. 全局整合Global Integration

重点不再是“哪些相似”,而是:1.全局一致2.长期轨迹中的规3.系统级洞察,在多步推理、长任务中,这一步是避免上下文爆炸的唯一出路

典型应用包括:

用户画像稳定化

跨任务经验提炼

工作记忆 → 长期记忆的压缩内化

操作对象:整个记忆库,旨在维护全局一致性,并从累积经验中提炼系统级洞察。

与5.1.1的区别:5.1.1的“语义摘要”是从现有上下文推导全局摘要(初始构建),而本段强调新信息如何整合到现有摘要中(动态更新)。

代表方法:

事实性记忆(如 MOOM):将临时的角色快照与历史轨迹整合,构建稳定的角色画像。

经验性记忆(如 Matrix):将执行轨迹、反思见解与全局记忆结合,提炼出与任务无关的原则,支持跨场景复用。

工作记忆压缩(如 AgentFold, Context Folding):在长序列交互中(如网页导航),自动对全局上下文进行总结和压缩,支持高效推理。

本节总结:

定义:巩固是将碎片化的短期痕迹重组为连贯的长期图式的认知过程。

价值:它超越了简单存储,能综合孤立条目间的联系,形成一个结构化的世界观,增强了泛化能力并减少了存储冗余。

风险:

抽象会“抹平异常”,少数但关键的 outlier 可能被吞掉。

可能导致信息平滑,即在抽象过程中丢失离群事件或独特例外,从而可能降低智能体对异常和特定事件的敏感性。

5.2.2 Updating¶

核心解读:本节聚焦于当出现冲突或获得新信息时,智能体如何修正或替换现有记忆。其核心是局部修正和同步,以保持与演化环境的一致。

与“巩固”的区别:

巩固:侧重抽象和泛化(形成更高层次的知识)。

更新:侧重局部修正和同步(保持知识准确及时)。

意义:是实现终身学习和自我进化的核心机制。

根据记忆的存储位置,更新分为两类:

1. 外部记忆更新

操作对象:向量数据库或知识图谱等外部存储中的条目。

原理:不改变模型权重,而是动态修改外部存储来实现事实对齐。

发展脉络(从简单到智能):

早期(规则/硬替换):如 MemGPT, D-SMART。LLM检测冲突后直接调用替换或删除操作。问题:破坏历史上下文和时间连续性。

演进(时间感知/软删除):如 Zep。为冲突事实打上无效时间戳而非删除,保留语义一致性和时间完整性。

优化(延迟一致性):如 MOOM, LightMem。采用双阶段更新:实时软更新(保证响应)+ 离线反思性巩固(合并相似、解决冲突),平衡延迟与一致性。

前沿(学习型策略):如 Mem-α。将记忆更新视为策略学习问题,让LLM学习何时、如何以及是否更新,实现稳定性与新鲜度之间的动态权衡。

2. 模型编辑

操作对象:模型参数空间内部的知识表示。

原理:直接修改模型参数以纠正或注入知识,是一种隐式知识更新。避免昂贵的全量重训练和灾难性遗忘。

主要方法:

显式定位与修改:如 ROME,通过梯度追踪定位编码特定知识的参数区域并进行针对性更新。

隐空间自更新:如 MEMORYLLM,在Transformer层中嵌入记忆池,定期替换记忆令牌以整合新知识;M+维护双层记忆,丢弃过时的短期条目,将关键信息压缩进长期存储。

混合方法:如 ChemAgent,将外部记忆更新与内部模型编辑结合,实现事实和表征变化的同步,以支持快速跨领域适应。

本节总结:

实现视角:更新专注于解决由新记忆到来触发的冲突和知识修正;而巩固强调新旧知识的整合与抽象。

双路径机制:外部数据库的冲突解决 + 模型内部的参数编辑,共同支持智能体的持续自我纠正和长期进化。

核心挑战:稳定性-可塑性困境。即,如何决定何时覆盖现有知识,何时将新信息视为噪声。错误的更新可能会覆盖关键信息,导致知识退化和推理错误。

5.2.3 Forgetting¶

核心解读:本节讨论如何有意识地移除过时、冗余或低价值信息,以释放容量并保持对关键知识的专注。与解决冲突的“更新”不同,“遗忘”优先考虑消除过时信息以确保效率和相关性。

必要性:无限制的记忆积累会导致噪声增加、检索延迟和过时知识的干扰。

风险:过于激进的修剪可能擦除罕见但关键的知识,损害长期上下文中的推理连续性。

遗忘机制可分为三类:

1. 基于时间的遗忘

依据:记忆的创建时间。

方法:模拟人类记忆的衰退。

硬性删除:如 MemGPT,在上下文溢出时驱逐最早的消息。

随机替换:如 Xu et al., Wang et al., 采用类似

K/N的替换率,模拟指数遗忘。软性衰减:如 MAICC,逐渐衰减记忆的权重而非直接删除。

特点:反映自然的时效性衰退。

2. 基于频率的遗忘

依据:记忆的检索行为(访问频率)。

方法:保留高频访问项,丢弃低频/不活跃项。

LFU(最近最不常用):如 XMem。

LRU(最近最少使用):如 MemOS,移除长期未用项,归档高活跃项。

特点:反映使用动态,确保高效检索和存储平衡。

3. 基于重要性的遗忘

依据:综合时间、频率和语义信号的综合价值评估。

目前最“智能”的方向:

融合时间、频率、语义、情感

从数值评分 → 语义判断

LLM 参与“是否值得记住”的决策

发展脉络:

早期(数值评分):如 Zhong et al., Chen et al.,结合时间衰减和访问频率计算综合得分。

演进(语义评估):

聚类去冗:如 VLN,通过相似性聚类合并语义冗余的记忆。

情感/上下文融入:如 Livia,结合情感显著性和上下文相关性。

LLM智能判断:如 TiM, MemTool,利用LLM直接评估记忆重要性并进行显式修剪。

特点:引入了语义辨别能力,实现有意识的、选择性的遗忘。

备注

如果存储成本不是问题**很多系统选择“不真删”**而是降权、冷藏、归档。

本节总结:

三机制关系:基于时间的衰减反映了自然的时间淡化,基于频率的遗忘确保了高效访问,基于重要性的遗忘引入了语义辨别。

共同目标:三者共同控制着智能体记忆如何保持及时、高效可访问和语义相关。

局限性:启发式遗忘机制(如LRU)可能消除长尾知识(很少被访问但对正确决策至关重要)。

实际权衡:当存储成本不是关键限制时,许多系统避免直接删除某些记忆,而是采用归档、降权等更温和的方式。

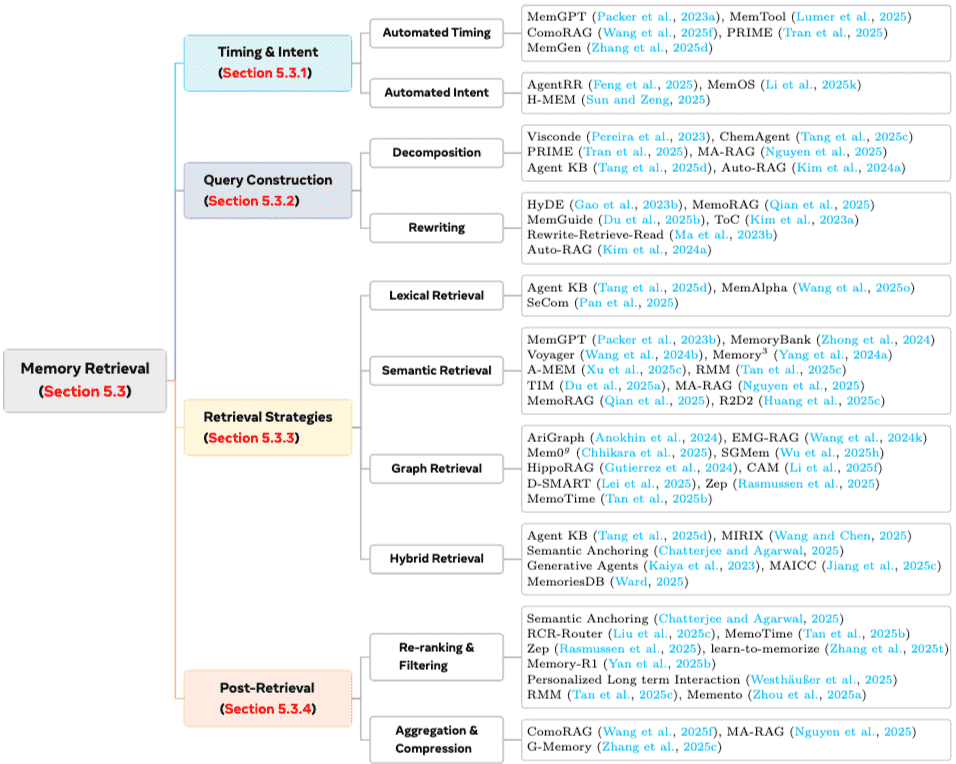

5.3 Memory Retrieval¶

Figure 10 Taxonomy of memory retrieval methodologies in agentic systems

本节核心思想

记忆检索是智能体在推理时,从海量记忆库中精准定位并提取相关、简洁知识片段的过程。

核心挑战在于:如何在大规模存储中做到高效与准确。

检索流程的四个阶段

1. 检索时机与意图:决定何时、为何目的去检索。

2. 查询构造:将用户的原始问题“翻译”成对记忆索引更有效的检索指令。

3. 检索策略:执行搜索的具体方法,如关键词匹配、语义搜索、图遍历等。

4. 检索后处理:对搜出的原始结果进行精炼,确保提供给模型的最终内容是简洁、连贯的。

这四个步骤共同将检索从一个静态的搜索操作,转变为一个动态的、类似人类联想记忆的认知过程。

把 Memory Retrieval 拆成四个按执行顺序排列的阶段,并强调这是一个动态认知过程,而不是静态搜索:

何时 & 为何检索(Timing & Intent)

用什么形式去检索(Query Construction)

怎么在记忆中找(Retrieval Strategies)

找回来之后怎么用(Post-Retrieval Processing)

整体理解:

Retrieval Timing and Intent

什么时候查?

查哪一类记忆?

Query Construction

把“用户说的话 / 当前思路”转换成记忆能听懂的检索信号

Retrieval Strategies

用关键词?向量?图结构?生成式?

Post-Retrieval Processing

查回来的一堆碎片,哪些该留下?怎么压缩?怎么组织成上下文?

备注

判断标准: 一个成熟的 agent 系统,应该把这四步编排成统一流水线,而不是散落在 prompt 或硬编码逻辑里。

5.3.1 检索时机与意图¶

本小节核心:解决 “什么时候检索?” 和 “检索哪个记忆库?” 的问题。目标是实现自主、有选择性的检索,以节省计算资源,避免信息过载。

备注

人在思考时不是一直翻记忆,而是在“卡住 / 怀疑 / 需要证据”时,才有选择地调取合适层级的记忆。

两种设计(本文使用第2种)

Always-on retrieval

每次 query 都查所有记忆

代表:MIRIX

优点:不会漏

缺点:噪声巨大、成本高、上下文膨胀

Selective retrieval

只有在“需要时”才查

更接近人类认知

关键概念解析¶

自动化检索时机Automated Retrieval Timing:模型自主判断在推理过程中何时需要发起检索。

简单策略:

根据当前查询直接判断是否需要检索(如MemGPT、MemTool)。

进阶策略:

引入快慢思考机制。

例如,

先快速生成一个答案,如果模型自己评估认为不充分,再触发深度检索(如ComoRAG, PRIME)。

MemGen则将此决策过程转化为一个可学习的“记忆触发器[隐状态(latent rollout states)]”,更具灵活性。Retrieval timing 从“if-else”进化成了可训练的隐变量

自动化检索意图Automated Retrieval Intent:在分层或异构的记忆库中(如有的存事实,有的存经验),自主决定访问哪个记忆源。

示例:

AgentRR:根据反馈在“模板 vs 经验”间切换,但依赖显式环境反馈 → 不适合开放推理

MemOS:能根据情境动态选择不同类型的记忆(参数化记忆、激活记忆、文本记忆)。

高级方法:

H-MEM引入分层路由机制,进行从粗到细的检索(例如,先从“领域层”筛选,再到“事件层”),逐步缩小搜索范围,提高精度。Domain → Episode → Sub-memory

作用

缩小搜索空间

减少信息过载

更符合人类“先想大概,再回忆细节”的方式

备注

核心不是“全自动”,而是受控的自治

本小节总结与风险提示¶

自主化的时机和意图能提升效率,但也带来了潜在风险:如果智能体过度自信,认为不需要检索而实际上其内部知识不足,就会导致**“静默失败”,产生幻觉输出。因此,关键在于平衡**:在需要时提供关键信息,同时避免过度检索引入噪音。

5.3.2 查询构造¶

本小节核心:解决 “用什么去检索?” 的问题。原始用户查询与记忆库的索引方式通常存在语义鸿沟。查询构造就是弥合这一鸿沟的“翻译层”。

关键策略解析¶

查询分解Query Decomposition:将复杂查询拆解为多个简单子查询,并行检索后再整合答案。

适合:复杂、多跳、组合型问题

机制:把一个大问题拆成多个子查询,分别检索,再组合

好处:缓解一次性检索的瓶颈,实现更细粒度的信息获取。

演进:

从简单的分解(Visconde),到有全局规划的分解(PRIME),再到更具针对性的分解(Agent KB通过观察学生模型的失败来生成子查询)。

PRIME / MA-RAG:引入 Planner Agent,先规划,再拆解

Agent KB:不是按问题拆,而是按“模型缺什么知识”来拆,通过 teacher–student 失败观察生成子查询

查询重写:不分解,而是改写原始查询或生成一个假设性文档,使其语义更贴近记忆库的索引方式。

适合:用户表达模糊,记忆是抽象的、结构化的

经典方法:

HyDE让大模型生成一个“假设的理想答案文档”,然后用这个文档的语义去检索。

结合记忆:

MemoRAG在重写时参考了全局记忆摘要,使生成的查询更能捕捉用户的隐含意图。

其他技术:训练专门的小型重写模型(Rewrite-Retrieve-Read),或使用澄清树(ToC)来渐进式明确检索目标。

研究重点正在从“设计更复杂的记忆结构”转向“设计更好的检索 query”

本小节总结¶

分解和重写并非互斥,可以结合使用(如Auto-RAG)。研究表明,查询构造的质量对最终推理性能影响巨大。近期研究重点已从设计复杂的记忆架构,转向如何更好地“为检索服务”。

5.3.3 检索策略¶

本小节核心:解决 “如何执行检索?” 的问题。在明确了检索目标(经过构造的查询)后,需要用具体算法从记忆库中找出相关内容。

四大主流策略解析¶

词法检索Lexical Retrieval

原理:基于关键词匹配(如TF-IDF, BM25)。

特点:快速、可解释,在精确匹配的场景下效果好。

局限:无法理解语义,对表述差异敏感。

适合:工具名,API,精确术语

语义检索Semantic Retrieval

原理:将查询和记忆片段都编码成语义向量,在向量空间中计算相似度(如使用Sentence-BERT, CLIP)。

特点:能理解语义,支持模糊匹配和泛化,是目前的主流方法。

局限:可能存在语义漂移,返回的Top-K结果可能包含噪音。

图检索Graph Retrieval

原理:在图结构(如知识图谱)上进行检索,利用节点间的显式关系进行多跳推理和结构化搜索。

方法:

节点扩展:先找到相关节点,再扩展到其邻居(如AriGraph)。

图排序算法:使用个性化PageRank等在图上进行重要性传播(如HippoRAG)。

LLM引导探索:用大语言模型指导在图上的搜索路径(如CAM, D-SMART)。

特点:推理能力强,尤其适合需要关系推理或受明确规则(如时间、逻辑)约束的任务。

优势:天然支持多跳,支持约束推理,不只是“相似”,而是“可达”

生成式检索Generative Retrieval

原理:不搜索,而是让模型直接生成相关文档的标识符或内容本身。

直接生成文档 ID

检索 = 生成

特点:检索与生成深度耦合,在小规模数据集上潜力大。

局限:需要专门训练,可扩展性差,记忆库更新成本高,目前在智能体系统中应用较少。

混合检索Hybrid Retrieval:综合上述多种策略,取长补短。

常见组合:词法 + 语义(兼顾精确与泛化)、语义 + 图(先用语义找节点,再用图结构扩展)。

融合方式:多因子打分(新近性 / 重要性 / 相关性),并行搜索后合并结果,或设计混合评分函数(同时考虑语义相似度、时效性、重要性等)。

5.3.4 检索后处理¶

本小节核心:解决 “检索到的原始结果怎么用?” 的问题。初始检索结果通常是冗余、有噪音、过长或不连贯的。直接塞给大模型会干扰推理。此步骤旨在精炼检索结果,形成高质量的上下文。

两个核心处理环节¶

重排序与过滤Re-ranking and Filtering

目的:降噪、去重、保证一致性,剔除不相关、过时或低质量的记忆片段,并对剩余结果按重要性重新排序。

方法:

启发式规则:结合多种信号(如语义相似度、角色相关性、时效性)进行打分排序。

学习式方法:用强化学习让模型学会如何最优地聚合不同信号(

learn-to-memorize)。基于LLM的评估器:直接让大语言模型评估检索片段的质量和相关性(如Memory-R1)。

训练辅助模型:专门训练一个小模型来预测某个记忆片段对最终答案的贡献度(如

Memento)。

聚合与压缩

目的:将多个相关的记忆片段融合、去重、总结,形成一个简洁、连贯、高层的知识表示。

与过滤的区别:过滤是“做减法”,聚合压缩是“做整合与提炼”。

示例:

ComoRAG:将语义对齐的历史信号整合成一个全局摘要。MA-RAG:为当前子查询提取最关键的信息,生成精炼的片段。G-Memory:在多智能体个性化场景中,将检索到的经验压缩并定制成符合特定智能体角色的提示。

本小节总结¶

检索后处理是连接“原始检索结果”与“高质量推理上下文”的关键桥梁。它通过上述机制,不仅提升了输入信息的信息密度和保真度,还确保其与任务需求和智能体特性对齐。

本节全局总结¶

第5.3节系统性地阐述了记忆检索的完整技术栈。它强调,一个强大的智能体系统并非简单地“搜索-回答”,而是通过一个协同工作的流程(时机判断 → 意图明确 → 查询优化 → 策略执行 → 结果精炼),动态地、有选择性地激活相关知识,从而逼近人类的高效联想记忆能力。这体现了智能体研究从静态工具调用到动态认知过程的重要演进。

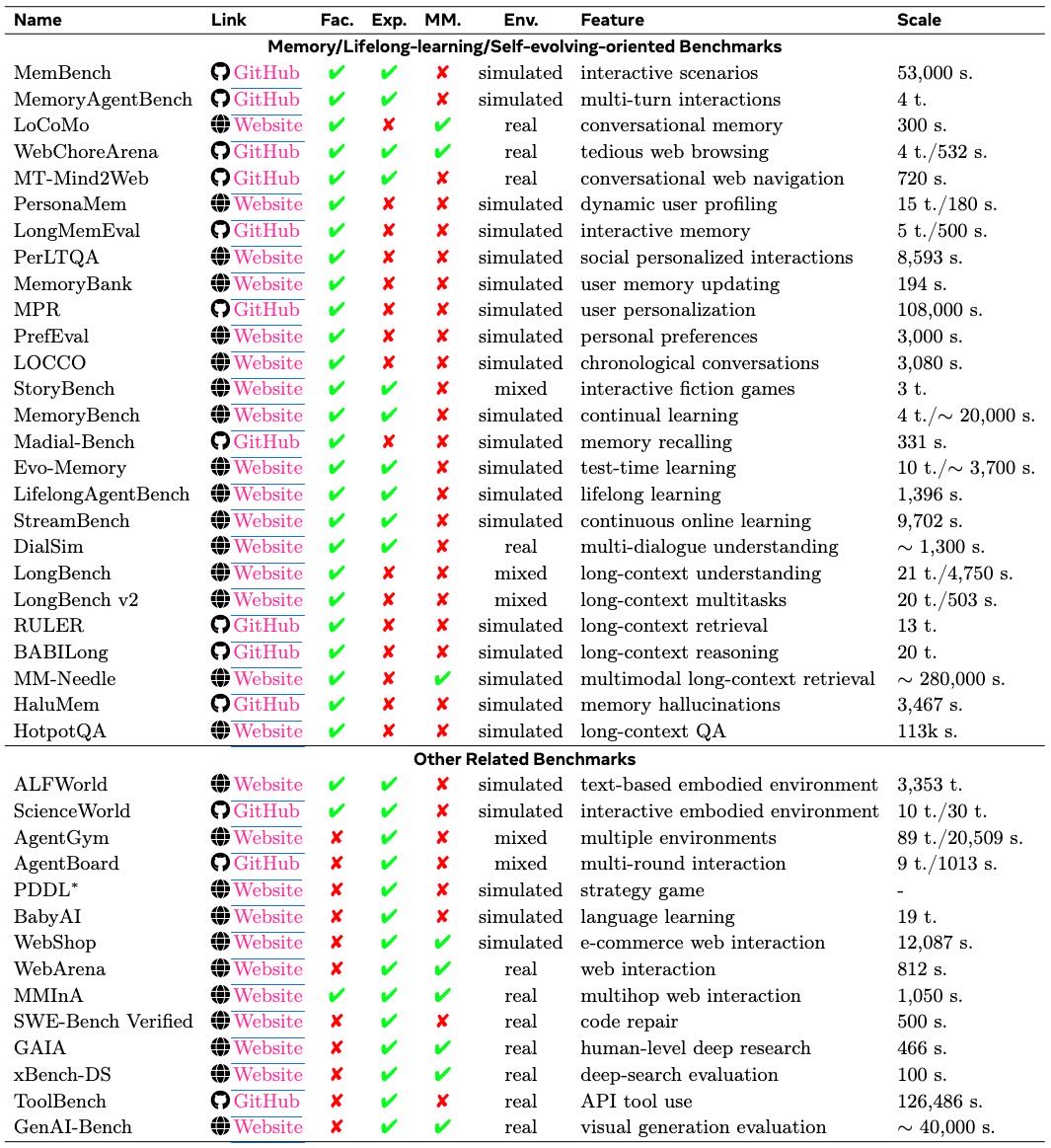

6. Resources and Frameworks¶

章节概述:本章节旨在为研究者和开发者提供构建和评估具备记忆能力的LLM智能体所需的工具和数据,主要分为评测基准和开源框架两部分。

6.1 Benchmarks and Datasets¶

概述: 本节综述了用于评估LLM智能体在记忆、长期学习、持续学习和长上下文处理能力方面的代表性测试基准和数据集。

作者将其分为两大类:

专为记忆/终身学习/自我进化智能体设计的基准

为其他目的设计(如工具使用、网页搜索、具身交互)但因其长跨度、多任务或顺序性而与记忆评估相关的基准

Table 8 Overview of benchmarks relevant to LLM agent memory, long-term, lifelong learning, and self-evolving evaluation.

6.1.1 Benchmarks for Memory / Lifelong / Self-Evolving Agents¶

本部分介绍那些专门为评估智能体的记忆相关能力而设计的基准。

主要考察的是:

Agent 是否能 构建记忆

是否能 维护记忆

是否能 在后续任务中正确使用记忆

记忆往往来自:

多轮对话

用户级会话

长叙事文本

有时还包含多模态信号

记忆导向型基准Memory-oriented benchmarks:

焦点: 测试智能体在多轮对话、用户特定会话或长叙事中保持和检索信息的能力。

典型能力: 用户建模、偏好跟踪、对话级一致性。

代表例子: MemBench, LoCoMo, PersonaMem 等(详见表8第一大部分)。

环境: 多为模拟环境,以便精确控制“真实记忆”用于评估。

终身学习基准Lifelong-learning benchmarks:

焦点: 超越简单的记忆检索,考察智能体在长期、任务分布动态变化的过程中,如何持续获取、巩固和更新知识。

核心挑战: 灾难性遗忘(catastrophic forgetting)、前向/后向迁移、测试时适应(test-time adaptation)

评估方式: 不仅评估当前任务,还会回顾之前学过的任务,以量化智能体在适应新内容时保留有用知识的能力。

代表例子: LongMemEval, MemoryBank, StreamBench 等。

自我进化智能体基准Self-evolving-agent benchmarks:

焦点: 将智能体视为一个开放式系统,评估其能否通过交互迭代地完善自身的记忆、技能和策略。

高级行为: 自我反思、记忆编辑、工具增强存储、跨多轮次优化策略。

目标: 测试智能体能否自主学习并提升能力,将静态任务转化为长期适应和策略优化的舞台。

代表例子: MemoryAgentBench, Evo-Memory 等。

核心要点总结¶

分类清晰:论文将记忆相关基准明确分为**“专门设计”和“隐式相关”**两大类,有助于研究者根据评估目标选择合适的工具。

评估维度全面:在专门设计的基准中,又细分为记忆、终身学习、自我进化三个由浅入深的层次,对应不同的能力要求。

强调实践关联:专门指出许多“非记忆”基准(如网页操作、代码修复)实际上是更贴近实际应用的“记忆压力测试”,凸显了记忆能力在复杂智能体应用中的基础性和必要性。

提供实用工具:Table 8 作为一个速查表,是本章最核心的实用资源,让读者能快速对比数十个基准的关键特性。

6.2 Open-Source Frameworks¶

概述: 这是一个快速发展的生态系统,旨在为构建具有记忆增强能力的LLM智能体提供可复用的基础设施。

框架类型谱系:

智能体中心型系统:提供丰富的、分层的记忆抽象(如 MemGPT, 其结构类似人类的短/长时记忆)。

通用检索/记忆即服务后端:主要提供可扩展的向量或图谱数据库、API(如 Pinecone, Chroma),将智能体行为留给应用层实现。

发展趋势:

大多数框架通过向量或结构化存储支持事实性记忆。

越来越多的框架开始建模经验性痕迹(对话历史、用户行为)。

多模态记忆支持是新兴方向。

整体上,这些框架在表征灵活性和系统设计上正迅速成熟。

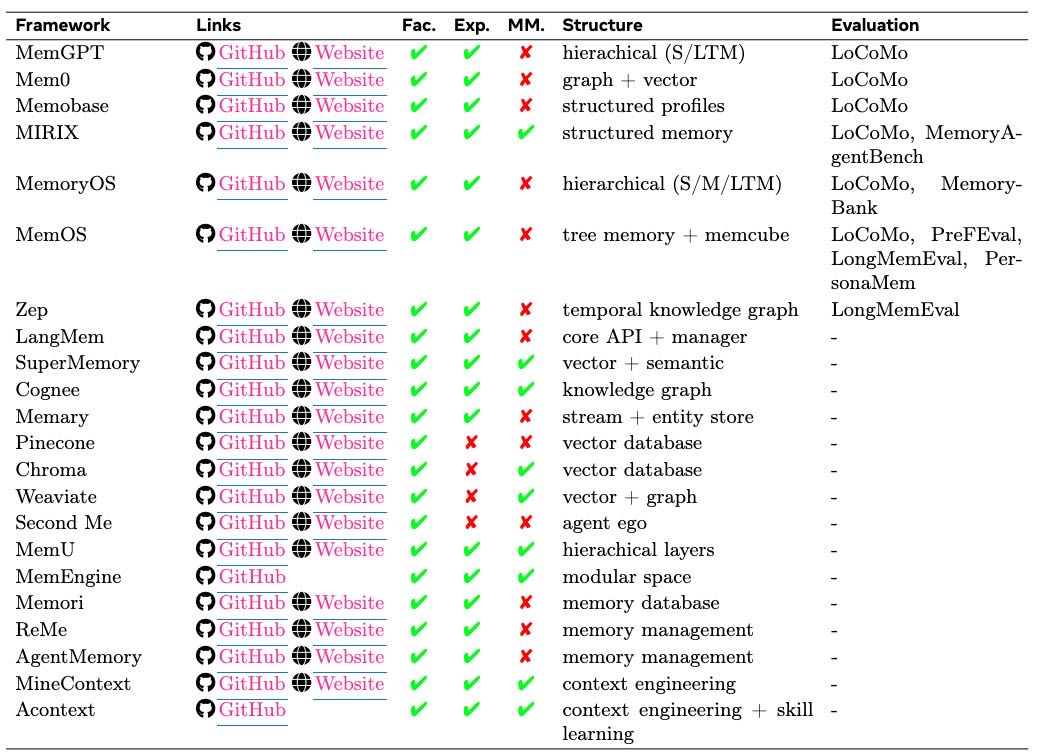

Table 9 Overview of representative open-source memory frameworks for LLM-based agents

7. Positions and Frontiers¶

本章节阐述了为基于大语言模型的智能体设计记忆系统的关键观点和新兴前沿。研究不再局限于对现有方法的描述性综述,而是聚焦于范式层面的转变。这些转变将重新定义在长期、复杂的智能体环境中,记忆是如何被构建、管理和优化的。

具体来说,本文将审视以下几个关键转变:

从以检索为中心到以生成为中心的记忆模式。

从人工设计到自主管理的记忆系统。

从启发式流水线到强化学习驱动的记忆控制。

本章节还将探讨这些转变如何与**多模态推理、多智能体协作及系统可信性(trustworthiness)**等领域交叉,并勾勒出可能塑造下一代智能体记忆架构的开放挑战与研究方向。

风向标

生成式记忆 > 检索式记忆

不再“查什么用什么”,而是“缺什么生什么”。

自动记忆管理

把“写/删/改”做成 Agent 可调用的 Tool,让 LLM 自己管自己。

RL 全面接管记忆策略

从“人工拍阈值”到“策略网络端到端优化”。

多模态记忆

视频、音频、传感器流统一进 Embedding 空间。

多 Agent 共享记忆

角色-权限-隐私三权分立,防止“集体幻觉”。

世界模型记忆

从“缓存帧”到“可查询状态模拟器”。

可信记忆

差分隐私、可验证遗忘、审计日志、用户级 GDPR 擦除。

小结¶

一、自动化记忆管理

核心轨迹:从人工设计 → 自主管理。

现状: 依赖人工规则(指令/阈值),虽简单可控但僵化,难适应开放环境。

未来: 记忆操作将融入智能体决策循环,通过工具调用自主管理;发展自优化、层次化、自演化的记忆结构,实现真正的自主。

二、强化学习驱动的记忆

核心轨迹:从启发式流水线 → 模型原生端到端学习。

现状: 历经 “无RL” -> “RL辅助” 阶段,RL开始优化记忆的特定环节(如检索重排)。

未来: 迈向 “完全RL驱动” 。目标是:1) 最小化对人类先验知识的依赖,让智能体自我发明记忆架构;2) 实现记忆全流程的端到端自主控制,使记忆成为与智能体共同进化的可学习子系统。

三、多模态记忆

核心轨迹:从纯文本 → 全模态统一。

现状: 随多模态大模型兴起。当前研究分为两支:1) 服务多模态智能体(视觉记忆为主);2) 增强多模态生成一致性。

未来: 成为具身智能体的必备组件。关键挑战是设计统一的全模态记忆系统,能支持跨模态抽象、推理与长期适应。

四、多智能体共享记忆

核心轨迹:从孤立通信 → 主动管理的集体认知基板。

现状: 从独立记忆+消息传递,发展到中心化共享记忆(如黑板系统),提升了团队协调能力,但也带来了混乱与冲突问题。

未来: 将发展为主动、自适应的集体表征。方向包括:智能体感知(基于角色/信任的访问)、学习驱动的贡献管理,并需支持多模态抽象,最终成为集体智能的基石。

五、世界模型的记忆

核心轨迹:从数据缓存 → 状态模拟。

现状: 记忆是世界模型实现长期一致性与交互模拟的基石。技术已从简单缓冲演进为结构化状态表示(如SSMs、显式记忆库)。

未来: 架构发生根本转变。两种核心范式是:1) 双系统架构(快/慢系统分工);2) 主动记忆管理(将记忆作为可主动维护和查询的“认知工作空间”)。

六、可信记忆

核心轨迹:从功能优先 → 可信为首要原则。

现状: 随着记忆存储敏感信息,隐私、安全、可解释性问题凸显,成为现实部署的瓶颈。

未来: 必须围绕三大支柱构建:1) 隐私保护(细粒度控制、加密、遗忘);2) 可解释性(可追溯、可审计);3) 抗幻觉鲁棒性(冲突检测、不确定性感知)。目标是建立类似操作系统的、可共同治理的可信记忆系统。

七、人类-认知连接

核心轨迹:从工程模拟 → 仿生内化。

现状: 在结构上已成功模拟了人类记忆的多存储与分类模型,但在动态过程上存在本质差异:AI是“精确检索”,人类是“建构性重建”。

未来: 关键突破在于引入离线巩固机制(类似睡眠)。通过记忆重组、生成性回放、主动遗忘,使智能体从“数据归档者”进化为“经验内化者”,解决稳定性-可塑性困境,实现生成性记忆重建。

演进总览与核心范式转移 这七大方向并非孤立,它们共同描绘了一条清晰的演进路径,体现了三个根本性的范式转移:

从“外部模块”到“内生能力”: 记忆不再是一个外挂的、手工设计的数据库,而是通过自动化、强化学习内化为智能体原生、可学习、可优化的核心认知能力。

从“简单存储”到“复杂认知”: 记忆的功能从被动、静态的存储和检索,升级为主动、动态的模拟、重建、协作和推理(如世界模型、共享记忆、仿生重建)。

从“封闭实验”到“开放部署”: 研究焦点从追求单一性能,转向应对真实世界的复杂性,包括处理多模态信息、保障多智能体协作、以及满足实际应用必需的可信赖性要求。

最终愿景是构建一个自主、协作、可信、多模态、具备持续学习与进化能力的智能体记忆系统,使其成为强人工智能真正意义上的“认知核心”。

7.1 Memory Retrieval vs. Memory Generation¶

7.1.1 Look Back: From Memory Retrieval to Memory Generation¶

传统范式:记忆检索

核心思想:研究的核心目标是从一个已存在的记忆库中,根据当前情境去识别、筛选和选择最相关的记忆条目。

技术重点:

大量研究致力于通过改进索引策略、相似度度量、重排序模型或**结构化存储(如知识图谱)**来提高检索的准确性。

具体技术包括:

向量检索(dense embedding)

结合词汇与语义信号的混合检索

分层过滤

基于图的遍历等

核心假设:这些方法强调访问存储信息的精确性和召回率,其隐含前提是记忆库本身已经是结构良好、准备就绪的。

新兴范式:记忆生成

核心思想:

记忆不再被视为静态的、供查询的知识库。而是强调智能体主动、按需合成新的记忆表征的能力。

关键变化在于目标不同::

Retrieval: 找到并拼接已有片段

Generation: 为“当前 + 未来用途”重新构造一个更合适的记忆,对信息进行整合、压缩和重组。

驱动原因:

这一转变源于一个共识:有效的记忆使用常常需要抽象与再组合,尤其是当原始存储的信息存在噪声、冗余或与当前任务不匹配时。

不是“记忆不够多”,而是“记忆形态不对”。

现有生成方法分类:

Retrieve-then-Generate(先取再生成):

流程:

先检索相关记忆

然后重写成一个更精炼、连贯、贴合情境的记忆表征。

例子:ComoRAG, G-Memory, CoMEM。

优点:保持了基于历史信息的根基,同时允许进行自适应总结和重构。

“直接生成”策略:

流程:

跳过显式的检索步骤

直接从当前上下文、交互历史或内部潜在状态生成记忆token。

例子:MemGen, VisMem。

特点:通过构建为当前任务定制的潜在记忆标记,完全绕过显式的记忆查找。

7.1.2 Future Perspective¶

展望未来,生成式方法将在智能体记忆系统中扮演日益核心的角色。我们认为未来的生成式记忆机制应具备以下三个理想特性:

Context Adaptive(上下文自适应)

要求:记忆系统不应存储通用摘要,而应生成为智能体预期的未来需求明确优化的token。

体现:这包括根据不同的任务、问题解决阶段或交互模式,自适应地调整记忆的粒度、抽象层次和语义焦点。

未来的生成式记忆

不应该

通用摘要

一次生成,永久存储

应该

面向未来使用场景优化

动态调整:粒度,抽象层级,语义焦点

Integration Across Heterogeneous Signals(异构信号整合)

要求:

智能体处理的信息越来越多元化(文本、代码、工具输出、环境反馈等)。

记忆生成为融合这些碎片化信号提供了天然的机制,能生成比单纯拼接或检索更有助于下游推理的统一表征。

技术路径:潜在记忆可能是实现这一目标的有前途的技术路径。

Learned and Self-Optimizing(可学习 & 自优化)

要求:

未来的系统不应依赖手动指定的生成规则,而应通过优化信号来学习何时以及如何生成记忆。

实现方式:例如,通过强化学习或长期任务表现作为学习信号。

愿景:在这种视角下,记忆生成将成为智能体策略的有机组成部分,与推理和决策过程共同进化。

总结核心概念解析:

检索中心 vs. 生成中心:可以类比为在图书馆查找资料(检索) 与根据问题写一篇综述报告(生成) 的区别。后者是更高级、更具创造性的信息处理。

潜在记忆:指一种不直接对应具体文本、而是经过高度抽象和压缩的、存在于模型内部的记忆表示,更具灵活性和适应性。

范式转变:这不仅是技术升级,更是对“记忆”这一概念的根本性重新思考——从静态数据库转向动态构建与优化的认知过程。

7.2 Automated Memory Management¶

7.2.1 Look-Back: From Hand-crafted to Automatically Constructed Memory Systems.¶

核心内容: 本部分描述了智能体记忆系统的发展现状和问题。

关键点解析:

现状(手工设计): 当前大多数系统依赖人工策略,如详细指令、预设阈值或专家规则。优点是成本低、可解释、可控,适合快速原型开发。

局限性: 这类系统像“专家系统”,僵化且泛化能力差,难以适应动态、开放的环境,在长期任务中表现不佳。

近期进展: 研究开始让智能体自主管理记忆(如自动聚类记忆、引入“记忆管理器”工具)。但仍有局限:许多仍基于手工规则,或仅为特定任务优化,泛化能力依然不足。

7.2.2 Future Perspective¶

核心内容: 提出了实现真正自动化记忆管理的两个关键方向。

关键点解析:

将记忆管理融入决策循环: 理想的方向是让智能体通过显式的工具调用,在推理过程中自主决定记忆的增、删、改、查。这比将记忆管理与内部推理分离的传统设计更连贯、透明和贴合上下文。

发展自优化的记忆结构: 受认知系统启发,构建层次化、自适应的记忆架构。

层次化结构已被证明能提升效率。

自演化系统能让记忆条目动态链接、索引和重组,实现自我组织,减少对人工规则的依赖。

终极目标: 实现健壮、可扩展、真正自主的记忆管理。

7.3 Reinforcement Learning Meets Agent Memory¶

7.3.1 Look-Back: RL is Internalizing Memory Management Abilities for Agents.¶

核心内容: 阐述了强化学习如何逐步成为记忆系统演进的驱动力,其发展可分为三个阶段(如图11所示)。

关键点解析:

总体趋势: 记忆系统正从 “基于流水线”向“模型原生” 范式转变,强化学习在其中扮演的角色越来越核心。

三个阶段:

无强化学习系统: 早期主流方法。依赖启发式或手工机制(固定阈值、语义搜索流水线、简单拼接),或仅靠提示词驱动LLM生成记忆。简单易用,但能力有限。

强化学习辅助系统: 在记忆流程的特定环节引入强化学习。例如,用强化学习训练的策略对检索结果进行重排,或将部分记忆构建过程交由强化学习训练的智能体负责。这已展现出强大能力,代表了当前的前沿方向。

7.3.2 Future Perspective¶

核心内容: 展望了完全由强化学习驱动的记忆系统应具备的两个理想特性。

关键点解析:

最小化对人类先验知识的依赖: 现有系统常借鉴人类认知结构(如海马体、分层分类)。未来系统应通过强化学习,让智能体从优化动态中自主发明可能更高效、更适合AI的全新记忆组织形式。

赋予智能体对记忆管理全流程的完全控制: 当前强化学习辅助系统只干预部分环节(如只负责“写”或只管理“工作记忆”)。未来系统需要智能体以集成、端到端的方式,自主处理多粒度记忆的形成、演化和检索。这必须依赖端到端的强化学习训练才能实现。

愿景: 记忆将不再是附加在智能体上的模块,而是通过强化学习与智能体共同进化的、可学习、自组织的子系统,从而实现真正的持续学习和长期能力。

7.4 Multimodal Memory¶

7.4.1 Look-Back¶

核心内容: 介绍了多模态记忆兴起的背景和现有的两个研究方向。

关键点解析:

兴起原因: 文本记忆研究成熟 + 多模态大模型进步 + 现实世界任务本质上是多模态的。

现有方向:

面向多模态智能体: 让智能体能存储和利用来自图像、音频、视频等不同感官输入的记忆。视觉记忆研究最多,音频等其他模态探索较少。

面向统一模型: 将记忆作为增强多模态生成一致性和连贯性的组件(如在图像/视频生成中保持实体一致性),而非主要服务于智能体决策。

7.4.2 Future Perspective¶

核心内容: 指出了多模态记忆未来发展的必要性和关键挑战。

关键点解析:

必要性: 对于走向具身和交互的智能体,多模态记忆不可或缺。

关键挑战:

实现真正的全模态支持: 现有系统多为单模态专用或松耦合,缺乏能统一灵活处理所有模态的记忆系统。

超越被动存储: 未来的多模态记忆需要支持抽象、跨模态推理和长期适应。

目标: 使智能体能在丰富、多模态的环境中稳健、连贯地运行。

7.6 Memory for World Model¶

7.6.1 回顾¶

核心目标:世界模型旨在构建一个能高保真模拟物理环境的内部系统。其核心是生成无限可扩展且能实时交互的内容。

记忆的作用:在世界模型的迭代生成(接收动作 → 预测下一状态)框架中,记忆是基石。它存储空间、语义信息和隐藏状态,确保生成的视频在场景布局、物体属性、运动逻辑上保持长期一致性。

技术演进:

早期(简单缓存):

帧采样Frame Sampling:依赖少量历史帧,导致上下文碎片化和感知漂移。

滑动窗口Sliding Window / KV cache:借鉴LLM技术,但受限于固定窗口长度,会“遗忘”窗口外的物体。

失败案例:物体离开视野 → 世界模型“当它不存在了”

当前(结构化状态表示,2025年):

状态空间模型(State-Space Models, SSMs):

如Mamba架构,将无限历史压缩为固定大小的递归状态,理论上具备无限记忆容量。

显式记忆库:维护历史表征的外部存储。

分层设计(如UniWM):通过特征相似性门控分离短期感知和长期历史。

基于检索的方法(如WorldMem):维护平坦的历史上下文库,利用几何检索(如视场重叠)动态选择相关帧以保持3D场景一致性。

稀疏记忆与检索:在长期一致性和效率间取得平衡,通过稀疏采样或检索历史帧来锚定预测,防止操作任务中的漂移。

7.6.2 未来展望¶

架构性转变:从专注于被动保留的数据缓存,转向专注于主动维护的状态模拟。

两大新兴范式:

双系统架构:受认知科学启发,分为:

系统1(快速、本能):

快、直觉、物理一致性(SSM)

使用SSM等高效骨干处理即时物理和流畅交互。

系统2(缓慢、深思熟虑):

慢、推理、规划、全局一致性(VLM / 显式记忆)

使用大规模视觉语言模型或显式记忆数据库处理复杂推理、规划和世界一致性。

主动记忆管理Active Memory Management:

记忆不再是盲目存储最近历史的固定缓冲区,而是一个认知工作空间,能根据任务相关性主动策划、总结和丢弃信息。

这标志着从“记住最后N个标记”到“维护一个连贯、可查询的世界状态”的转变。

目标:维护一个可查询、可推理、长期一致的世界状态。

7.7 Trustworthy Memory¶

7.7.1 回顾:从可信RAG到可信记忆¶

核心关切:随着记忆系统更深地嵌入智能体,可信度问题变得至关重要。其挑战比RAG(检索增强生成)更广,因为智能体记忆存储的是用户特定、持久、可能敏感的内容。

主要挑战:

隐私:记忆模块可能通过间接提示攻击泄露私人数据(如Wang et al., 2025b)。

安全与控制:需要明确的访问控制、可验证遗忘、可审计更新机制(如Wu et al., 2025g)。

可解释性:用户难以追溯哪些记忆被检索、如何影响生成、是否被误用。

集体隐私:在共享或联邦记忆系统中,多个智能体或组织间的隐私问题(如Shi et al., 2025d)。

7.7.2 未来展望¶

三大支柱:未来可信记忆系统应围绕隐私保护、可解释性、幻觉鲁棒性构建。

隐私保护Privacy:

需支持细粒度权限记忆、用户管理的保留策略、加密或设备端存储、联邦访问。

技术包括差分隐私、记忆编辑、自适应遗忘。

可解释性Explainability:

需要可追踪的访问路径、自我解释的检索,以及可视化工具(如记忆注意力图、因果影响图)。

幻觉鲁棒性Hallucination Robustness:

策略包括低置信度检索时放弃生成、回退到模型先验、多智能体交叉验证。此外,机制可解释性技术可以分析幻觉的内部成因,提供干预工具。

长期愿景:记忆系统应像操作系统一样被管理:分段、版本控制、可审计、由智能体和用户共同管理。

7.8 Human-Cognitive Connections¶

7.8.1 回顾¶

结构相似性:当前智能体记忆架构与人类认知模型高度吻合。

工作记忆与长时记忆:有限的上下文窗口 + 外部向量数据库 ≈ 人类的工作记忆 + 长时记忆模型(Atkinson-Shiffrin模型)。

记忆分类:智能体的交互日志、世界知识、代码技能 ≈ 人类的情景记忆、语义记忆、程序性记忆(Tulving分类)。

根本差异:在于检索与维护的动态过程。

人类:记忆是建构性的,基于当前状态主动重构过去。

当前智能体:记忆是不变的,依赖逐字检索(如RAG),缺乏动态重塑、抽象和“扭曲”历史的能力。

7.8.2 未来展望¶

核心进化方向:超越静态存储,迈向动态认知。

关键机制:引入类似生物睡眠的离线巩固机制。

理论依据:借鉴互补学习系统理论。

运作方式:智能体定期脱离环境交互,进入“离线”状态,进行记忆重组和生成式回放。在此过程中,它们可以:

从原始情景痕迹中提炼可泛化的图式。

执行主动遗忘,修剪冗余噪声。

优化内部索引,不受实时处理延迟限制。

最终范式转变:从显式文本检索到生成式重构。

未来的“生成式记忆”能按需合成潜在记忆标记,从而将经验内化,通过周期性巩固解决稳定性-可塑性困境,使智能体从“数据存档实体”进化为“内化经验的实体”。

总结¶

这份论文节选清晰地勾勒了智能体记忆系统的7个关键演进方向:

自动化: 从外部手工设计走向内部自主管理。

强化学习驱动: 从启发式流水线走向端到端学习与自我优化的“模型原生”范式。

多模态化: 从纯文本走向统一处理并理解多种感官信息的记忆系统。

共享记忆 关注多智能体协作中的知识共享与集体智能形成。

世界模型记忆 关注在模拟物理世界时维持长期一致性的底层架构创新。

可信记忆 关注在实际部署中必须解决的隐私、安全、可靠等伦理与工程挑战。

人类认知连接 则从仿生学角度,为记忆系统的未来进化提供了根本性的灵感来源和理论框架。

共同勾勒出一个宏伟蓝图:未来的智能体记忆将是一个自主、协作、可信、多模态、能与环境深度交互并持续学习进化的复杂认知子系统。

总结:这四个小节系统性地阐述了智能体记忆系统的前沿进展与未来方向,涵盖了从多智能体协作、世界模拟、系统可信度到借鉴人类认知机制的多个维度,核心脉络是记忆正从被动、静态、孤立的存储,向主动、动态、协作、可信的认知基础演进。

8. Conclusion¶

本综述将 智能体记忆(agent memory) 作为现代基于大语言模型(LLM)的智能体系统中的一个基础性组成部分进行了系统考察。通过从 形式(forms)、功能(functions) 和 动态(dynamics) 这三个统一视角对现有研究进行梳理,我们澄清了智能体记忆的整体概念版图,并将其置于智能体智能演进这一更宏观的背景之中。

在形式层面,我们识别出三种主要的实现方式:token 级记忆、参数化记忆以及潜在记忆。近年来,这三种形式均经历了各自快速而显著的发展,体现了在表示能力、适应性以及与智能体策略整合程度方面截然不同的权衡取舍。

在功能层面,我们突破了以往综述中常见的“长期记忆与短期记忆”这一粗粒度二分法,提出了一种更加细致且覆盖面更广的分类体系。该体系依据记忆在知识保持、能力积累以及任务级推理中的作用,将记忆区分为 事实性记忆、经验性记忆和工作记忆。

综合上述视角可以看出,记忆并非仅仅是一个辅助性的存储机制,而是智能体实现时间一致性、持续适应能力以及长时程任务能力的关键基础载体。

在对既有研究进行系统整理之外,我们还识别出了一系列关键挑战与新兴方向,指向智能体记忆研究的下一阶段。尤其值得注意的是:强化学习的日益深入融合、多模态与多智能体场景的兴起,以及记忆范式从以检索为中心向以生成式为中心的转变,共同预示着未来的记忆系统将趋向于完全可学习、自适应且自组织。

这类系统有望将大语言模型从强大但静态的生成器,转变为能够进行持续交互、自我改进,并在时间维度上进行有原则推理的智能体。

我们希望本综述能够为未来研究提供一个连贯的基础,并同时作为研究人员与实践者的参考资料。随着智能体系统的不断成熟,记忆的设计仍将是一个核心且开放的问题,并极有可能在构建鲁棒、通用且具备长期生命力的人工智能过程中发挥决定性作用。