2002.02126_LightGCN: Simplifying and Powering Graph Convolution Network for Recommendation¶

引用: 5002(2025-09-13)

组织:

University of Science and Technology of China

National University of Singapore

Beijing Kuaishou Technology

Hefei University of Technology

GitHub:

TensorFlow: https://github.com/kuandeng/LightGCN

总结¶

LightGCN: Light Graph Convolutional Network

背景

GCN 中两个常见的设计 —— 特征变换(feature transformation)和非线性激活(nonlinear activation)—— 对推荐性能贡献甚微,甚至会增加训练难度并降低推荐效果。

LightGCN

去除了不必要的复杂结构,仅保留最核心的“邻居聚合”(neighborhood aggregation)操作

核心思想:

通过在用户-物品交互图上线性传播嵌入(embedding),学习用户和物品的表示,最终使用所有层嵌入的加权和作为最终的嵌入表示。

与传统的GCN模型(如NGCF)相比,LightGCN简化了结构,去除了复杂的特征变换和非线性激活函数,仅保留最核心的邻居信息聚合操作。

与其他研究的对比

相比 RGCF: 走得更远,它移除了所有冗余参数,只保留了最核心的ID嵌入

消融实验

构造了三个简化版本的 NGCF:

NGCF-f:去掉特征变换矩阵 \( W_1, W_2 \)

NGCF-n:去掉非线性激活函数 \( \sigma \)

NGCF-fn:同时去掉特征变换和非线性激活

实验结果

NGCF-f 性能优于标准 NGCF,表明特征变换对推荐任务有负面影响。

NGCF-fn 性能提升最大,说明非线性激活和特征变换对模型的负面影响是显著的。

NGCF-n 的性能与 NGCF 几乎相同,说明非线性激活在有特征变换的情况下影响较小。

结论:

特征变换对 NGCF 有负面影响,移除后模型性能显著提升;

非线性激活在有特征变换时影响较小,但在无特征变换时也有负面影响;

同时移除非线性激活和特征变换(NGCF-fn)效果最好,相对改善约为 9.57%。

Abstract¶

本文主要探讨了图卷积网络(Graph Convolutional Network, GCN)在协同过滤推荐中的有效性及其设计的合理性。目前,GCN 已成为推荐系统领域的前沿方法之一,但其为何在推荐任务中有效仍缺乏深入分析。

作者指出,现有的工作虽然将 GCN 应用于推荐,但缺乏对其原始设计(主要用于图分类任务)中各组件的细致消融分析。通过实验,作者发现 GCN 中两个常见的设计 —— 特征变换(feature transformation)和非线性激活(nonlinear activation)—— 对推荐性能贡献甚微,甚至会增加训练难度并降低推荐效果。

因此,本文提出一种简化设计的 GCN 模型,命名为 LightGCN。LightGCN 去除了不必要的复杂结构,仅保留最核心的“邻居聚合”(neighborhood aggregation)操作。其核心思想是:通过在用户-物品交互图上线性传播嵌入(embedding),学习用户和物品的表示,最终使用所有层嵌入的加权和作为最终的嵌入表示。

LightGCN 模型结构简单、线性、易于实现与训练,在相同实验设置下,其性能相对于当前最先进的 GCN 模型 NGCF 有显著提升(平均相对提升约 16.0%)。此外,作者从理论和实证两个角度分析了 LightGCN 的合理性。

1. Introduction¶

1. 研究背景与核心问题¶

问题:互联网信息过载,需要推荐系统来进行个性化信息过滤。

核心任务:推荐系统的核心是协同过滤(CF),即通过分析用户和物品过去的历史交互数据(如点击、购买)来预测用户未来的行为。

主流方法:为每个用户和物品学习一个嵌入向量(Embedding) 来表示其特征,然后基于这些向量进行预测。

方法演进:

早期:矩阵分解(MF)直接根据用户ID生成嵌入向量。

改进:研究发现,除了ID,把用户的交互历史(她点击过哪些物品) 也作为输入,能学到更好的向量。这可以看作在用户-物品交互图中,利用了用户的一跳邻居信息。

研究

SVD++:展示了融入用户历史行为可以有效提升评分预测的准确性。

NAIS:进一步引入了注意力机制,认为历史物品的重要性并不相同,从而提升了排序(Ranking)的精度。从图视角看,它们利用了用户的一跳邻居信息。

总结说明:这些模型是对基础矩阵分解的重要改进。它们不再只使用用户ID,而是将用户的交互历史(她评分过或点击过的物品)也作为输入信息。

2. 现有研究的局限性与发现¶

现有SOTA:NGCF模型为了利用更多邻居(多跳)信息,借鉴了图卷积网络(GCN) 的复杂结构(包括特征变换、邻域聚合和非线性激活),并取得了很好的效果。

作者质疑:作者认为NGCF的设计过于沉重(heavy and burdensome),盲目照搬了GCN的设计,而这些设计可能并不适合CF任务。

关键区别:

GCN用于节点分类,每个节点本身有丰富的特征(如用户年龄、物品描述文本)。

CF的用户-物品图中,节点只有One-hot ID,除了作为标识符外没有具体语义。

核心论点:对于只有ID的图,进行复杂的特征变换和非线性激活不仅没用,反而会增加模型训练的难度,降低效果。

实验验证:作者通过严格的实验(消融研究)证明,去掉特征变换和非线性激活这两个组件后,模型性能反而显著提升了。

研究

NGCF (Wang et al., 2019b): 利用多阶邻域信息的图卷积推荐模型。

Mult-VAE (Liang et al., 2018): 基于变分自编码器的协同过滤模型。

总结说明:这两篇论文是LightGCN所要直接比较和超越的对象。NGCF是先进的图模型代表,而Mult-VAE是当时非图架构的state-of-the-art模型。击败它们能有力地证明LightGCN的有效性和优越性。

3. 本文提出的解决方案:LightGCN¶

基于上述发现,作者提出了一个更轻量、更有效的模型——LightGCN。

设计理念:只保留GCN中最核心、对CF最有效的组件——邻域聚合。

模型工作流程:

为每个用户和物品分配一个ID嵌入向量。

通过邻域聚合在交互图上传播和 refining 这些嵌入向量(例如,用户的嵌入受她交互过的物品的影响)。

将不同传播层学习到的嵌入向量通过加权求和的方式组合起来,得到最终用于预测的嵌入向量。

优势:模型简单、优雅,更容易训练,并且在实验中效果比NGCF等现有先进模型更好。

4. 本文的主要贡献(总结部分)¶

最后,作者总结了本工作的三个主要贡献:

实证发现:指出了GCN中两个常用组件(特征变换、非线性激活)在CF任务中无效。

提出新模型:提出了一个简化的新模型LightGCN。

实验验证:在相同设置下与NGCF对比,证明了新模型的优越性,并提供了深入分析。

2. Preliminaries¶

本节主要介绍了 NGCF(Neural Graph Collaborative Filtering),这是一个在推荐系统中表现优异的图卷积网络(GCN)模型。通过对 NGCF 进行消融实验(ablation study),作者发现了在推荐任务中,GCN 的两个常见设计——特征变换(feature transformation)和 非线性激活函数(nonlinear activation)——并不如预期般有益,反而可能对模型表现产生负面影响。

2.1. NGCF Brief¶

NGCF 的核心思想是通过用户-物品交互图进行嵌入传播,从而学习用户的高阶邻居表示。

初始嵌入:每个用户和物品都有一个初始的 ID 嵌入,分别表示为 \( e_u^{(0)} \) 和 \( e_i^{(0)} \)。

传播公式:在每一层,NGCF 使用如下公式更新用户和物品的嵌入:

\[ e_u^{(k+1)} = \sigma\left(W_1 e_u^{(k)} + \sum_{i \in \mathcal{N}_u} \frac{1}{\sqrt{|\mathcal{N}_u||\mathcal{N}_i|}} (W_1 e_i^{(k)} + W_2 (e_i^{(k)} \odot e_u^{(k)})) \right) \]类似地,对物品嵌入 \( e_i^{(k+1)} \) 也有类似的传播公式。

最终嵌入:经过 \( L \) 层传播后,NGCF 将每层的嵌入 \( e_u^{(0)}, e_u^{(1)}, \ldots, e_u^{(L)} \) 拼接起来,形成最终用户嵌入,并通过内积计算预测得分。

NGCF 的设计特点:

借鉴了传统 GCN 的设计,引入了非线性激活函数 \( \sigma \) 和特征变换矩阵 \( W_1, W_2 \)。

作者认为在推荐系统中,这些设计可能并不必要,因为用户和物品的唯一输入是“ID”,缺乏语义信息,因此非线性变换不能带来显著的性能提升,反而可能增加训练难度。

2.2. Empirical Explorations on NGCF(重点)¶

本节通过 消融实验 对 NGCF 进行了深入分析,检验了非线性激活和特征变换的作用。

实验设置:¶

使用了 NGCF 的开源实现,确保实验公平。

对最终嵌入方式进行了调整(从拼接改为求和),以更清晰地体现嵌入质量。

构造了三个简化版本的 NGCF:

NGCF-f:去掉特征变换矩阵 \( W_1, W_2 \)

NGCF-n:去掉非线性激活函数 \( \sigma \)

NGCF-fn:同时去掉特征变换和非线性激活

实验结果(重点):¶

模型 |

Gowalla Recall |

Gowalla NDCG |

Amazon-Book Recall |

Amazon-Book NDCG |

|---|---|---|---|---|

NGCF |

0.1547 |

0.1307 |

0.0330 |

0.0254 |

NGCF-f |

0.1686 |

0.1439 |

0.0368 |

0.0283 |

NGCF-n |

0.1536 |

0.1295 |

0.0336 |

0.0258 |

NGCF-fn |

0.1742 |

0.1476 |

0.0399 |

0.0303 |

NGCF-f 性能优于标准 NGCF,表明特征变换对推荐任务有负面影响。

NGCF-fn 性能提升最大,说明非线性激活和特征变换对模型的负面影响是显著的。

NGCF-n 的性能与 NGCF 几乎相同,说明非线性激活在有特征变换的情况下影响较小。

结论:

特征变换对 NGCF 有负面影响,移除后模型性能显著提升

非线性激活在有特征变换时影响较小,但在无特征变换时也有负面影响

同时移除非线性激活和特征变换(NGCF-fn)效果最好,相对改善约为 9.57%。

补充分析(训练过程):¶

绘制了训练损失和测试 recall 曲线(见图 1)。

NGCF-fn 的训练损失最低,且测试 recall 最高,说明其泛化能力更强。

NGCF 与 NGCF-f 的差距相对较小,但 NGCF 的训练损失始终更高,说明其学习更困难。

理论解释:¶

NGCF 的理论表达能力更强(因为可以看作是 NGCF-f 的扩展,通过设置 \( W_1, W_2 \) 为单位矩阵即可得到 NGCF-f)。

但在实践中,NGCF 训练更困难,泛化性能更差。

非线性激活进一步放大了这一问题,使得模型更难优化。

本节总结(重点):¶

在推荐系统中,NGCF 的两个关键设计(特征变换和非线性激活)不仅没有带来益处,反而可能 增加训练难度并降低性能。

该研究表明:进行严谨的消融实验是设计推荐模型的重要步骤,避免引入不必要的复杂操作,否则可能适得其反。

本节核心贡献:

通过实验证明了在推荐系统中,GCN 的特征变换和非线性激活并不必要,甚至有害。

提出简化模型的设计理念,为后续提出的 LightGCN 提供了理论和实验依据。

3. Method¶

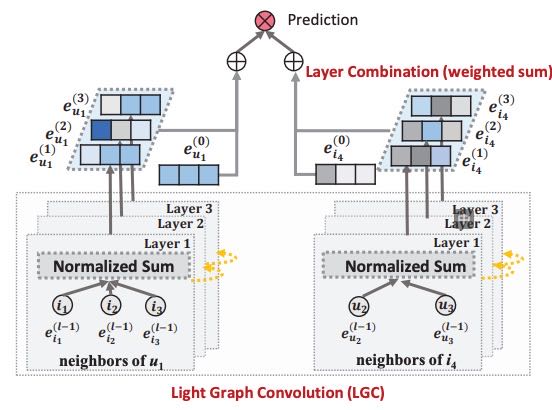

Figure 2.An illustration of LightGCN model architecture.

图解

In LGC, only the normalized sum of neighbor embeddings is performed towards next layer;

other operations like self-connection, feature transformation, and nonlinear activation are all removed, which largely simplifies GCNs.

In Layer Combination, we sum over the embeddings at each layer to obtain the final representations.

3.1 LightGCN¶

在本文中,LightGCN 被设计为一种轻量但有效的图卷积网络模型,用于推荐任务。其核心思想是通过图卷积操作对用户和物品进行表示学习。与传统的GCN模型(如NGCF)相比,LightGCN简化了结构,去除了复杂的特征变换和非线性激活函数,仅保留最核心的邻居信息聚合操作。这种简化带来的优势包括模型更易训练、可解释性强,并且便于分析和优化。

LightGCN 的图卷积操作(称为 LGC)定义为:

其中,\(\mathcal{N}_u\) 为用户 \(u\) 的邻居集合,\(\sqrt{|\mathcal{N}_u||\mathcal{N}_i|}\) 是对称归一化项,用于防止嵌入向量在传播过程中尺度膨胀。LightGCN 不引入自连接(self-connection),因为其在层组合(Layer Combination)过程中已经能够捕获类似的效果。

在层组合操作中,LightGCN 将每一层的嵌入向量以加权和的方式组合,形成最终的用户与物品表示:

权重 \(\alpha_k\) 可以是手动设定的(如均匀分配),也可以通过注意力机制自动学习。实验表明,均匀分配通常已经足够有效。

模型的预测函数为用户和物品嵌入的内积:

该内积结果用于推荐系统的排序任务。

3.1.3 矩阵形式¶

为了便于实现和与其他图模型进行比较,作者给出了 LightGCN 的矩阵形式。定义用户-物品交互矩阵 \(R\),并构造对应的邻接矩阵 \(A\)。每一层的嵌入向量通过以下公式进行传播:

最终的嵌入向量为:

通过这种方式,LightGCN 可以在矩阵层面快速实现,并与其他图卷积模型进行对比分析。

3.2 模型分析¶

3.2.1 与 SGCN 的关系¶

SGCN 是一种线性的简化 GCN 模型,其通过引入自连接来实现信息传播。研究表明,LightGCN 通过层组合的方式可以实现与 SGCN 相同的效果,因此没有必要在邻接矩阵中显式引入自连接。两者在数学上的等价性说明了 LightGCN 的设计是简洁且强大的。

3.2.2 与 APPNP 的关系¶

APPNP 是一种基于 Personalized PageRank 思想的图卷积变体,通过引入“跳跃”机制(teleport)来防止过平滑问题。LightGCN 通过层组合和权重分配实现了与 APPNP 相似的效果,因此也能在长距离建模的同时避免过平滑。这种设计使得 LightGCN 在保持模型简洁的前提下,具备更强的泛化能力。

3.2.3 二阶平滑分析¶

通过分析两层 LightGCN 的嵌入传播过程,作者发现 LightGCN 在第二层已经能够捕获用户之间的二阶邻居信息。这种机制符合推荐系统中用户相似性建模的基本假设。例如,两个用户共享越多的共同交互物品,其相似性就越高,并且这些物品的流行度越低(即越个性化),那么这种相似性就更具意义。这进一步验证了 LightGCN 的合理性。

3.3 模型训练¶

LightGCN 的训练参数仅为初始嵌入向量 \(E^{(0)}\),其复杂度与传统的矩阵分解(MF)模型相当。训练中使用的是 BPR(Bayesian Personalized Ranking)损失函数,其通过成对学习的方式最大化正样本与负样本之间的预测差异:

为防止过拟合,模型仅使用 L2 正则化,而未引入常见的 Dropout 机制。这进一步体现了 LightGCN 的简洁性:不需要额外的调参(如节点 Dropout、消息 Dropout)即可保证模型性能。

作者还尝试通过训练或验证数据学习层组合权重 \(\alpha_k\),但并未带来显著提升,因此在本文中保持统一的均值分配。未来工作可探索个性化 \(\alpha_k\) 的学习方式,以进一步提升模型性能。

4. Experiments¶

4.1. 实验设置¶

数据集:实验使用了Gowalla、Yelp2018和Amazon-Book三个数据集,它们的用户数、项目数、交互数和数据密度如表2所示。所有数据集的划分均由NGCF论文作者提供,Gowalla和Amazon-Book与原始论文一致,而Yelp2018使用了去除了冷启动项目的改进版本。

评估指标:使用recall@20和ndcg@20两个指标,并按照all-ranking protocol(将未交互的物品作为候选)进行评估。

对比方法:主要对比方法是NGCF,此外还包括Mult-VAE和GRMF等其他推荐系统方法。

超参数设置:所有模型的嵌入维度固定为64,使用Xavier初始化,优化器为Adam,学习率0.001,批量大小为1024(Amazon-Book为2048)。L2正则化系数λ范围为{1e-6, 1e-5, …, 1e-2},最佳值多为1e-4。层数K测试范围为1到4,一般3层效果较好。

4.2. 与NGCF的性能对比¶

对比方式:在不同层数(1到4层)下比较NGCF与LightGCN的性能(见表4),并计算相对改进百分比。

主要发现:

LightGCN显著优于NGCF:在三个数据集中,LightGCN在所有层数下均优于NGCF,例如在Gowalla上最高提升16.56%,平均提升16.52%。

层数对性能的影响:增加层数能带来性能提升,但提升幅度逐渐减小,3层通常效果最佳。

训练过程分析:LightGCN在训练过程中损失函数更低,且测试准确率更高,说明其具有更强的泛化能力。

模型复杂度与训练难度:NGCF模型更复杂,训练难度高,即使训练损失较低,也难以转化为测试性能的提升。

4.3. 与最先进方法的性能对比¶

对比方法:Mult-VAE(变分自编码器)、GRMF(图拉普拉斯正则化)、NGCF等。

实验结果(见表4):

LightGCN在所有三个数据集的recall@20和ndcg@20指标上均优于所有方法。

Mult-VAE是表现最强的基线方法,但仍低于LightGCN。

GRMF通过引入图拉普拉斯正则化提高了性能,但效果不如LightGCN。

GRMF-norm(引入归一化的版本)在Gowalla上略优于GRMF,但在其他数据集上提升不明显。

4.4. 消融与有效性分析¶

4.4.1. 层数融合的影响¶

实验设计:对比了使用和不使用层融合(LightGCN与LightGCN-single)的LightGCN在不同层数下的表现。

发现:

LightGCN-single:随着层数增加,性能先提升后下降,表明高阶邻居可能会引起过平滑问题。

LightGCN:层数增加时性能持续提升,说明层融合有效缓解了过平滑问题。

结论:层融合是提升模型性能的关键设计之一。

4.4.2. 对称平方根归一化的影响¶

归一化方式:测试了仅左归一化、仅右归一化、L1归一化(无平方根)等不同方式。

发现:

最佳方式:使用对称平方根归一化(即当前设计的LightGCN)效果最好,去掉任一边归一化都会大幅下降性能。

次优方式:仅左归一化(L1-L)效果次之。

结论:对称平方根归一化有助于模型稳定和性能提升。

4.4.3. 嵌入平滑性分析¶

定义:用户/项目的嵌入平滑性定义为相邻用户/项目的嵌入向量之间的差异之和(见公式17)。

发现:

LightGCN的嵌入比MF更平滑(见表6),说明LightGCN通过图卷积增强了嵌入的平滑性。

平滑性与推荐质量:嵌入越平滑,用户/物品之间的相似性越高,推荐效果越好。

结论:第二阶嵌入平滑性是LightGCN高性能的关键原因。

4.5. 超参数研究¶

主要超参数:L2正则化系数λ。

实验发现:

LightGCN对λ的敏感性较低,即使λ设为0,性能仍优于NGCF。

最佳λ值分别为:Yelp2018(1e-3)、Amazon-Book(1e-4)、Gowalla(1e-4)。

λ过大时,性能迅速下降,说明过强的正则化会抑制模型训练。

小结¶

本章通过大量实验验证了LightGCN的有效性,主要对比了其与NGCF及其他先进方法在多个数据集上的性能,结果显示LightGCN在推荐精度上具有明显优势。同时,通过消融实验和嵌入分析揭示了LightGCN设计的关键点,包括层融合、对称平方根归一化和嵌入平滑性。此外,LightGCN在超参数调优上也表现出较强的鲁棒性,适合实际推荐系统的部署和应用。

6. Conclusion and Future Work¶

总体结论¶

本研究中,作者指出现有图卷积网络(GCNs)在协同过滤中的设计过于复杂,并通过实证研究验证了这一观点。为此,作者提出了LightGCN模型,其设计更加简洁高效,主要包含两个核心组件:轻量图卷积(light graph convolution)和层组合(layer combination)。

轻量图卷积去掉了传统GCN中的两个标准操作:特征变换和非线性激活,从而降低了模型训练的难度。

层组合将节点的最终嵌入表示为所有层嵌入的加权和,并被证明能够涵盖自连接(self-connection)的效果,同时有助于缓解过平滑(oversmoothing)问题。

实验结果表明,LightGCN具有以下优势:

更易于训练

更强的泛化能力

更高的效果

对未来工作的启发¶

作者认为,LightGCN的设计理念对推荐系统模型的未来发展具有启发性。随着现实应用场景中图结构数据的普及,基于图的模型在推荐系统中越来越重要。与传统监督学习方法(如因子分解机)相比,基于图的模型能够显式建模实体之间的关系,从而更具优势。

例如,近期的研究趋势是利用辅助信息进行推荐,包括:

物品知识图谱(Wang et al., 2019a)

社交网络(Wu et al., 2019b)

多媒体内容(Yin et al., 2019)

在这些应用中,GCN模型在许多任务上取得了最先进的表现。然而,这些模型也可能面临与NGCF类似的问题,即用户-物品交互图仍然是通过复杂的神经操作进行建模,这可能是不必要的。因此,作者计划将LightGCN的理念应用到这些模型中。

未来研究方向¶

未来的工作主要包括以下几点:

个性化层组合权重:目前的层组合权重是固定的,未来计划引入个性化权重 αₖ,实现对不同用户的自适应阶数平滑(adaptive-order smoothing)。例如,稀疏用户可能需要从更高阶邻居中获取更多信号,而活跃用户则需要较少。

探索快速解决方案:研究LightGCN的简洁性是否能够帮助开发更高效的非采样回归损失函数解决方案(He et al., 2019),并在在线工业场景中部署和优化。

致谢¶

作者感谢 Bin Wu、Jianbai Ye 和 Yingxin Wu 在 LightGCN 的实现与改进中的贡献。本研究得到了中国国家自然科学基金(项目编号:61972372、U19A2079、61725203)的支持。