2310.15950_RLMRec: Representation Learning with Large Language Models for Recommendation¶

引用: 259(2025-09-09)

组织:

University of Hong Kong

Baidu Inc.

GitHub: https://github.com/HKUDS/RLMRec

总结¶

RLMRec

核心思想:

不直接让LLM做推荐,而是用它来增强现有推荐系统学到的“表征”。

把LLM看作一个强大的文本理解专家,让它为用户和物品生成更丰富、更具语义信息的“档案”(Profiling)。

然后,将LLM的“语义空间”和推荐系统的“协作关系空间”对齐。这样,既保留了推荐系统的效率精度,又注入了LLM的语义理解能力。

提出的框架:RLMRec

它是一个与模型无关(Model-Agnostic) 的框架,意味着它可以像插件一样增强现有的多种推荐模型(如LightGCN, NGCF等)。

其核心是通过对比学习或生成式建模的技术,最大化LLM生成的语义表征和推荐模型学到的协作表征之间的互信息(Mutual Information),迫使它们在同一个语义子空间中对齐。

主要贡献总结:

新方向:探索了用LLM增强(而非替代)现有推荐系统的新范式。

新框架:提出了RLMRec这个通用框架。

理论支撑:为融合文本信号提供了理论证明。

实验验证:证明了框架的有效性和对噪声数据的鲁棒性。

Abstract¶

推荐系统在深度学习和图神经网络的影响下取得了显著进展,特别是在捕捉用户-项目复杂关系方面。然而,基于图的推荐系统严重依赖ID数据,可能忽视了与用户和项目相关的有价值文本信息,导致学习到的表示不够丰富。此外,隐式反馈数据的使用会引入潜在的噪声和偏见,这给用户偏好学习的有效性带来了挑战。

虽然将大型语言模型(LLMs)集成到传统的基于ID的推荐系统中已经引起了关注,但在实际推荐系统中有效实施时仍需解决可扩展性问题、单纯依赖文本的局限性以及提示输入的限制等挑战。为了解决这些问题,本文提出了一个模型无关的框架 RLMRec,旨在通过利用LLM进行表示学习来增强现有的推荐系统。该框架提出了一种结合表示学习与LLM的推荐范式,以捕捉用户行为和偏好的复杂语义方面。

RLMRec 集成了辅助文本信号,使用LLMs进行用户和项目的画像,并通过跨视角对齐将LLM的语义空间与协作关系信号对齐。本文还从理论上证明了通过最大化互信息来整合文本信号的基础,从而提高了表示的质量。实验部分将RLMRec与最先进的推荐模型结合进行评估,同时分析了其效率和对噪声数据的鲁棒性。

1. Introduction¶

好的,我们来逐段分解和理解这段学术文本。

这段文字是一篇关于推荐系统研究的论文的引言部分,核心论点是:虽然大型语言模型(LLMs)在理解文本方面能力强大,但直接将其用于推荐系统存在严重问题。因此,作者提出了一种新的框架(RLMRec),将LLMs的强大语义理解能力与现有推荐系统的高效和准确性结合起来。

以下是详细解读:

第一部分:背景与现有方法的局限性¶

当前推荐系统的成功:

现代推荐系统(如NGCF, LightGCN)利用深度学习和图神经网络(GNN) 非常成功。

它们通过分析用户和物品之间的交互关系(谁点击、购买了啥)来学习用户和物品的表征(Representations),从而进行个性化推荐。

现有图推荐系统的核心问题:

过度依赖ID信息:这些模型只使用用户ID、物品ID以及它们之间的交互矩阵(1表示交互过,0表示没有)。它们就像是只通过学号来认识学生,而不去看学生的个人档案。

忽视丰富文本信息:物品标题、描述、用户评论等富含语义的信息被忽略了,导致学到的“表征”信息量不足。

数据质量敏感:它们使用的数据大多是“隐式反馈”(如点击、购买),这些数据包含大量噪声(如误点、流行度偏见),模型学到的表征质量严重依赖于原始数据的质量。垃圾进,垃圾出。

第二部分:新趋势与直接使用LLMs的失败尝试¶

新趋势:引入LLMs:

最近,大家开始尝试用大型语言模型(LLMs)(如GPT-4, LLaMA)来增强推荐系统,因为它们能极好地理解文本内容。

一种思路是提示工程(Prompt Design):把推荐任务设计成“指令-问答”格式,让LLM直接生成推荐结果。

直接使用LLMs的两大缺陷:

i) 可扩展性问题(效率低):LLMs计算成本极高,生成一个推荐耗时很长(例如:TALLRec,3.6秒/用户)。对于拥有数百万用户和商品的现实系统来说,这完全不现实。

ii) 文本依赖的局限性(效果差):

幻觉(Hallucination):LLM可能会推荐一个根本不存在于候选列表中的商品(它自己编了一个)。

输入长度限制:LLM的输入有token数量限制(例如2048个),无法塞入所有用户的历史行为数据来建模复杂的全局协作关系。

实验验证其失败:

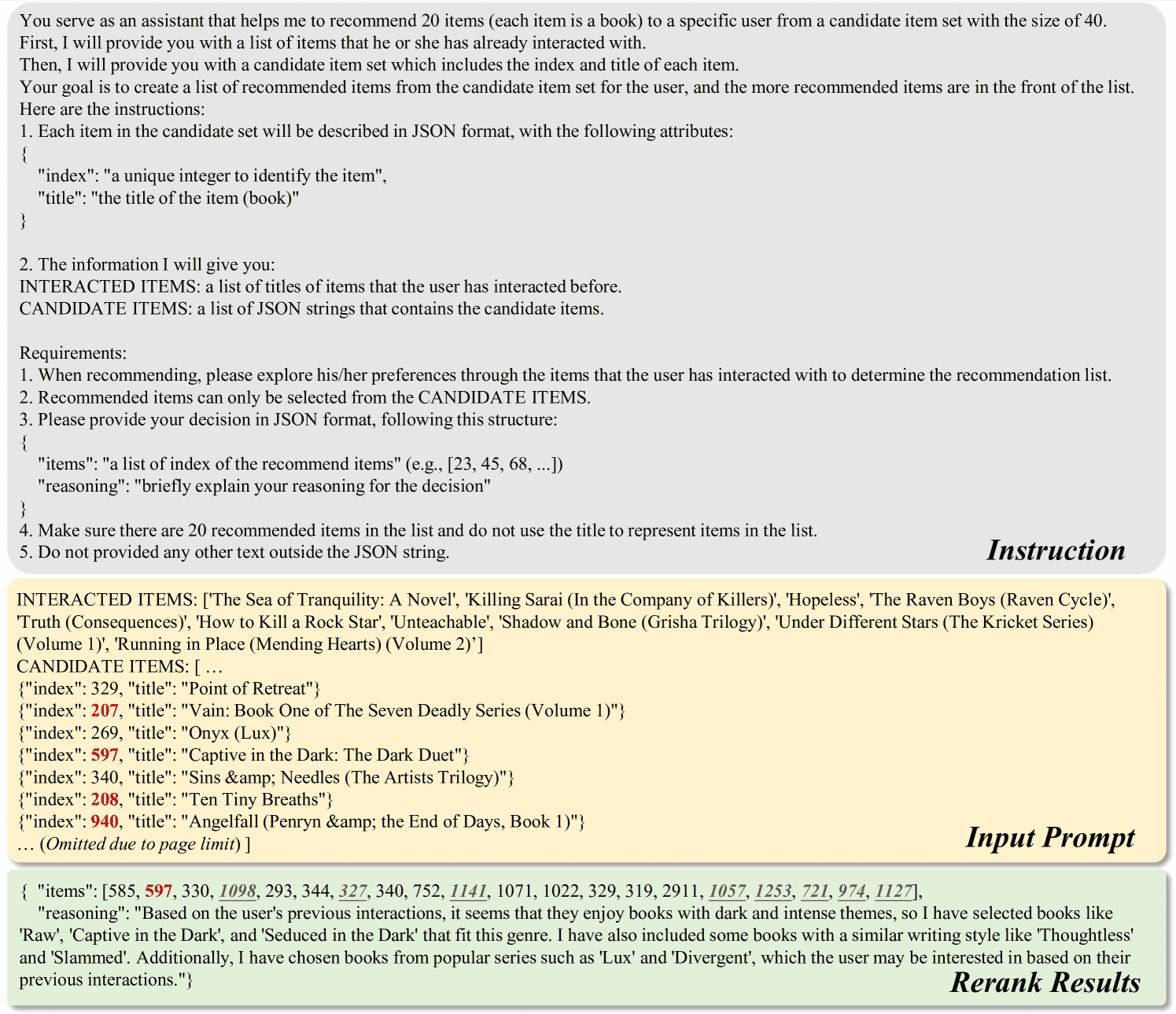

作者做了一个实验:用LightGCN生成一个50个商品的候选列表,然后让ChatGPT根据商品文本信息对这个列表进行重排序(Re-ranking),选出Top10/20。

结果:ChatGPT重排后的结果反而比LightGCN原始的结果更差,并且耗时数小时。这验证了上述两个缺陷。

第三部分:作者的解决方案与贡献¶

核心思想:

不直接让LLM做推荐,而是用它来增强现有推荐系统学到的“表征”。

把LLM看作一个强大的文本理解专家,让它为用户和物品生成更丰富、更具语义信息的“档案”(Profiling)。

然后,将LLM的“语义空间”和推荐系统的“协作关系空间”对齐。这样,既保留了推荐系统的效率精度,又注入了LLM的语义理解能力。

提出的框架:RLMRec

它是一个与模型无关(Model-Agnostic) 的框架,意味着它可以像插件一样增强现有的多种推荐模型(如LightGCN, NGCF等)。

其核心是通过对比学习或生成式建模的技术,最大化LLM生成的语义表征和推荐模型学到的协作表征之间的互信息(Mutual Information),迫使它们在同一个语义子空间中对齐。

主要贡献总结:

新方向:探索了用LLM增强(而非替代)现有推荐系统的新范式。

新框架:提出了RLMRec这个通用框架。

理论支撑:为融合文本信号提供了理论证明。

实验验证:证明了框架的有效性和对噪声数据的鲁棒性。

一句话总结¶

这篇文章指出,直接让大型语言模型(LLM)做推荐又慢又差,并提出一个巧妙的框架(RLMRec),让LLM充当“语义增强器”,来提升现有推荐模型学到的用户和物品表征的质量,从而两全其美。

3. Methodology¶

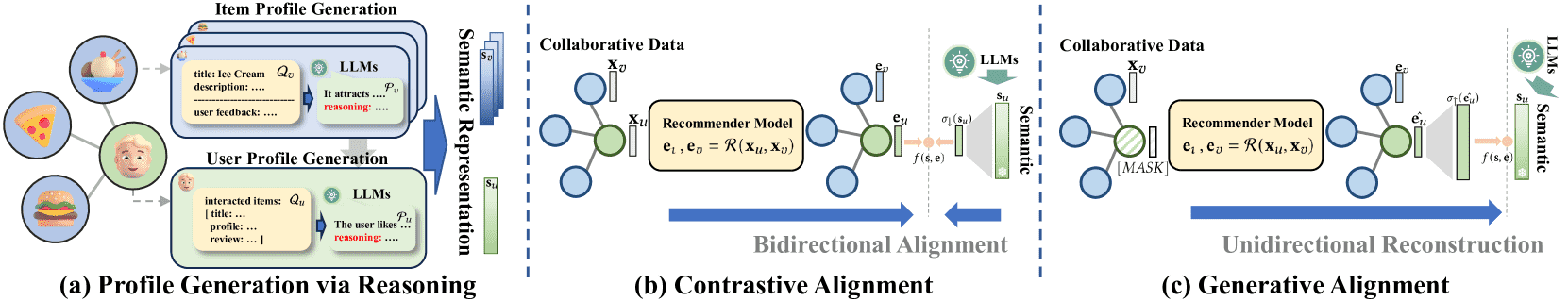

Figure 3.The overall framework of our proposed LLM-enhanced representation learning framework RLMRec.

核心思想(一句话概括)¶

RLMRec的核心目标是:利用大型语言模型(LLM)生成的文本信息(用户/物品资料),来“净化”和“增强”推荐系统从用户-物品交互数据中学到的表示(Embedding),从而克服交互数据中的噪声(误点击、流行度偏见、未发现的兴趣等),提升推荐准确性。

详细分步解析¶

我们可以将整个方法论分解为四个关键部分:

1. 问题背景与理论基础 (3.1节)¶

协作过滤(CF)的基本设定:有一个用户集合(𝒰)和一个物品集合(𝒱)。用户和物品之间的交互(如点击、购买)被记录在𝒳中。推荐模型(ℛ)的目标是为每个用户和物品学习一个向量表示(

e_u,e_v),这个表示能最好地解释观察到的交互数据。这通常通过最大化后验概率p(e|X) ∝ p(X|e) p(e)来实现。核心问题:数据噪声:现实中的交互数据(𝒳)充满噪声。

假阳性(False Positives):用户误点了不喜欢的商品,或者因为商品太流行而点击,并非真喜欢。

假阴性(False Negatives):用户会喜欢某个商品,但从未见过它,所以没有交互记录。

解决方案的直觉:作者引入了一个“隐藏的先验信念”(

z)。你可以把它想象成一个“理想状态”——它代表了真正对推荐有益的用户真实偏好和物品真实特性。我们的目标是让模型学到的表示(e)尽可能接近这个理想的先验信念(z)。

2. 如何利用文本信息?—— 用户/物品画像生成 (3.2节)¶

既然交互数据有噪声,我们就需要引入外部的高质量信息来辅助判断。这里选择的外部信息就是文本。

挑战:原始数据中的文本(如评论、描述)可能包含大量无关信息(噪声)、缺失或格式混乱。

解决方案:利用大型语言模型(LLM)的强大文本理解和生成能力,来为用户和物品生成高质量、精炼的“资料”(Profile)。

物品资料(𝒫_v):LLM会综合物品的标题、原始描述、属性和用户评论,生成一段能清晰阐述“该物品会吸引什么样的用户” 的文字。

用户资料(𝒫_u):LLM会分析用户交互过的物品(以及这些物品的生成资料)和用户自己写的评论,生成一段能精准概括“该用户偏爱何种类型物品” 的文字。

关键技巧:在给LLM的指令(Prompt)中,明确要求它给出推理过程(Reasoning),这有助于减少LLM的“幻觉”,提高生成资料的可信度。

3. 如何融合两种信息?—— 互信息最大化与对齐 (3.3节)¶

现在我们有两种表示:

协作过滤表示(

e):从(可能有噪声的)交互数据中学到的。语义表示(

s):将LLM生成的文本资料(𝒫_u/𝒫_v)通过一个文本编码器(如Sentence-BERT)转换成的向量。

核心论证(Theorem 1 & 2):从数学上推导出,最大化那个理想的先验信念(z)等价于最大化协作表示 e 和语义表示 s 之间的互信息(Mutual Information, I(e; s))。

互信息:衡量的是“知道一个变量(如

e)的信息后,能减少另一个变量(如s)多少的不确定性”。最大化它意味着让e和s的关联性更强。直观理解:如果从交互中学到的用户表示(

e_u)和从LLM生成的用户资料中学到的表示(s_u)非常相似,说明这个表示捕捉到了用户稳定、真实的内在偏好,而不是偶然的噪声交互。物品亦然。

如何实现最大化互信息? 作者提出了两种具体的技术方法来衡量和最大化 e 和 s 的相似性(即建模密度比 f(s, e)):

对比对齐(Contrastive Alignment - RLMRec-Con):

做法:将同一个用户/物品的

e_i和s_i作为“正样本对”,拉近它们的距离。将不同用户/物品的e和s作为“负样本对”,推远它们的距离。类比:就像教模型:“这张狗的图片(

e)和‘狗’这个文字描述(s)是匹配的;而这张狗的图片和‘猫’的文字描述是不匹配的。”

生成式对齐(Generative Alignment - RLMRec-Gen):

做法:随机“掩盖”(Mask)掉一部分用户或物品的初始ID信息,让推荐模型根据剩余的信息来重建(Reconstruct)其对应的语义表示

s_i。类比:就像做完形填空。把一段话里的几个词遮住,让你根据上下文猜出原词是什么。模型需要根据协作信号来猜出正确的文本语义表示。

4. 最终整合与训练 (3.4节)¶

最终的训练目标是一个组合损失函数:

总损失 = 推荐模型原来的损失 + 互信息最大化损失(ℒ_info)

ℒ_info就是上面对比学习或生成学习中所用的损失函数。模型无关性:这个方法(RLMRec)是一个“插件”,可以套用在任何能产生用户/物品表示(

e)的推荐模型(如NGCF, LightGCN等)上,增强其抗噪声和语义理解能力。

总结与比喻¶

想象一下一位经验丰富的顾问(LLM)在帮助一位数据分析师(推荐模型):

分析师手上有一份凌乱、可能有错误的销售记录(交互数据 𝒳)。

顾问阅读了所有产品的说明书和客户评价(原始文本),并为每个产品和客户撰写了一份精炼、深入的评估报告(生成的资料 𝒫)。

分析师的目标是做出准确的销售预测(学习表示

e)。他不仅看销售记录,还反复比对(最大化互信息)顾问提供的报告。对比学习就像他把报告和销售记录并排放在一起,确保它们描述的是同一个产品/客户。

生成学习就像他遮住某个产品的名字,只看它的销售记录,然后尝试写出顾问报告中的关键点。

通过这个过程,分析师学会了忽略销售记录中的偶然错误(误点击),并发现了那些虽然销量不高但潜力很大的产品(克服假阴性),最终做出了更精准的预测。

4. Evaluation¶

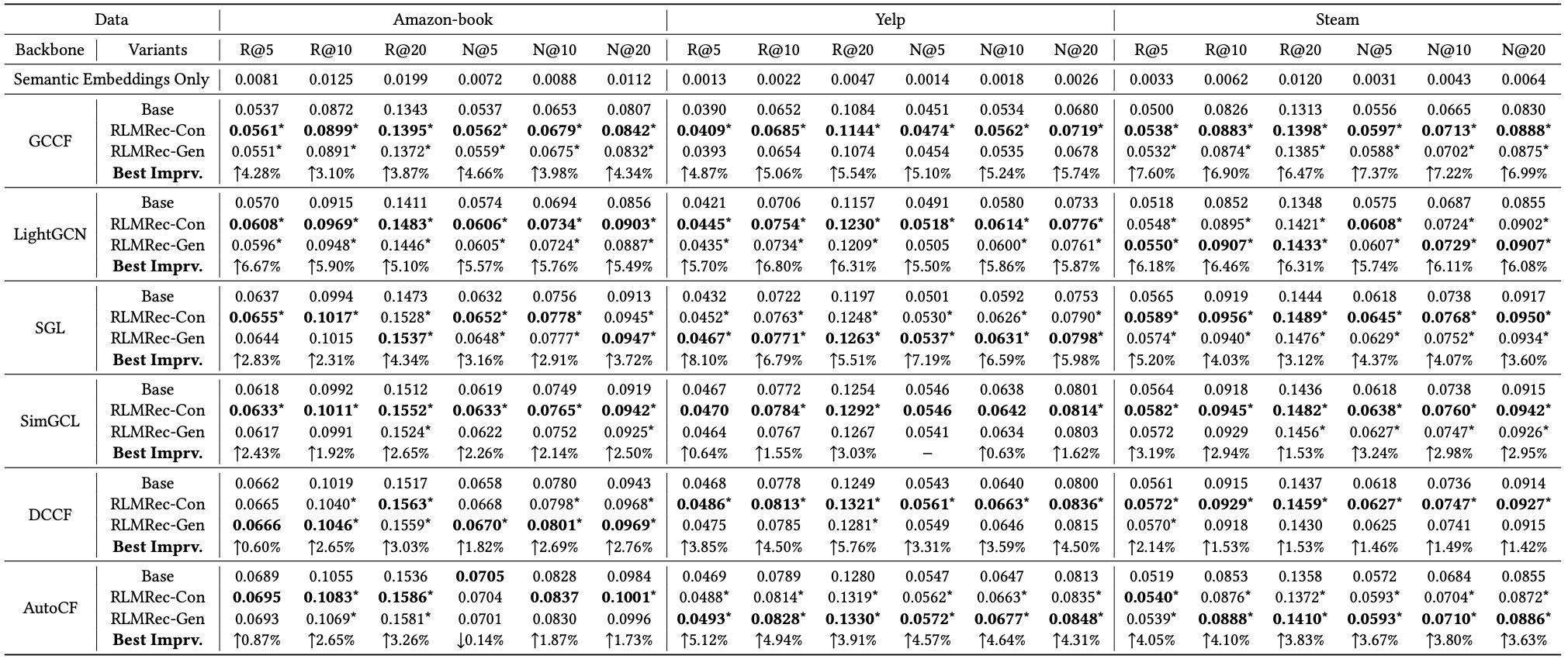

Table 1: Recommendation performance Imprvement of all backbone methods on different datasets in terms of Recall and NDCG.

Variants (变体): 对于每个骨干模型,比较三种情况:

Base: 原始模型,没有使用RLMRec。RLMRec-Con: 使用RLMRec的对比学习版本。RLMRec-Gen: 使用RLMRec的生成学习版本。

评估指标: 使用了两个推荐系统常用的核心指标:

Recall@N(R@N): 衡量模型推荐出的物品中有多少是用户真正喜欢的。越高越好。NDCG@N(N@N): 衡量模型推荐列表的质量,考虑排名顺序(越靠前的正确推荐得分越高)。越高越好。N 取 5, 10, 20,代表推荐列表的长度。

提升说明

Best Imprv. (最佳提升): 总结了RLMRec-Con和RLMRec-Gen两者中,相比Base模型提升百分比最大的那个值。

*星号的意义:表格开头的注释说明了,上标*表示这个提升是“统计显著的”(p-value < 0.05)。这意味着提升极不可能是由随机误差造成的,而是RLMRec真实带来的效果。

整体概述¶

这一节的核心目的是通过一系列实验来回答五个研究问题(RQ1-RQ5),从而全面评估RLMRec模型。它详细描述了实验设置、与其他模型的对比结果、以及针对模型不同特性的深入分析。

分部分详解¶

1. 研究问题 (Research Questions, RQs)¶

这部分列出了整节要回答的五个核心问题,是本节内容的提纲:

RQ1:RLMRec是否在各种实验设置下都优于现有的最先进推荐系统?(性能对比)

RQ2:LLM增强的语义表征是否真的提升了推荐性能?(消融研究)

RQ3:RLMRec是否能通过跨视图语义对齐有效处理噪声数据?(抗噪声能力)

RQ4:RLMRec作为预训练框架的潜力如何?(预训练能力)

RQ5:RLMRec的训练效率如何?(效率分析)

2. 实验设置¶

描述了实验的基础条件,确保实验的可重复性和公平性。

数据集:使用了三个公开数据集(Amazon-book, Yelp, Steam),涵盖了书籍、商业和游戏领域。处理数据时,过滤了低评分交互(除了没有评分的Steam),并进行了核心过滤和数据集划分(训练:验证:测试 = 3:1:1)。

评估协议与指标:采用“全排序”协议(评估所有物品,而非采样),使用Recall@N(前N个中推荐正确的比例)和NDCG@N(考虑排序位置的前N个推荐质量)作为衡量指标。

基线模型:选择了6个先进的基于自监督学习的推荐模型作为 backbone(基础模型),用于集成和对比RLMRec的效果。这些模型代表了不同的技术路线(图神经网络简化、对比学习、掩码自编码器等)。

实现细节:规定了模型参数(如向量维度为32)、使用的LLM服务(OpenAI的ChatGPT

gpt-3.5-turbo生成文本,text-embedding-ada-002生成文本向量)、训练参数(批次大小、学习率等)。

3. 性能对比 (RQ1)¶

这是最核心的实验,证明RLMRec的有效性。

核心发现:将RLMRec集成到任何6个基线模型中,性能都 consistently(一致地)得到了提升。

归因分析:作者将性能提升归功于两点:

LLM赋能:LLM生成了更准确的用户/物品画像,包含了丰富的语义信息。

跨视图对齐:RLMRec的框架促使协同过滤(CF)的关系向量和LLM的语义向量相互增强,并过滤掉不相关的噪声。

两种变体:RLMRec有 对比式(Con) 和 生成式(Gen) 两种实现。通常Con效果更好,但当基础模型本身也是生成式(如AutoCF)时,Gen变体表现更优。

与同类方法对比:与另一个LLM增强推荐模型KAR相比,RLMRec显著优于它。原因是KAR只是简单地把文本特征作为输入,而RLMRec通过 对齐机制更深层次地融合了文本知识和用户行为表示,抗噪声能力更强。

4. 消融研究 (RQ2)¶

这个实验旨在证明LLM提供的语义信息是有效的,而不是无关紧要的。

方法:他们故意“打乱”(Shuffle)了LLM生成的语义向量,使其与真实的用户/物品对应关系错位(即引入噪声)。

结果:打乱后,模型性能下降。这反向证明了准确的语义对齐对提升性能至关重要。

不同文本编码模型:换了其他文本向量模型(Contriever, Instructor),RLMRec依然有效,说明其通用性。更好的文本编码器能带来更大的提升。

5. 深入分析 (RQ3-RQ5)¶

这部分针对模型的其他重要特性进行了分析。

RQ3 - 抗噪声能力:

方法:在训练数据中主动添加一定比例(5%-25%)的虚假交互(噪声)。

结果:

RLMRec的两个变体在所有噪声水平下都优于基础模型(LightGCN)。

对比式(Con) 方法比生成式(Gen)表现出更好的抗噪声性,因为Gen的掩码操作本身会引入一些噪声。

RQ4 - 预训练潜力:

方法:用2012-2017年的数据预训练模型,然后用预训练好的参数初始化模型,再在2018-2019年的数据(下游任务)上微调。

结果:使用RLMRec预训练的模型,在下游任务上的表现优于随机初始化和只用基础模型预训练的情况。这证明了RLMRec学习到的表征具有很好的泛化性。

RQ5 - 训练效率:

分析:从理论和实际测量两个角度分析了时间开销。

结果:RLMRec-Con因为要计算对比损失,开销更大;RLMRec-Gen的开销相对较小。但总体而言,相对于基础模型,RLMRec带来的额外时间开销(约10%-20%)是合理的,尤其是考虑到它带来的性能提升。

6. 案例分析¶

通过一个具体例子,直观展示RLMRec的优势。

场景:两个用户(u1998和u227)在关系图上距离很远(超过3跳),传统的基于ID的模型很难发现他们的关联。

发现:RLMRec通过LLM捕捉到了他们之间共同的语义兴趣(例如都喜欢“服务友好”的商业),从而在向量空间中将他们拉近。这使得RLMRec能捕捉到全局的、深层的用户依赖关系,而不仅仅是局部邻居关系。

核心结论总结¶

有效性强:RLMRec能显著且一致地提升多种先进推荐模型的基础性能。

机理正确:性能提升确实来自于LLM提供的优质语义信息,以及有效的跨视图对齐机制。

鲁棒性好:对训练数据中的噪声有较强的抵抗能力。

泛化性高:具备作为预训练模型为下游任务提供良好初始化的潜力。

效率可接受:虽然增加了计算开销,但性价比(性能提升/时间开销)很高。

价值凸显:能够突破传统协同过滤的局部性限制,利用语义信息发掘用户间深层的全局关联。

简单来说,这一段用扎实的实验证明了将大语言模型(LLM)的语义理解能力与协同过滤(CF)的行为模式分析通过一个精心设计的对齐框架结合起来,是当前推荐系统一个非常有效且前景广阔的研究方向。

5. Conclusion¶

本文提出了RLMRec,一个与模型无关的框架,利用大语言模型(LLMs)来提升推荐系统的表示性能。重点内容如下:

RLMRec的提出:RLMRec是一个模型无关的框架,其核心思想是通过LLMs增强推荐系统的表示能力。这是一个创新点,具有广泛适用性。

协作式用户画像生成范式:文章中引入了一种协作式用户画像生成方法,强调在生成过程中包含推理过程。这一部分是RLMRec的关键组成部分,有助于提高推荐的解释性和准确性。

推理驱动的系统提示:为了增强推荐结果的可解释性,RLMRec使用了推理驱动的系统提示(reasoning-driven system prompt)。这也是一个重点内容,体现了推荐系统与LLMs结合的优势。

对齐技术:RLMRec采用对比学习(contrastive)和生成式(generative)对齐技术,将协同过滤侧的关系嵌入与LLM侧的语义表示对齐,从而有效减少特征噪声。这一技术是实现RLMRec性能提升的关键。

综合评估与理论支持:该框架在真实世界数据集上进行了广泛评估,并获得了坚实的理论支持,验证了其有效性和可靠性。

未来研究方向:作者指出,未来的研究将聚焦于通过提供更有洞见的解释,进一步提升基于LLM的推理在推荐系统中的应用效果。这表明作者关注的是推荐系统的可解释性与推理能力的结合。

整体来看,本文通过融合LLMs与推荐系统,提出了一种新型框架RLMRec,重点在于推理过程的引入和表示对齐技术,具有较高的理论价值和应用潜力。

Appendix A Supplementary Material¶

1. 补充材料概述¶

本节补充了 RLMRec 框架的训练流程(通过伪代码实现),对 profile 生成过程进行了详细阐述,并提供了重排序任务的实验细节分析。

Table 5. 实验数据集的统计信息¶

数据集 |

用户数 |

物品数 |

交互数 |

密度(Density) |

|---|---|---|---|---|

Amazon-book |

11,000 |

9,332 |

120,464 |

1.2×10⁻³ |

Yelp |

11,091 |

11,010 |

166,620 |

1.4×10⁻³ |

Steam |

23,310 |

5,237 |

316,190 |

2.6×10⁻³ |

这些数据集用于验证模型在不同场景下的性能。

A.1. RLMRec 的伪代码¶

本节提出了 RLMRec 的两种实现方式:RLMRec-Con 和 RLMRec-Gen,并分别给出了它们的训练流程(伪代码)。

算法 1:RLMRec-Con 的训练流程¶

输入:基础模型 ℛ,隐式反馈 𝒳,用户与物品的语义表示 s,学习率 η。

输出:训练后的模型参数 Θ。

流程:

从 𝒳 中均匀采样小批量数据 ℬ。

使用 ℛ 得到协作侧表示 eu/v。

计算 ℒℛ 和 ℒinfo(基于公式 [16] 和 [18])。

将总损失 ℒ = ℒℛ + ℒinfo。

使用梯度下降更新参数 Θ。

重复直到模型收敛。

重点:

RLMRec-Con 通过对比学习(Contrastive Learning)建模密度比(Density Ratio),并计算所有用户和物品的 ℒinfo。

算法 2:RLMRec-Gen 的训练流程¶

输入:与 RLMRec-Con 相同,但增加了掩码比例 α。

输出:同样输出训练后的模型参数 Θ。

流程:

采样数据并随机掩码一部分用户/物品。

将被掩码的用户/物品初始嵌入替换为 [MASK]。

使用 ℛ 推理表示。

计算损失并更新参数。

重点:

与 RLMRec-Con 不同,RLMRec-Gen 通过生成对齐(Generative Alignment)建模互信息(Mutual Information),仅对被掩码的用户与物品计算 ℒinfo。

A.2. Profile 生成细节¶

本节详细说明了用户和物品 profile 的生成过程,并结合 Amazon-book 数据集给出实例展示。

A.2.1. 物品 Profile 生成示例¶

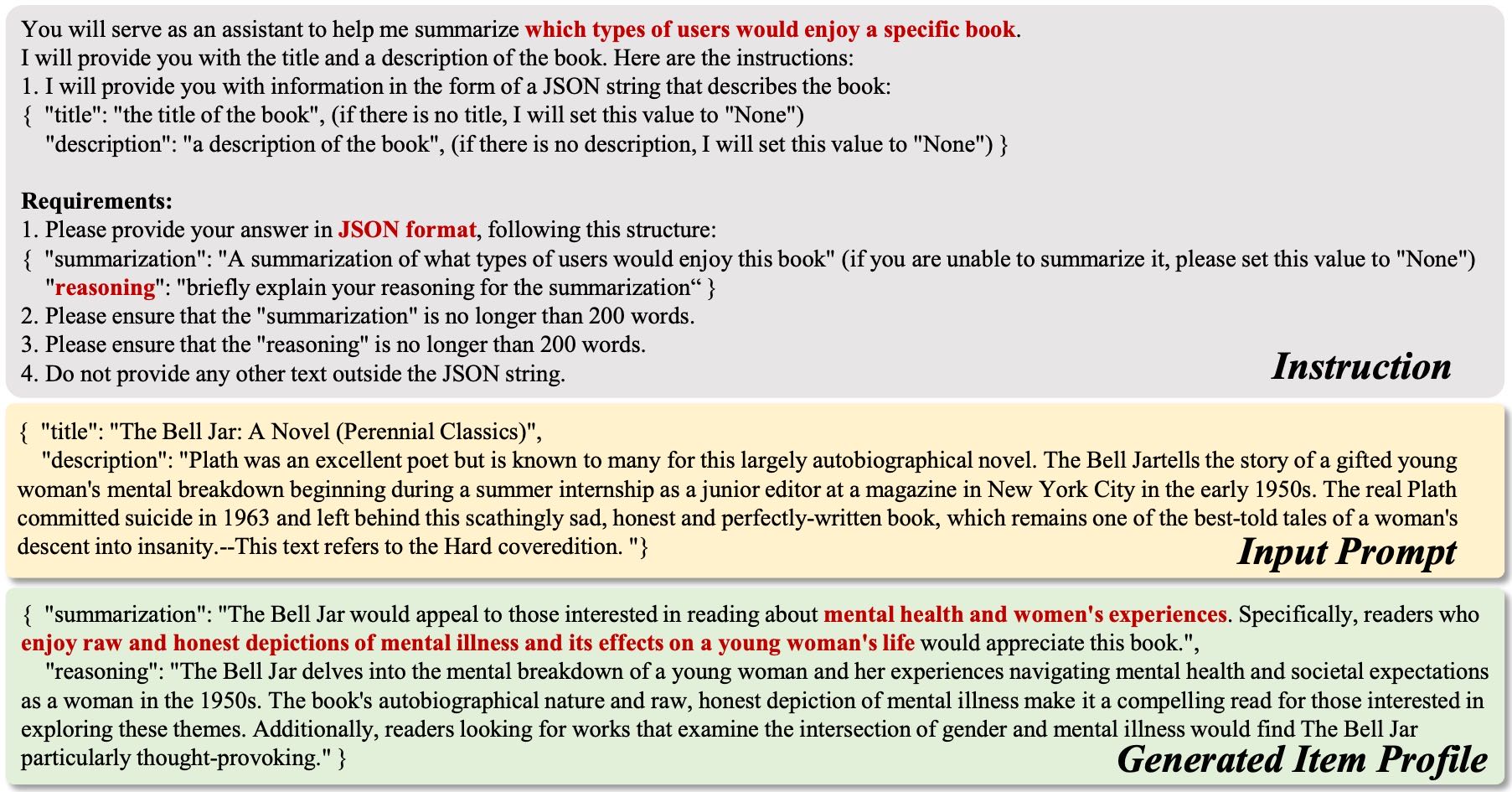

Figure 7: Case study on item profile generation in Amazon-book data.

以 Amazon-book 数据集为例,输入为物品的标题和原始描述。

通过指令提示语言模型(如 ChatGPT)生成 JSON 格式的 profile。

强调语言模型需要提供生成理由,以防止幻觉(hallucination)并保证生成质量。

示例中,模型基于描述准确捕捉到书籍可能吸引关注心理健康和女性经验的读者。

A.2.2. 用户 Profile 生成示例¶

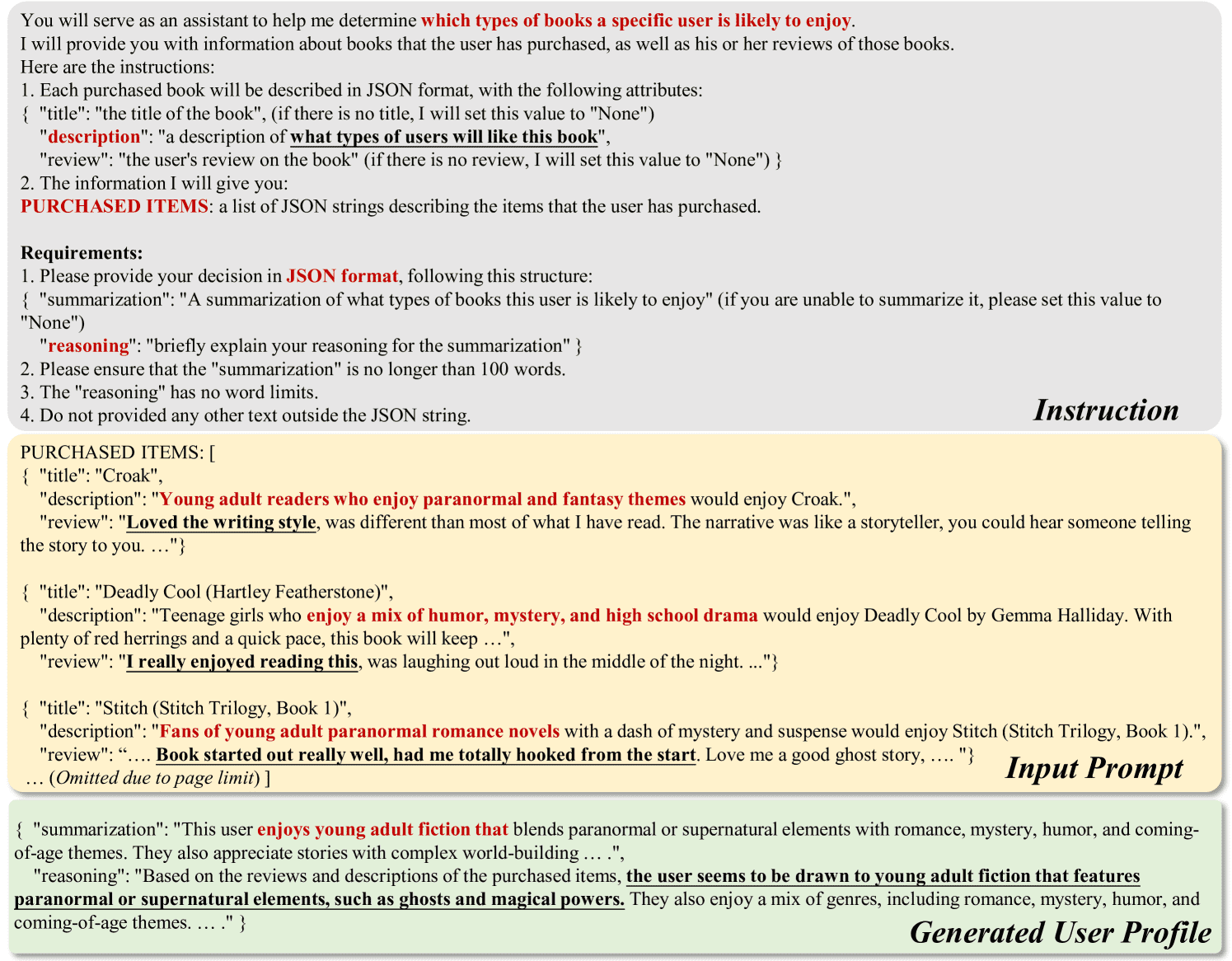

Figure 8.Case study on user profile generation in Amazon-book data.

采用“物品到用户”的生成范式,即基于物品 profile 和用户交互信息生成用户 profile。

用户的反馈信息(如评论)和物品描述被合并输入语言模型,以更准确捕捉用户偏好。

示例中,模型基于书籍和用户评论准确推断出用户喜欢结合超自然元素的青少年小说。

A.3. 基于 LLM 的重排序任务分析¶

Figure 9.Case study on LLMs-based reranking. The candidate items are retrieved by LightGCN.

本节分析了在 Amazon-book 数据集上使用 LLM 进行重排序的效果与问题。

任务设计:¶

使用 LightGCN 检索出 40 个候选物品。

提供用户历史购买记录和候选物品的 JSON 信息作为输入。

要求 LLM 从中挑选出前 20 个推荐物品。

问题与挑战:¶

非真实物品推荐:LLM 会推荐不存在于候选列表中的物品(绿色高亮),这是许多重排序任务中的常见问题。

推荐准确率较低:正确推荐的物品数量少于候选数量(红色高亮),这是因为 LLM 缺乏充分利用用户偏好的文本信息。

与 LightGCN 的对比:

LightGCN 能够利用协同信息(collaborative information)提升检索质量。

LLM 依赖文本信息,信息量有限且存在噪声,影响了推荐效果。

潜在限制:¶

输入 token 数量限制:原始描述可能过长,限制了候选物品数量。

描述缺失或噪声:部分数据集描述不完整或质量差,影响模型理解用户偏好。

计算开销:增加输入信息会提高计算成本,影响系统的可扩展性。

总结¶

RLMRec-Con 与 RLMRec-Gen:分别通过对比学习与生成对齐的方式建模用户与物品的语义表示。

Profile 生成:结合用户与物品的文本与交互信息,通过 LLM 生成高质量的 profile。

重排序任务分析:LLM 在重排序任务中表现出潜力,但也存在推荐不准确、非真实物品推荐等问题,需考虑数据质量与系统效率的平衡。

附录部分为论文方法的实现细节、实验设计与挑战提供了补充说明,有助于读者更深入理解 RLMRec 框架的机制与局限性。